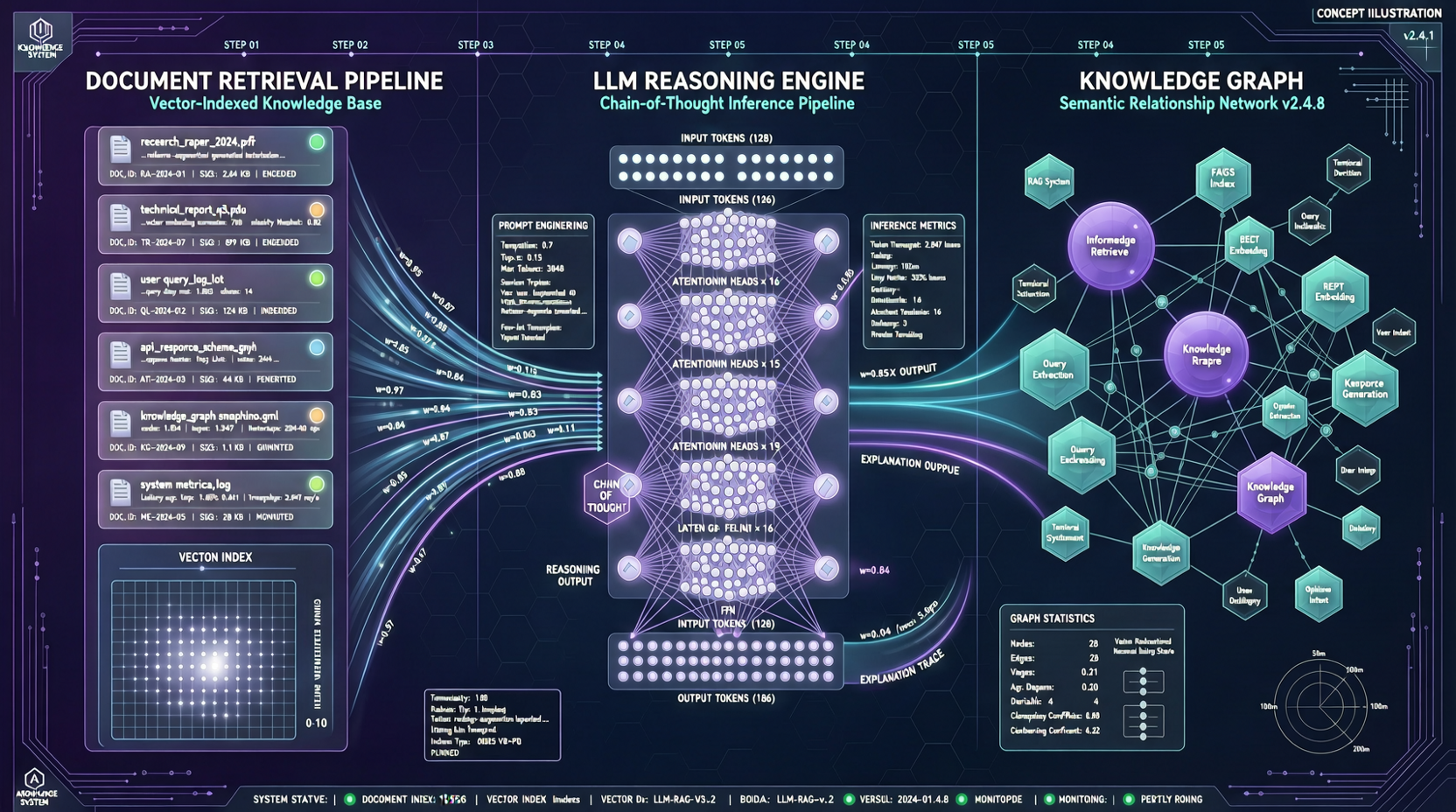

RAG работает три года, и все приняли предпосылку: нарезаете документы, эмбеддите, храните в векторной базе данных, затем делаете поиск по схожести.

PageIndex говорит: не нужно.

30.6k звёзд, +4300 за неделю.

Что не так с векторными базами данных

Векторные базы работают нормально. Но неудобны в специфическом сценарии — когда структура документов сложная и нужно понимать семантические связи, а не просто текстовое сходство.

PageIndex: вместо поиска по схожести эмбеддингов, пусть LLM напрямую «рассуждает», какие фрагменты документов релевантны.

Как это работает

Агентная стратегия поиска — один агент понимает запрос, другой находит релевантный контент.

Производительность

Цена vectorless RAG: каждый поиск вызывает LLM для рассуждений.

- Выше задержка: векторный поиск — миллисекунды, LLM-рассуждения — секунды

- Выше стоимость: каждый поиск потребляет токены LLM

- Хуже параллелизм

Оценка

Vectorless RAG — интересное направление. Для высокоценных, низкоконкурентных сценариев уже имеет практическую ценность.

Основные источники: