AIME、MATH、GSM8K……LLM数学评测榜单挤得不行。但一个一直被诟病的问题:这些题很多已被模型在预训练阶段见过。

Soohak想换个思路。

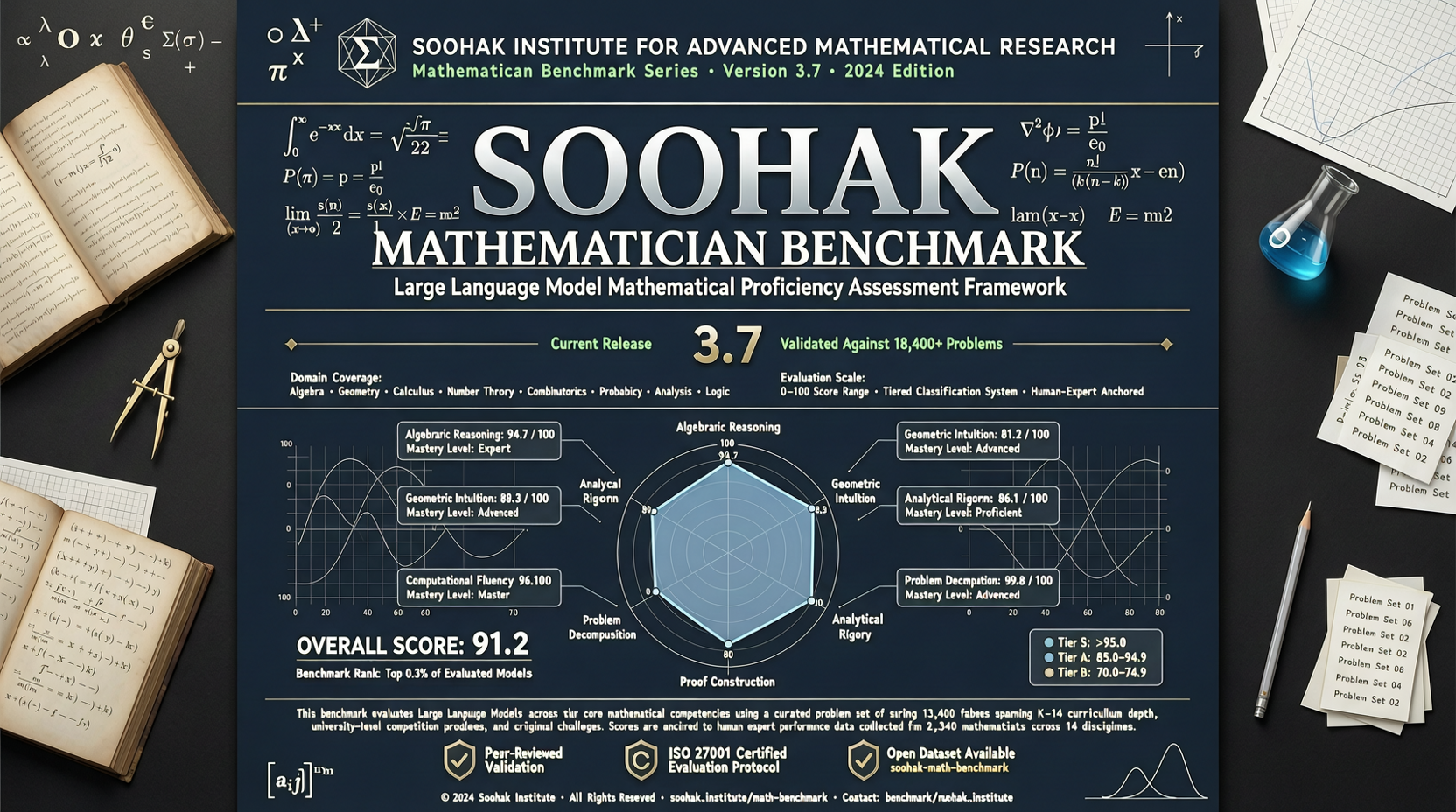

arXiv:2605.09063发布的Soohak benchmark由43位数学家手工出题,覆盖本科到研究生级数学。不是刷题库,是出题库。

为什么手工出题

现有数学benchmark的问题:数据泄露、难度天花板低、覆盖窄。

Soohak的解决方式:让数学家出新题。不在网上,模型没见过,考纯推理能力。

分量

参与机构包括EleutherAI、CMU(Sean Welleck、Graham Neubig)、KAIST等。

主要来源:arXiv:2605.09063