AIME、MATH、GSM8K……LLM 数学评测榜单挤得不行。但一个一直被诟病的问题是:这些题,很多已经被模型在预训练阶段见过了。

Soohak 想换个思路。

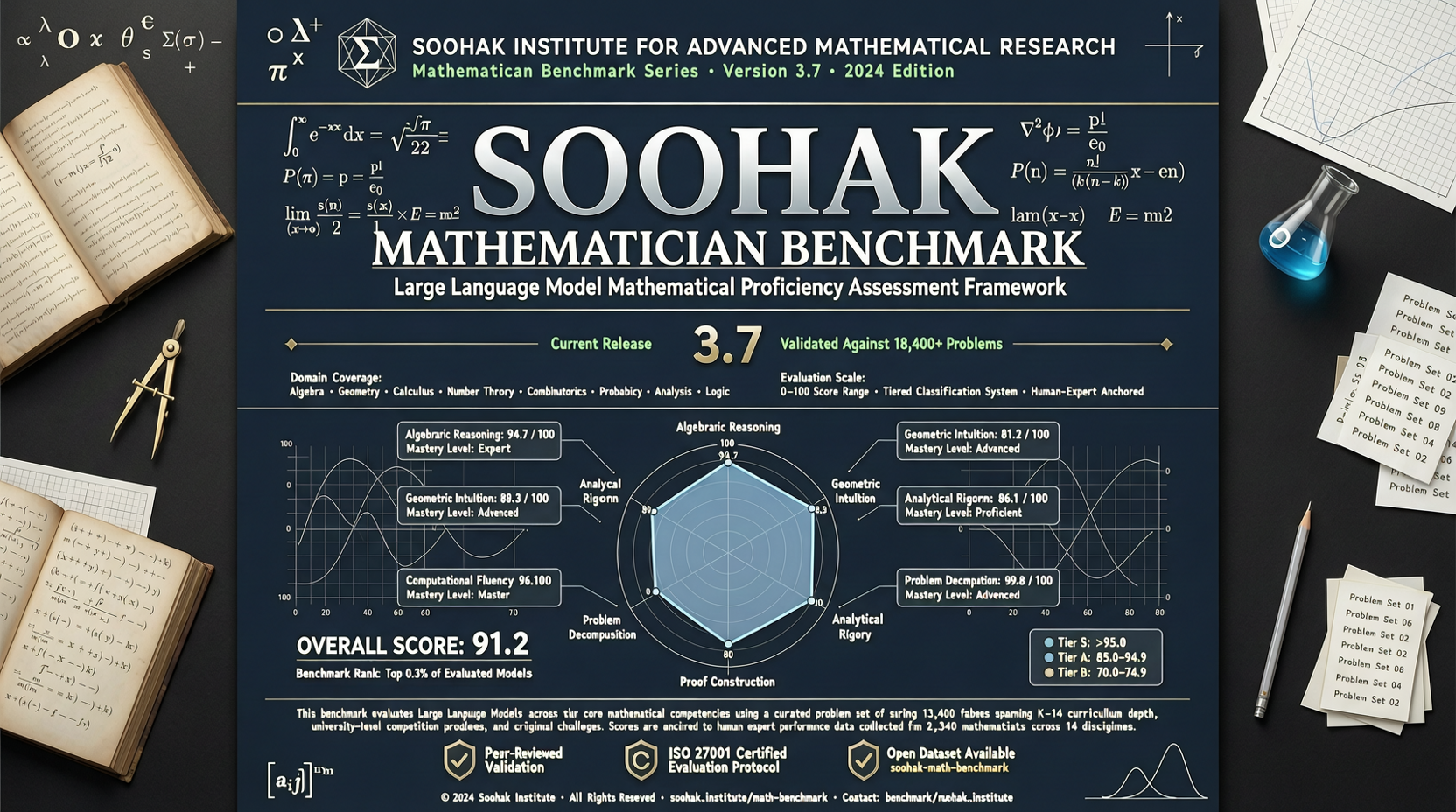

arXiv:2605.09063 发布的 Soohak benchmark 由 43 位数学家(是的,43 位)手工出题,覆盖从本科高年级到研究生级别的数学内容。这不是刷题库,这是出题库。

为什么要手工出题

现有的数学 benchmark 有几个问题:

数据泄露。 AIME 和 AMC 的题目在网上到处都是,模型在预训练阶段可能已经"背"过了。考的不是推理能力,是记忆能力。

难度天花板低。 GSM8K 是小学应用题级别,MATH 是高中竞赛水平。但对于评估 LLM 是否能做真正的数学研究,这些都不够。

覆盖窄。 大多数 benchmark 集中在代数和组合数学,数论、分析、拓扑等领域覆盖不足。

Soohak 的解决方式简单粗暴:让数学家出新的题。 这些题目不在网上,模型没见过,考的就是纯推理能力。

出题方式

43 位数学家来自 SNU、CMU、University of Washington 等机构。出题过程有几个关键设计:

- 每个题目都有完整的解答和评分标准

- 覆盖多个数学分支:代数、分析、几何、数论、拓扑、组合数学

- 难度从本科高年级到研究生级别

- 题目经过交叉验证,确保质量和正确性

这个 benchmark 的分量

参与机构包括了 EleutherAI、CMU(Sean Welleck、Graham Neubig)、KAIST 等在 AI 评测和数学推理领域有深厚积累的团队。

Sean Welleck 之前做过几篇重要的 LLM 数学能力论文,Graham Neubig 在 CMU 的 LLM 研究组是顶配。这个阵容说明 Soohak 不是一个小项目。

一个现实问题

手工出题的 benchmark 有一个天然局限:更新成本高。 每出一批题,需要数学家投入大量时间。如果社区用得好,题目会不会被泄露到训练数据里?

论文提到题目在审核中(under review),还没有公开发布数据集。这可能是出于防泄露的考虑。

我的看法

Soohak 的方向是对的。LLM 数学评测已经到了"现有 benchmark 快被刷穿"的阶段。需要新的、更干净的评测方式来区分"背题能力"和"推理能力"。

但我也保留一个判断:如果 Soohak 的题目最终公开了,大模型公司会不会用它们做 post-training 的强化学习?如果是,那 Soohak 的"干净性"也只能维持一轮评测。

这几乎是一个无解的困境:好的评测需要公开透明,但公开就意味着会被纳入训练数据。

也许最终的答案不是"出一个永远干净的 benchmark",而是建立一套持续更新的评测机制——像数学竞赛每年出新题一样,AI 数学评测也需要定期出题、定期更新。

主要来源:

- arXiv:2605.09063 - Soohak: A Mathematician-Curated Benchmark for Evaluating Research-level Math Capabilities of LLMs

- 提交者 amphora on HuggingFace Daily Papers 2026-05-12