“感觉变弱了”

2026年5月1日,中文AI社区出现了一个有趣的现象:多位用户在社交平台上反映,Claude Opus 4.7”好像变弱了”。

一个典型的观察是:

问了一圈很多人都觉得 Claude Opus 4.7 好像变弱了。更可能的原因是,它不再猜你想干嘛了——你写什么,它就严格做什么。

这不是孤立的声音。在Reddit、X/Twitter和各大AI社区,类似反馈正在增多。

但问题的关键不在于模型能力是否下降,而在于Anthropic改变了Claude的交互哲学。

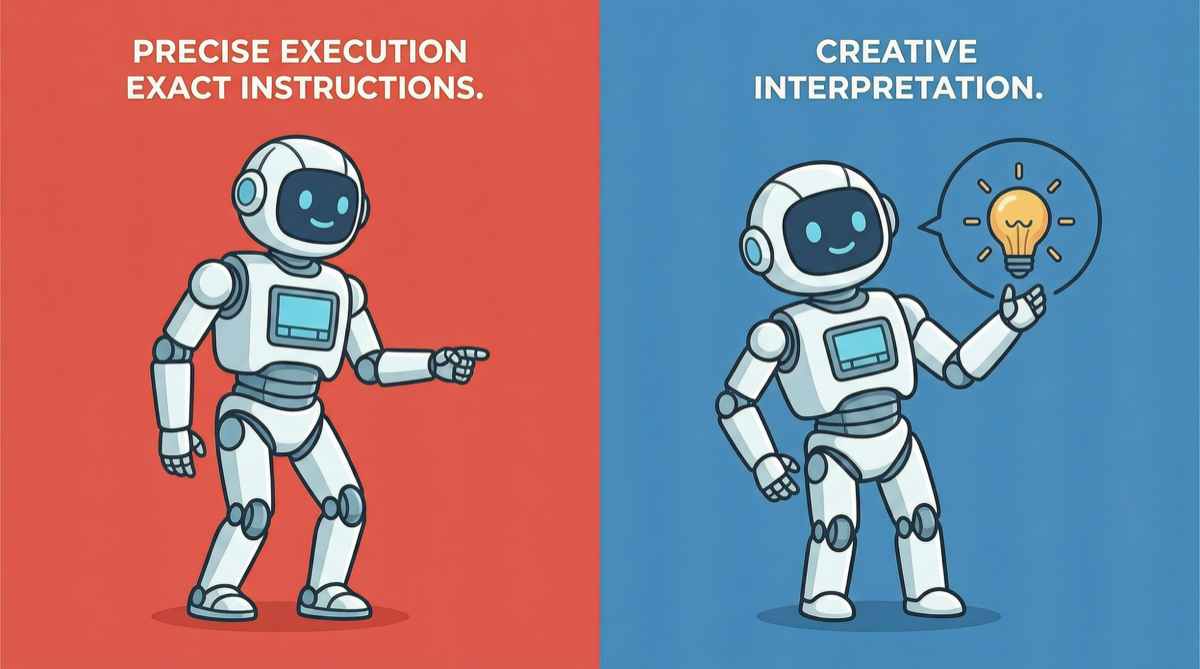

从”猜心思”到”听指令”

回顾Claude的迭代历程,Anthropic一直在调整一个核心平衡点:

主动帮助 vs 严格遵从

在之前的版本中,Claude倾向于:

- 推测用户的”真实意图”(即使表达不清晰)

- 主动补充用户未明确要求的内容

- 对指令进行”善意解读”和优化

这种策略的好处是:用户不需要写出完美的prompt,Claude会”帮你想到”。

但代价也很明显:

- 有时用户明确要求A,Claude却给了B(因为它”觉得B更好”)

- 在代码场景中,“自作主张”的修改可能引入bug

- 用户需要花时间”纠正”Claude的过度发挥

Opus 4.7的策略转变是:你写什么,我就做什么,不再替你做决定。

这不是退步,是对齐哲学的调整

从技术角度看,这涉及RLHF(人类反馈强化学习)目标函数的变化:

旧目标:最大化”用户满意度”——模型会主动补充和优化

新目标:最大化”指令遵从度”——模型严格按用户字面意思执行

两种目标没有绝对的优劣,只有适用场景的差异:

| 维度 | 猜心思模式 | 严格模式 |

|---|---|---|

| 创意写作 | ✅ 擅长补充和扩展 | ❌ 可能过于保守 |

| 代码生成 | ❌ 可能引入未请求的修改 | ✅ 严格按需求实现 |

| 数据分析 | ⚠️ 可能选择用户不需要的分析方法 | ✅ 只执行指定分析 |

| 翻译 | ✅ 擅长意译和语境适配 | ⚠️ 可能过于直译 |

| 自动化流程 | ❌ 可能偏离预期步骤 | ✅ 严格执行每个步骤 |

为什么Anthropic做出这个转变?

几个可能的原因:

1. 开发者用户的崛起

随着Claude Code成为核心产品,开发者用户占比大幅提升。开发者最需要的是可预测性——代码不能”差不多”,必须精确。对于开发者来说,“做我说的”远比”做你认为好的”重要。

2. Agent场景的需求

在Agent工作流中,Claude常常作为自动化流程的一个环节。这时”自作主张”是灾难性的——下游环节依赖精确的输入格式。

3. 安全合规的考量

“猜测用户意图”在安全层面存在风险:模型可能”善意地”做出用户未授权的决策。在企业和合规场景下,严格遵从是更安全的选择。

4. 用户反馈的积累

Anthropic的8.1万用户调查(3月底发布)可能提供了数据支持——大量用户反馈希望Claude更”听话”而非更”聪明”。

用户如何适应?

对于习惯”猜心思”模式的用户:

- 需要更明确地表达需求,包括”请主动补充你认为相关的内容”

- 对于创意任务,可以加指令:“请自由发挥,不必完全受我的框架限制”

- 理解这是策略调整,不是能力退化

对于开发者:

- 这对你来说是好消息——Claude Code的行为将更可预测

- 精确的指令将得到精确的执行

对于Agent工作流:

- 严格模式更适合自动化场景

- 减少了”AI擅自更改格式”导致的下游错误

行业视角:这是趋势,不是个例

Claude的策略转变并非孤立事件:

- GPT-5.5:也在增强指令遵从的精确性

- Qwen 3.6:针对agentic coding和tool use优化,本质上也是要求精确执行

- Gemini:Google Cloud CEO Kurian暗示新版本将更注重”可控性”

整个行业正在从”AI越聪明越好”向”AI越可控越好”转变。这标志着AI应用从”尝鲜阶段”进入”生产阶段”。

判断

Opus 4.7没有变弱,它只是不再替你思考。

对于需要AI辅助创意、扩展思路的用户,这可能需要适应期。

但对于需要AI精确执行任务的用户(开发者、Agent工作流、企业自动化),这是一个明确的进步。

Anthropic的选择很清晰:在生产场景中,可预测性比惊喜更重要。