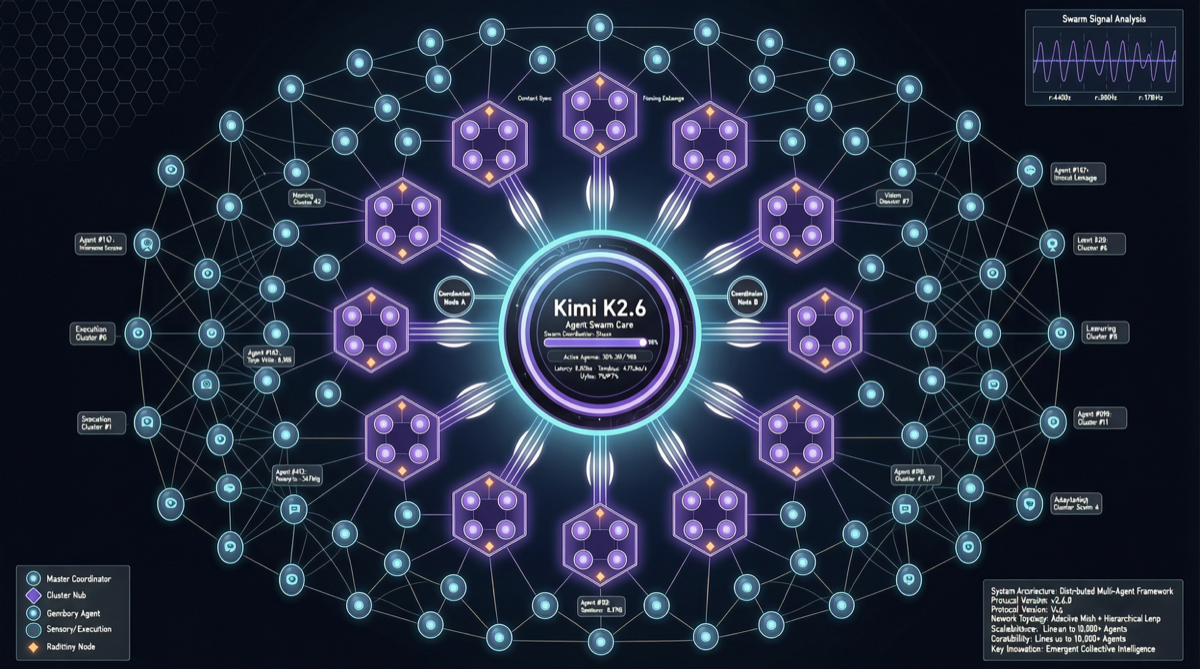

月之暗面(Moonshot AI)在 Kimi K2.6 基础模型之上,进一步推出了 Agent Swarm 架构——这不是普通的 API 升级,而是一套面向超大规模复杂任务的 Agent 编排系统。核心数据足以说明问题:300 个并行子代理、4000 步单次运行、100+ 文件一次性输出。

核心架构突破

并行规模:从 100 到 300 的跨越

| 维度 | K2.5 | K2.6 Swarm | 提升倍数 |

|---|---|---|---|

| 并行子代理 | 100 | 300 | 3x |

| 单次运行步长 | 1,500 | 4,000 | 2.67x |

| 最大输出文件 | ~30 | 100+ | 3x+ |

| 典型任务类型 | 单项目编码 | 文献综述/数据集/全栈应用 | 质的飞跃 |

这组数字背后是工程层面的系统性重构。300 个子代理不是简单地把任务拆分——它需要解决任务调度、依赖管理、冲突消解、结果聚合等一系列分布式系统难题。

输出是文件,不是对话

K2.6 Swarm 最显著的特征是 输出即产物:一次运行可以交付:

- 10 万字文献综述:自动检索、阅读、综合分析数百篇论文,输出结构化综述文档

- 2 万行数据集:从多源数据抓取、清洗、格式转换到最终交付

- 全栈应用脚手架:前端页面 + 后端 API + 数据库 Schema + 部署配置,100+ 文件一次性生成

这改变了 Agent 的使用模式——从”对话式探索”变为”产物式交付”。

实测能力拆解

编程能力基准

Kimi K2.6 在基础模型层面的指标已经足够说明竞争力:

| 基准测试 | K2.6 得分 | 行业对标 |

|---|---|---|

| HLE w/ tools | 54.0 | 开源 SOTA |

| SWE-Bench Pro | 58.6 | 接近 Claude Opus 4 |

| BrowseComp | 83.2 | 超越 GPT-5.5 |

| Math Vision w/ Python | 93.2 | 同级别最优 |

Agent Swarm 典型场景

场景 1:长周期代码重构

300 个子代理可以同时处理不同模块的重构任务,主代理负责协调合并。4000 步长足以覆盖大型代码库的全量分析和修改。

场景 2:学术研究自动化

输入研究问题 → Swarm 自动分配子代理进行文献检索、摘要生成、观点提取、交叉验证 → 输出万字级综述报告,附带引用溯源。

场景 3:数据分析流水线

从数据发现、清洗、特征工程到模型训练和可视化,每个环节由专门子代理负责,最终聚合为完整分析报告。

API 价格与市场定位

Kimi K2.6 API 已经上线,定价策略相当激进:

| 计费项 | 价格 |

|---|---|

| 输入(缓存命中) | $0.16 / M tokens |

| 输入(缓存未命中) | $0.95 / M tokens |

| 输出 | $4.00 / M tokens |

对比同级模型,这个价格区间具备明显竞争力——尤其是在大规模 Agent 场景下,缓存命中的 $0.16/M 可以显著降低 Swarm 多轮交互的成本。

格局判断

Kimi K2.6 Agent Swarm 的出现传递了一个明确信号:Agent 竞争的下半场是规模化,而不是单点能力。

- DeepSeek V4 走的是”参数规模”路线(1.6T MoE)

- Qwen 3.6 走的是”开源+性价比”路线

- Kimi K2.6 Swarm 走的是”Agent 编排规模化”路线

三条路线并行演进,但最终会收敛到一个问题:谁能让 Agent 可靠地完成最复杂的真实任务?

行动建议

- 研究者:立即尝试 Agent Swarm 的文献综述能力,300 子代理并行处理学术检索是此前不可能的规模

- 开发者:将 K2.6 集成到代码重构流程中,4000 步长意味着可以覆盖中型项目的全量重构

- 企业:评估 K2.6 的 $0.16/M(缓存命中)价格,对比当前 Agent 工作流的 token 消耗,可能带来 5-10 倍的成本优化

- 竞品关注者:重点关注 OpenClaw、Hermes 等 Agent 框架是否会原生适配 K2.6 Swarm 的多代理接口