核心结论

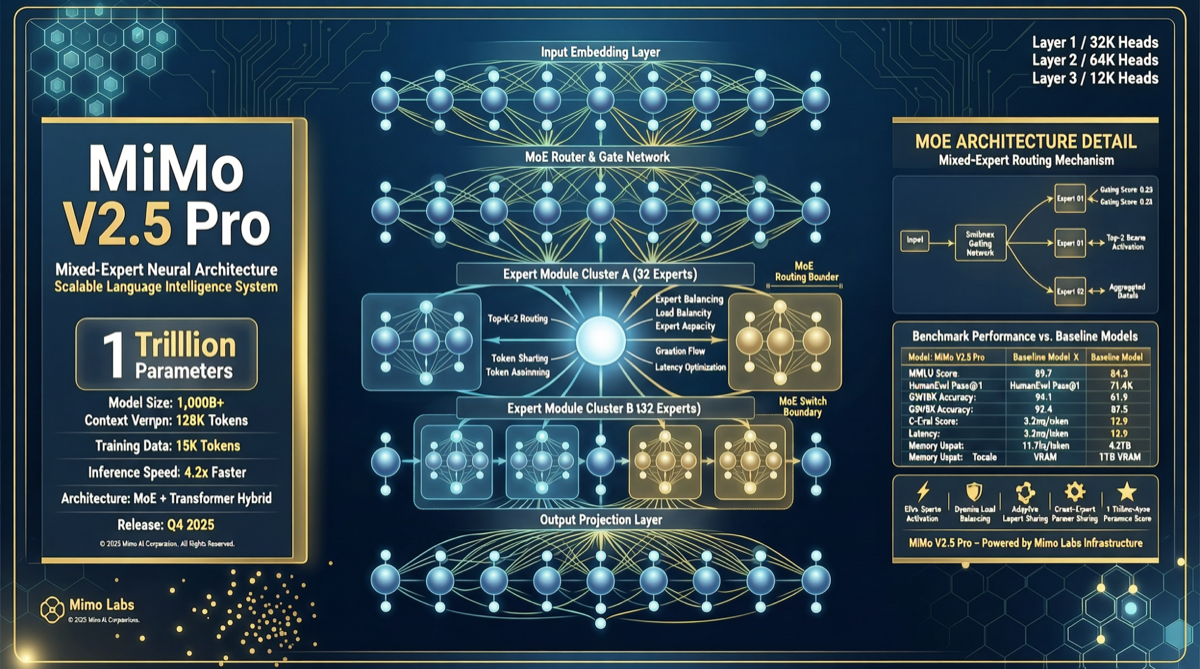

面壁智能(ModelBest)的 MiMo V2.5 Pro 以 1T MoE 架构 + 最高 100 万 token 上下文窗口的组合,在 Intelligence Index 评测中取得 54 分,与月之暗面 Kimi K2.6 并列国产开源模型的头部位置。对比全球模型,GPT-5.5 为 60 分,Gemini 和 Claude 系列为 57 分。

这不是一个”参数越多越好”的故事,而是一个国产模型在 MoE 架构效率 和 超长上下文 两个维度上同时发力的信号。

MiMo V2.5 Pro 关键数据

| 维度 | MiMo V2.5 Pro | Kimi K2.6 | DeepSeek V4 Pro | GPT-5.5 |

|---|---|---|---|---|

| Intelligence Index | 54 | 54 | 52 | 60 |

| 总参数量 | 1T (MoE) | 1T (MoE) | 1.6T (MoE) | 未知(闭源) |

| 激活参数量 | 约 54B | 未公开 | 49B | 未知 |

| 最大上下文 | 1M tokens | 1M tokens | 1M tokens | 未公开 |

| 开源状态 | Open Weights | Open Weights | Open Weights | 闭源 |

| 厂商 | 面壁智能 | 月之暗面 | 深度求索 | OpenAI |

关键信号:MiMo V2.5 Pro 的 Intelligence Index 得分 追平 Kimi K2.6,且 超过 DeepSeek V4 Pro(52 分)。在总参数量低于 DeepSeek V4 Pro 的情况下拿到更高分数,说明 MoE 的激活效率可能在架构设计上有所突破。

面壁智能的路径选择

面壁智能在国产模型中走了一条不同于百度、阿里、字节的路径:

- 不拼绝对参数规模:1T MoE 而非 1.6T,用更少的总参数达到同等或更高的 Intelligence Index 分数

- 死磕上下文窗口:1M token 上下文直接对标 Kimi K2.6 和 DeepSeek V4 Pro,面向长文档分析和代码库理解场景

- Open Weights 策略:与闭源的 GPT-5.5(60 分)差距仅 6 分,但开放权重让社区可以在消费级硬件上部署和微调

为什么这个排名值得注意

- MoE 效率竞赛升级:当 DeepSeek 用 1.6T 总参数/49B 激活参数拿到 52 分,MiMo 用 1T 总参数/54B 激活参数拿到 54 分时,激活参数的效率成为新的竞争焦点

- 1M 上下文不再是 Kimi 独家:MiMo V2.5 Pro 和 DeepSeek V4 Pro 都将上下文窗口推到 100 万 token,长文本处理的门槛正在被拉平

- 开源 vs 闭源的 6 分差距:MiMo(54 分)与 GPT-5.5(60 分)之间的差距正在缩小。对于不需要绝对顶配性能的场景,开源方案的成本效益比越来越有吸引力

行动建议

- 长文档分析场景:MiMo V2.5 Pro 的 1M 上下文使其适合处理百页级法律/金融文档,与 Kimi K2.6 形成直接竞争

- 消费级 GPU 部署:54B 激活参数意味着 Q4 量化后可在 48GB VRAM(如 RTX 4090 双卡或 A6000)上运行,适合本地化部署需求

- 与 DeepSeek V4 Pro 的选型:如果需要更低的 API 成本,DeepSeek V4 Pro 的限时 2.5 折优惠仍是最优选择;如果更看重开源生态和可微调能力,MiMo V2.5 Pro 值得测试

- 关注面壁智能后续:MiMo V2.5 Pro 作为开放权重模型,社区微调版本可能会在特定领域(如法律、医疗)超越原始分数

MiMo V2.5 Pro 的突围说明国产模型的竞争已经从”谁的参数多”进入”谁的架构效率高”的深水区。下一个关键变量是:谁能率先在 Agent 场景(多步推理 + 工具调用)中证明 MoE 架构的实际优势。