事件

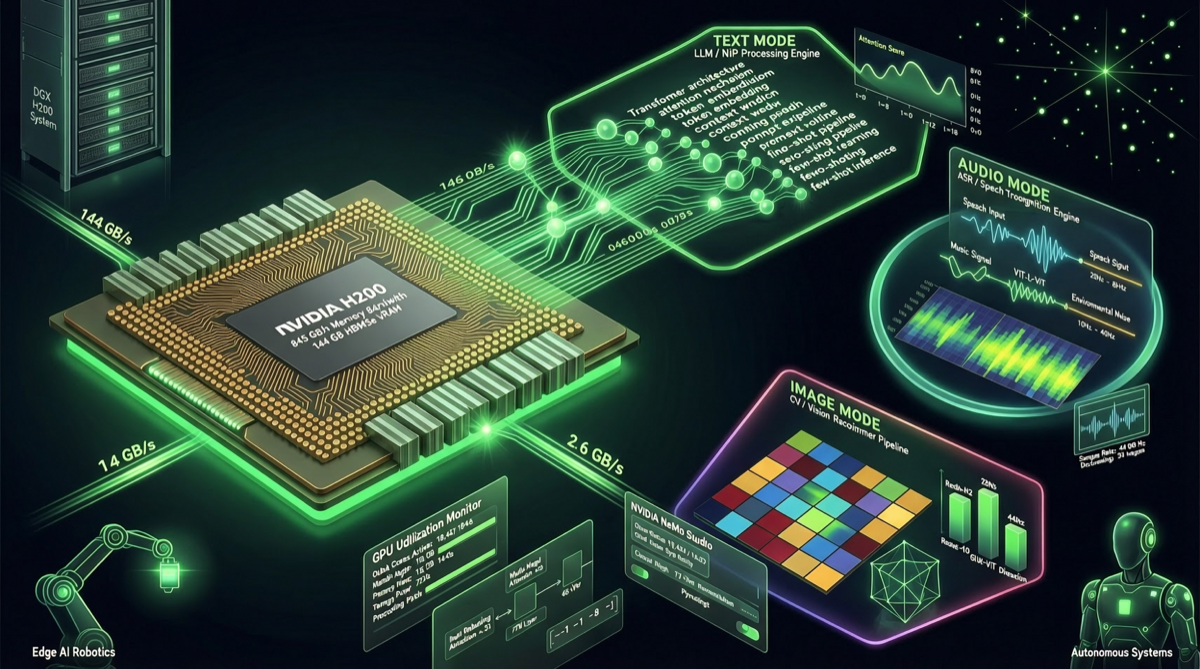

英伟达于 4 月 29 日正式发布了新一代开源全模态模型 Nemotron 3 Nano Omni。该模型主打效率和精度,深度优化了基于 Hopper 和 Blackwell 架构的 FP8 推理,同时兼容 RTX 5090 等消费级显卡以及 Jetson Thor 机器人平台。

更重要的是,新模型在 Agent 应用场景下实现了效率提升最高达 9 倍,标志着大模型竞争的焦点已从”能力上限”正式转向”应用效率”。

为什么值得关注

竞争范式的转变

过去一年的大模型竞争,本质上是围绕能力上限的较量:谁的 benchmark 分数更高、谁的上下文窗口更长、谁的代码生成能力更强。

进入 2026 年之后,竞争逻辑发生了根本性变化:谁能以最低的成本、最高的效率、最少的资源完成实际任务,成为了新的胜负手。

Nemotron 3 Nano Omni 的发布,正是这一范式转变的标志性事件。英伟达不再单纯追求模型规模的扩大,而是聚焦于单位算力的产出效率。

硬件兼容的革命性意义

Nemotron 3 Nano Omni 的硬件兼容策略极具深意:

- 消费级显卡(RTX 5090):让个人开发者和小团队无需购买企业级 GPU,即可运行高质量的全模态模型

- Jetson Thor 机器人平台:打通了从云端推理到边缘部署的完整链路,为 AI 机器人和 IoT 场景铺平道路

- Hopper/Blackwell 架构深度优化:在企业级场景下充分发挥英伟达硬件的算力潜力

这种”全栈覆盖”策略意味着,无论是个人开发者的本地 Agent、工厂产线上的质检系统,还是数据中心的多 Agent 编排,都能找到合适的部署方案。

技术亮点

全模态能力

Nano Omni 的核心突破在于全模态——单一模型即可处理文本、图像、音频等多种输入类型。这直接解决了 Agent 开发中的一个痛点:多模态任务通常需要串联多个专用模型,导致延迟高、成本高、调试复杂。

Nano Omni 的全模态能力让 Agent 可以用单一模型完成:

- 用户输入分析(文本/语音/图像)

- 多模态理解与推理

- 多模态输出生成

FP8 推理优化

深度优化的 FP8 推理是效率提升 9 倍的核心技术支撑。相比传统的 FP16 推理:

- 显存占用降低约 50%:同样的 GPU 可以运行更大的模型或处理更长的上下文

- 推理速度提升 2-3 倍:FP8 的计算吞吐率显著高于 FP16

- 精度损失可控:英伟达通过特定的量化策略,将精度损失控制在可接受范围内

Agent 原生设计

Nano Omni 的设计目标直指 AI Agent 的应用开发。模型在以下方面做了针对性优化:

- 工具调用能力:增强了对 MCP 协议和函数调用的原生支持

- 多步推理:优化的 Chain-of-Thought 推理路径,减少 Agent 在复杂任务中的”走弯路”

- 状态保持:改进的上下文管理机制,让 Agent 在多轮交互中更好地保持任务状态

对行业的影响

开源模型的”卖铲人”战略

英伟达此次发布 Nemotron 3 系列,延续了其”卖铲人”的战略定位。无论最终哪个模型赢得市场,都需要跑在英伟达的硬件上。通过开源高性能参考模型,英伟达实际上在:

- 展示硬件能力上限:让开发者看到在英伟达芯片上能跑得多快、多好

- 建立技术标杆:为整个行业设定效率和精度的参照系

- 推动生态繁荣:开源模型降低了开发门槛,吸引更多开发者进入 Agent 生态

Edge AI 的加速

Nano Omni 对消费级显卡和 Jetson 平台的支持,将大幅加速 Edge AI 的普及。过去,部署 AI Agent 需要云端 GPU 服务器,现在一台配备 RTX 5090 的工作站甚至 Jetson 嵌入式设备就能胜任。

这意味着:

- 隐私敏感场景(医疗、金融)可以在本地部署,无需数据上云

- 离线场景(工厂、矿山、野外)也能运行完整的 AI Agent

- 延迟敏感场景(实时控制、自动驾驶)可以实现毫秒级响应

信号与验证

- 英伟达官方发布,可信度高

- 9 倍效率提升的数据基于英伟达自己的 benchmark,需在独立环境中验证

- 开源策略降低了技术门槛,但 FP8 优化高度依赖英伟达硬件生态

- 全模态能力需要在实际 Agent 场景中评估

行动建议

- 评估 Edge AI 需求:如果你的业务有本地部署或低延迟需求,Nano Omni 值得重点评估

- 测试 FP8 推理:在目标硬件上实际运行 benchmark,验证效率提升数据

- 关注开源社区:Nano Omni 的开源属性意味着社区会快速产出适配方案和最佳实践

- 规划多 Agent 架构:更低的推理成本意味着可以部署更多专用 Agent,而非依赖单一通用模型