核心结论

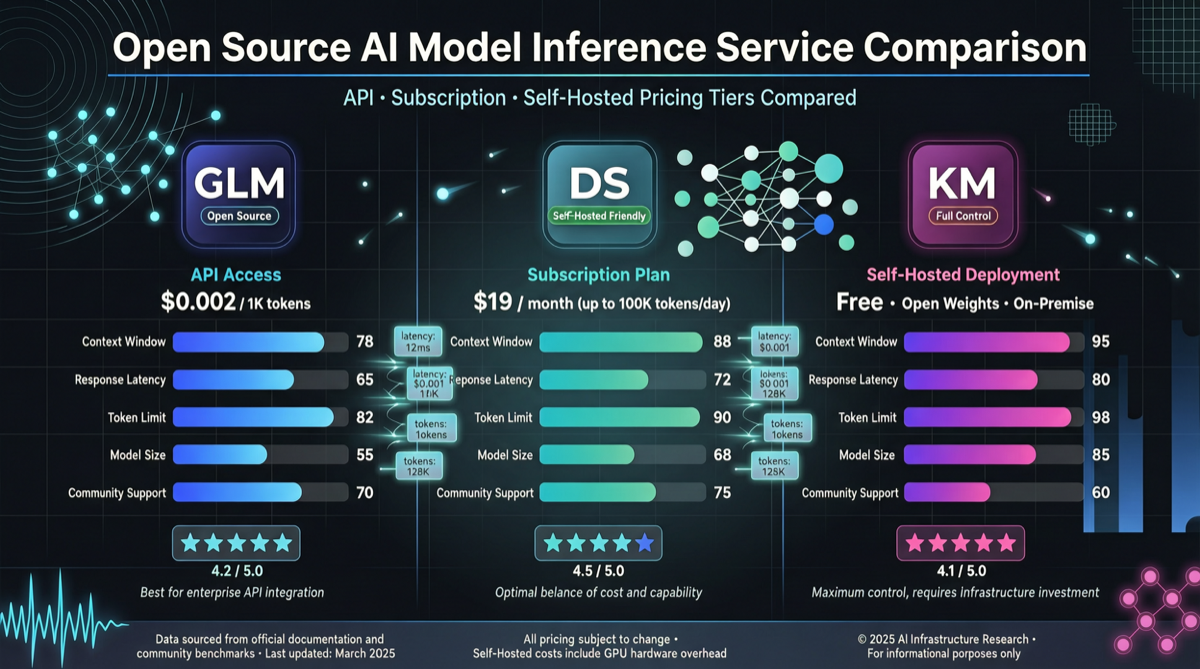

当 GLM-5.1、DeepSeek V4 Pro、Kimi K2.6 都能满足基本的 Agent 需求时,推理服务的选择就成了决定成本和体验的关键变量。

一位开发者实测了三个模型在官方 API、厂商订阅计划和 Ollama Cloud 上的表现,结论出人意料:对重度 Agent 用户来说,智谱 Coding Plan Max($80/月)能撑住每月 8 亿 token,而 DeepSeek V4 Pro 按量付费的总价也才约 $28。

两档典型场景

| 场景 | 月调用量 | 典型用户 |

|---|---|---|

| 轻度 | 1-2 亿 token | 个人开发者、日常辅助编码 |

| 重度 Agent | 5-10 亿 token | 企业级 Agent 集群、CI/CD 集成 |

GLM-5.1:订阅制的性价比王者

智谱的定价策略很激进——Coding Plan Max 每月 $80,不限调用次数。对重度 Agent 用户来说,这意味着每百万 token 成本低至 $0.01 以下,远低于按量付费的同行。

- 官方 API 按量:约 $1-2/百万 token,适合用量不稳定的场景

- Coding Plan Max:$80/月固定费用,8 亿 token 重度 Agent 可撑住

- Ollama 本地部署:需 2×A100 80GB,硬件门槛高但零 API 费用

隐私方面,订阅计划和 API 都需要将数据发送至智谱服务器;本地部署则数据完全不出内网。

DeepSeek V4 Pro:按量付费的绝对低价

DeepSeek V4 Pro 的定价策略简单粗暴——不玩订阅,直接按量给最低价。

- 官方 API:约 $3.50/百万 token,8 亿 token 约 $28

- 无订阅计划:暂时不提供包月方案

- 本地部署:模型体积巨大(万亿级 MoE),需要 8×H100 才能满血运行

DeepSeek 的优势是绝对单价低,劣势是对重度用户来说没有预算上限保护——用量翻倍费用就翻倍。而且本地部署门槛极高,基本排除了中小团队自托管的可能性。

Kimi K2.6:长文本场景的不可替代

Kimi K2.6 的核心竞争力不在价格,而在超长上下文——官方支持百万级 token 上下文窗口,这在法律文档分析、代码仓库全量理解等场景中几乎不可替代。

- 官方 API:价格介于 GLM 和 DeepSeek 之间

- 长文本专项:部分场景有额外优化

- 暂不开源:目前无法本地部署,只能用官方 API

速度对比

实测中,三个模型的首 token 延迟(TTFT)差异不大:

| 模型 | TTFT(中位数) | 生成速度 |

|---|---|---|

| GLM-5.1 | 200-400ms | 80-120 tok/s |

| DeepSeek V4 Pro | 300-500ms | 60-100 tok/s |

| Kimi K2.6 | 250-450ms | 70-110 tok/s |

实际 Agent 场景中,瓶颈通常在工具调用链路而非模型推理本身。

决策矩阵

| 你的情况 | 推荐方案 |

|---|---|

| 重度 Agent 用户,追求可预测成本 | GLM-5.1 Coding Plan Max |

| 用量波动大,追求绝对低价 | DeepSeek V4 Pro 按量 |

| 需要超长上下文处理 | Kimi K2.6 |

| 数据必须留在本地 | GLM-5.1 本地部署(需 GPU) |

| 预算有限但不想管理基础设施 | DeepSeek V4 Pro API |

一个趋势

2026 年的模型推理市场正在分化:基础层的按量价格战(DeepSeek 拉低底线)和应用层的订阅打包(智谱用 $80 包月锁定重度用户)同时上演。

对开发者来说,好消息是选择越来越多;坏消息是选择越来越复杂——你不再只需要选模型,还需要选推理服务的商业模式。