核心结论

在”90 天学会构建 AI Agent”的 GitHub 热门清单中,Pipecat 被列为第一个推荐项目——“支撑了大多数你实际用过的生产级语音 Agent”。

核心卖点:

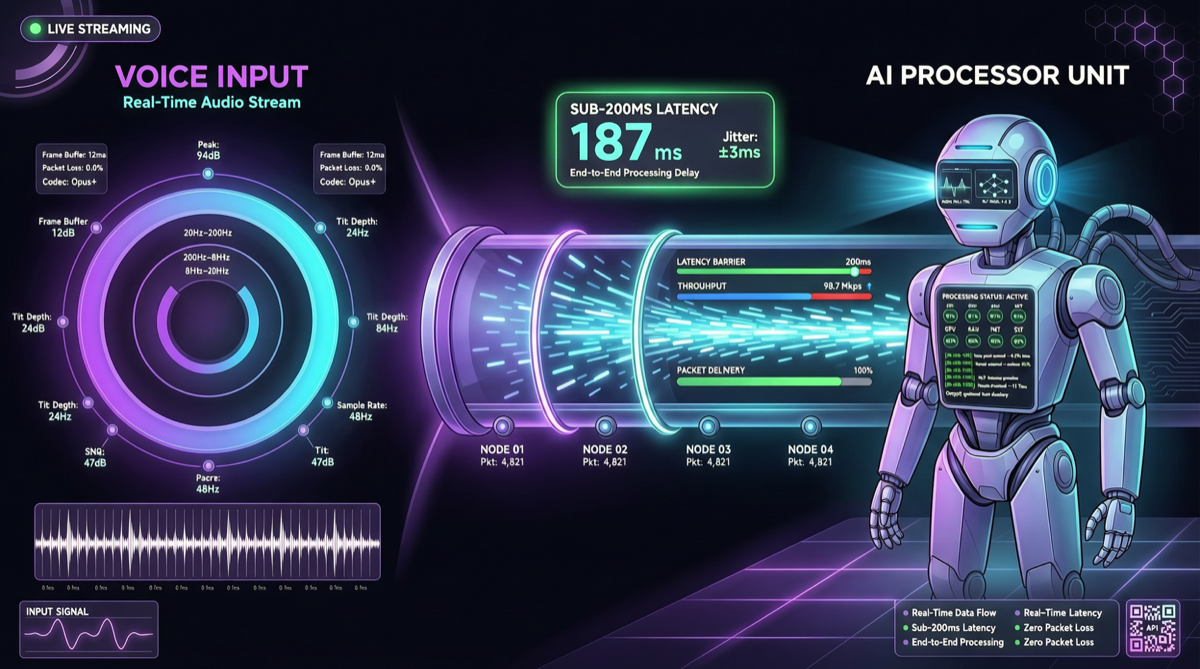

- <200ms 端到端延迟:从用户说话到 AI 回复的完整链路控制在 200ms 以内

- 生产级:不是 demo,而是为实际部署设计的框架

- Python 原生:对 Python 开发者友好

- 多模态管道:支持语音、文本、图像的流式处理管道

什么是 Pipecat

Pipecat 是一个实时语音 AI 框架,专注于构建低延迟的语音对话 Agent。它的核心架构是一个”管道”(pipeline)系统,将语音输入 → 语音识别 → LLM 推理 → 语音合成 → 语音输出串联为一条流式处理链。

架构概览

用户语音 → VAD(语音活动检测) → STT(语音转文本) → LLM → TTS(文本转语音) → 用户听到

↑ ↓

└──────────────── 流式处理 ──────────────────────────────┘关键设计决策:

- 全链路流式:每个环节都在实时处理,不需要等待上一环节完全结束

- VAD 驱动:只在检测到用户说话时才激活后续处理,节省计算资源

- 模型不可知:STT、LLM、TTS 三个环节可以独立选择不同供应商

核心组件

| 组件 | 功能 | 支持的供应商 |

|---|---|---|

| VAD | 检测用户何时在说话 | Silero, WebRTC |

| STT | 语音转文本 | Whisper, Deepgram, Google STT |

| LLM | 对话推理 | OpenAI, Anthropic, Groq, 本地模型 |

| TTS | 文本转语音 | ElevenLabs, Cartesia, OpenAI TTS, Coqui |

| Transport | 传输协议 | WebSocket, Daily.co, LiveKit |

竞品对比

| 框架 | 语言 | 延迟 | 实时语音 | 生产就绪 | 学习曲线 |

|---|---|---|---|---|---|

| Pipecat | Python | <200ms | ✅ 核心定位 | ✅ | 中等 |

| LiveKit Agents | Python/JS | <300ms | ✅ | ✅ | 低 |

| Vocode | Python | <400ms | ✅ | ✅ | 低 |

| Twilio Autopilot | - | >500ms | 有限 | ✅ | 低 |

| LangChain Voice | Python | >500ms | ✅(插件) | 实验性 | 高 |

Pipecat 的优势在于延迟控制和管道灵活性。<200ms 的延迟意味着对话体验接近真人通话(人类对话的平均响应延迟约 200-300ms)。

快速上手

安装

pip install pipecat-ai最小化示例

from pipecat.pipeline.pipeline import Pipeline

from pipecat.pipeline.runner import PipelineRunner

from pipecat.services.openai import OpenAILLMService

from pipecat.transports.services.daily import DailyTransport

# 配置传输层(使用 Daily.co)

transport = DailyTransport(

room_url="https://your-room.daily.co",

token="your-token",

bot_name="Pipecat Bot"

)

# 配置 LLM

llm = OpenAILLMService(model="gpt-5.4", api_key="your-key")

# 构建管道

pipeline = Pipeline([

transport.input(), # 接收音频

llm, # LLM 推理

transport.output() # 发送音频回复

])

# 运行

runner = PipelineRunner()

await runner.run(pipeline)自定义 STT + TTS

from pipecat.services.deepgram import DeepgramSTTService

from pipecat.services.elevenlabs import ElevenLabsTTSService

stt = DeepgramSTTService(api_key="dg-key")

tts = ElevenLabsTTSService(api_key="11labs-key", voice_id="Rachel")

pipeline = Pipeline([

transport.input(),

stt, # 语音转文本

llm, # 对话推理

tts, # 文本转语音

transport.output()

])典型应用场景

| 场景 | 配置建议 | 预计延迟 |

|---|---|---|

| 客服机器人 | GPT-5.4 + ElevenLabs | ~150ms |

| 语言陪练 | 本地模型 + Coqui TTS | ~180ms |

| 语音助手 | Groq + Cartesia TTS | ~120ms |

| 会议摘要 | Deepgram STT + Claude | N/A(非实时) |

成本估算

以一个日均 1000 通、每通平均 5 分钟的语音 Agent 为例:

| 组件 | 供应商 | 月成本(估算) |

|---|---|---|

| STT | Deepgram | ~$150 |

| LLM | GPT-5.4 | ~$500 |

| TTS | ElevenLabs | ~$200 |

| 传输 | Daily.co | ~$100 |

| 合计 | ~$950/月 |

如果使用 DeepSeek V4 Pro(折后价)替代 GPT-5.4,LLM 成本可降低约 90%,总成本降至 ~$500/月。

行动建议

- 语音 Agent 开发者:如果你正在构建实时语音对话应用,Pipecat 是目前 Python 生态中最成熟的选择。

- 现有 LangChain 用户:Pipecat 的管道概念与 LangChain 不同——它是为流式实时场景设计的,如果你的应用需要低延迟语音交互,值得考虑迁移。

- 成本控制:STT 和 TTS 的成本往往被低估,建议在项目早期就做好用量预估。Deepgram 和 Cartesia 的性价比值得关注。

- 本地部署:结合 Whisper.cpp(STT)和 Coqui TTS(语音合成),Pipecat 可以完全本地运行,适合对数据隐私要求高的场景。