核心判断

Qwen(通义千问)团队在社交媒体上确认:已跨越 27B 参数规模门槛,下一个目标是 8B 端侧模型。

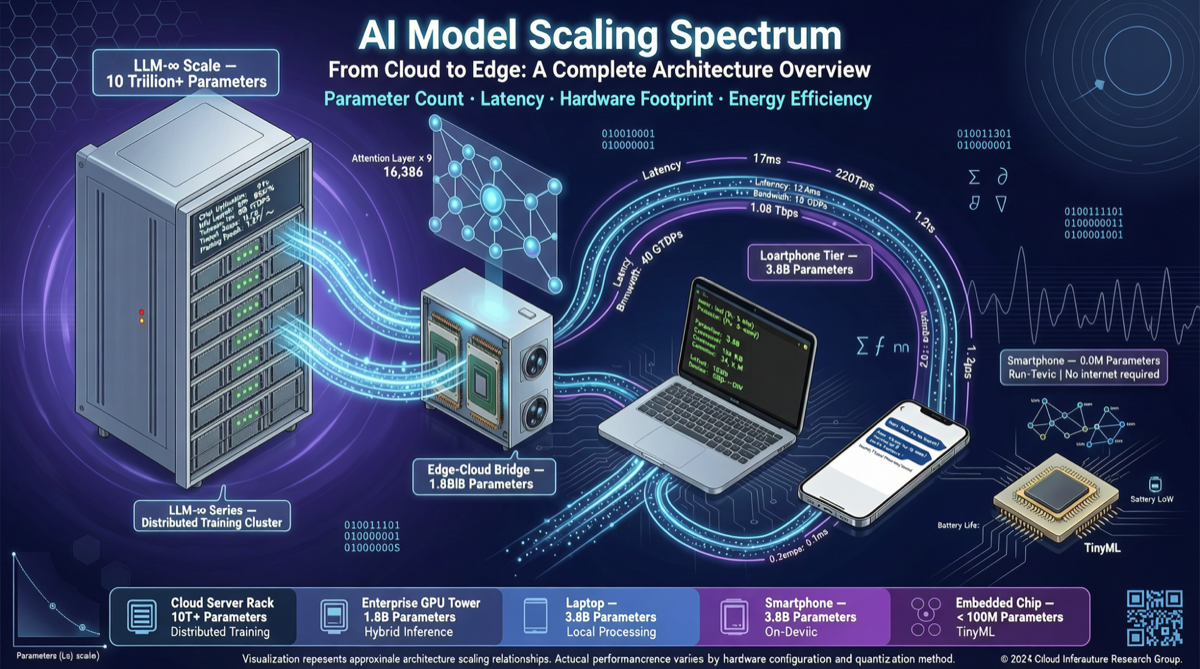

这不只是一个数字变化。结合 Qwen 3.6 系列已经公开的 35B MoE、3.6B 小模型以及 Max Preview 超大模型,阿里正在搭建一套从云端超大模型到消费级显卡端侧模型的全尺度开源矩阵。

规模路线图:Qwen 3.6 的四层架构

| 模型规格 | 参数量 | 定位 | 目标场景 |

|---|---|---|---|

| Qwen 3.6 Max Preview | 超大 (未公开) | 旗舰 API 模型 | 复杂推理、企业级任务 |

| Qwen 3.6 35B MoE | 35B 总 / 3.6B 激活 | 高效 MoE 架构 | 中等算力部署、成本敏感场景 |

| Qwen 3.6 27B | 27B 稠密 | 性能/效率平衡点 | 单卡 4090/5090 部署 |

| Qwen 3.6 8B (目标) | 8B 稠密 | 端侧轻量模型 | 笔记本/手机端侧推理 |

| Qwen 3.6 3.6B | 3.6B | 极致轻量 | 边缘设备、IoT |

这条路线的逻辑很清晰:先用 27B 树立性能标杆,再用 8B 做规模下沉。

为什么 8B 是下一个关键节点?

8B 参数在 2026 年具有特殊意义:

- 消费级 GPU 全覆盖:RTX 4060/4070(8-12GB 显存)即可全量加载 INT4 量化的 8B 模型

- Apple Silicon 原生运行:M4 MacBook(16GB 统一内存)可流畅运行 8B 模型推理

- 移动端部署可行:8B INT4 量化后约 4-5GB,已可放入高端手机内存

- 知识蒸馏最佳接收方:27B → 8B 的蒸馏链路成熟,性能损失可控制在 10% 以内

对标分析:Qwen vs Llama 开源战略

| 维度 | Qwen 3.6 | Llama 4 (Meta) |

|---|---|---|

| 最大开源模型 | 35B MoE | 405B 稠密 |

| 端侧目标 | 8B | 3B / 8B |

| MoE 支持 | 35B/3.6B | 是 |

| 中文优化 | 原生 | 需微调 |

| 商用许可 | 宽松 | 宽松 |

| 生态工具链 | ModelScope + vLLM | Ollama + LM Studio |

Qwen 的策略比 Llama 更务实——不追求最大参数,而是追求覆盖最广的部署场景。这更符合中国开发者的实际需求:不是每个人都有 H100,但很多人有 4090 甚至更低的显卡。

行动建议

- 如果你在评估 Qwen 3.6:关注 8B 版本的发布时间表,这将是消费级部署的关键节点

- 如果你在做端侧 AI 产品:8B Qwen 3.6 的 INT4 量化版本将是性价比最优选择之一

- 如果你在用 Llama 做端侧:Qwen 3.6 8B 在中文场景的性能优势值得纳入 A/B 测试

Qwen 的”从 27B 到 8B”不是缩小,而是降维打击——用更小的参数规模、更低的部署门槛,去覆盖更广泛的使用场景。