Вывод сразу

GPT-5.5 (выпущен 23 апреля) и Claude Opus 4.7 (выпущен 16 апреля) — две сильнейшие фронтальные модели, но у каждой свои зоны преимущества: Claude Opus 4.7 лидирует в продвинутом кодировании и точном следовании инструкциям, GPT-5.5 доминирует в понимании длинного контекста и агентских рабочих процессах. Вопрос не «кто сильнее», а «кто подходит для вашей задачи».

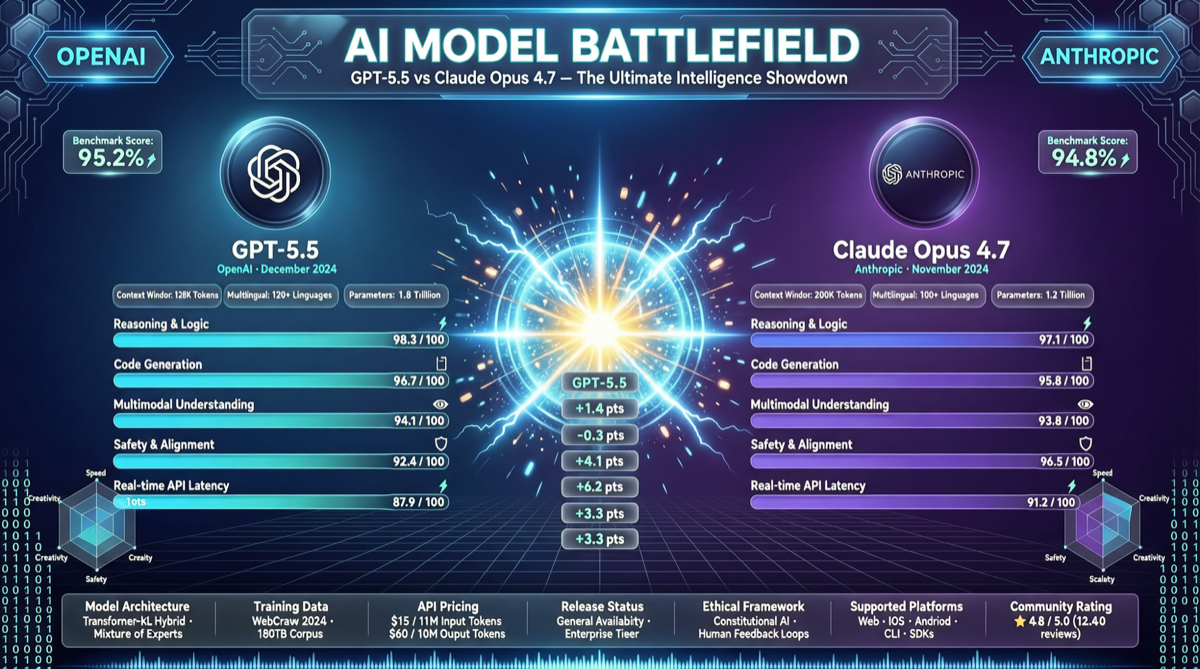

Сравнение бенчмарков

| Метрика | Claude Opus 4.7 | GPT-5.5 | Разница |

|---|---|---|---|

| SWE-bench Pro | 64.3% | 58.6% | Claude +5.7% |

| HLE (без инструментов) | 46.9% | 41.4% | Claude +5.5% |

| MRCR @ 1M контекст | 32.2% | 74% | GPT +41.8% |

| MLE-Bench | — | 36% | Только GPT |

| Terminal-Bench 2.0 | — | 82.7% | Только GPT |

Claude Opus 4.7 опережает GPT-5.5 на 5.7% в SWE-bench Pro. В HLE Claude лидирует 46.9% против 41.4%.

GPT-5.5 доминирует в MRCR с миллионным контекстом: 74% против 32.2% — почти вдвое. Это означает, что при обработке сверхдлинных документов, кодовых баз или наборов данных контекстуальные способности GPT-5.5 значительно сильнее.

Рекомендации по выбору

| Сценарий | Рекомендация | Причина |

|---|---|---|

| Сложный рефакторинг кода | Claude Opus 4.7 | Лидерство в SWE-bench Pro |

| Анализ документов с миллиона токенов | GPT-5.5 | MRCR @ 1M почти вдвое выше |

| Агентская автоматизация ML | GPT-5.5 | MLE-Bench 36%, Terminal-Bench 82.7% |

| Юридические/финансовые документы | Claude Opus 4.7 | BigLaw Bench 90.9% |

| Повседневное общение | Оба близки | LMArena Elo схожи |