Ключевые находки

Система памяти Hermes Agent недавно вызвала оживлённую дискуссию на X/Twitter (1180+ лайков, 271+ ретвитов, 1509 закладок). Её ключевая инновация заключается в исправлении системных недостатков обработки памяти, обнаруженных в OpenClaw и других ранних агентных фреймворках.

Если вы следили за системами памяти ChatGPT, Claude или OpenClaw, то знаете, что у этих агентов есть общая проблема: серьёзная потеря информации при сжатии памяти. Hermes Agent фундаментально решает эту проблему, перепроектируя архитектуру памяти.

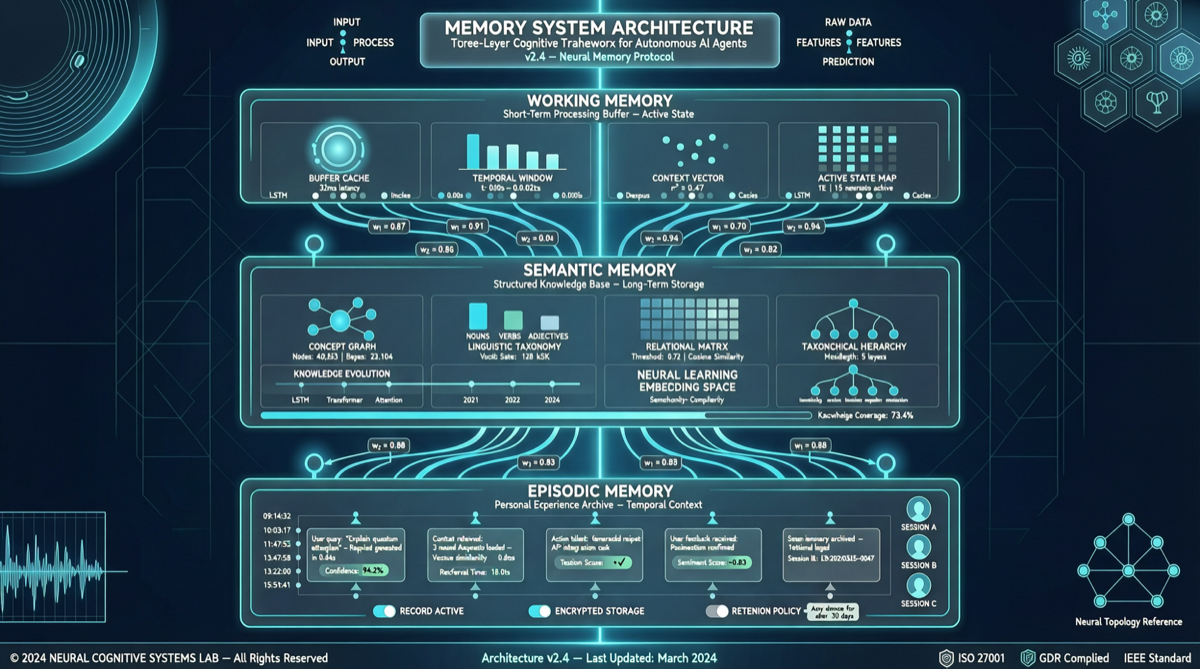

Трёхуровневая архитектура памяти

Hermes Agent использует трёхуровневую архитектуру памяти, каждый уровень которой обрабатывает информацию с разным временным масштабом и степенью абстракции:

1. Рабочая память

- Краткосрочный контекст текущего окна разговора

- Ограниченная ёмкость, но самая высокая скорость поиска

- Отвечает за немедленное переключение задач и поддержание краткосрочных целей

- Ключевой дизайн: В отличие от простого усечения OpenClaw, Hermes использует оценку важности задач для динамического сохранения

2. Семантическая память

- Долгосрочный накопленный граф знаний: предпочтения пользователя, структура проектов, часто используемые инструменты

- Хранится в структурированном формате, поддерживает семантический поиск

- Ключевой дизайн: Hermes внедряет механизм прогрессивной очистки — после каждого разговора автоматически извлекает новые семантические знания, а не просто добавляет их

- Это именно то, чего не хватает OpenClaw: память OpenClaw является «только для записи» — информация сохраняется, но редко активно пересматривается и интегрируется

3. Эпизодическая память

- Записывает конкретные исторические события взаимодействия: «В прошлый раз пользователь попросил меня изменить функцию Y в файле X»

- Поддерживает поиск по временной шкале и распознавание паттернов

- Ключевой дизайн: Hermes комбинирует тегирование событий + временное затухание, чтобы гарантировать, что важные исторические события не будут забыты, одновременно снижая вес устаревшей информации

Три заблуждения OpenClaw, исправленные Hermes

Заблуждение первое: Память = Конкатенация контекста

Обработка памяти OpenClaw по сути заключается в прямом присоединении фрагментов исторических диалогов к текущему контексту. У этого подхода есть две фатальные проблемы:

- Потребление токенов растёт линейно с длиной разговора

- Ключевая информация размывается шумом

Решение Hermes: Благодаря трёхуровневой архитектуре в текущий контекст инжектируются только наиболее релевантные воспоминания, что снижает потребление токенов примерно на 60%.

Заблуждение второе: Забывание = Удаление

Управление памятью OpenClaw использует простую стратегию FIFO (первым вошёл — первым вышел) — старые разговоры напрямую удаляются.

Решение Hermes: Забывание = Деградация. Важная информация деградирует из рабочей памяти в семантическую, затем в эпизодическую — а не удаляется напрямую. «Температура» информации постепенно снижается, но она никогда полностью не исчезает.

Заблуждение третье: Обновление памяти = Запись только добавлением

Обновление памяти OpenClaw — это одностороннее добавление — новые воспоминания добавляются после старых, без интеграции.

Решение Hermes: Цикл консолидации памяти. После каждого разговора Hermes запускает процесс организации памяти: слияние дублирующихся записей, обновление устаревшей информации и установление новых связей. Это аналогично процессу «консолидации во сне» у человека.

Значение локального исполнения

Ollama 0.21 официально поддерживает Hermes Agent, что означает возможность запуска этой системы памяти непосредственно на Mac или Linux локально. Это даёт два прямых преимущества:

- Нулевая стоимость проб и ошибок: Локальное выполнение означает, что разработчики могут свободно тестировать различные конфигурации памяти без затрат на API

- Гарантия конфиденциальности данных: Данные памяти хранятся полностью локально, не проходя через серверы третьих сторон

Выводы для разработчиков агентов

Дизайн памяти Hermes Agent передаёт важный сигнал: конкурентный фокус агентов смещается от «способности модели» к «системной инженерии». Одна и та же базовая модель, сопряжённая с различными архитектурами памяти, может создавать совершенно разный пользовательский опыт.

Для разработчиков, создающих агентные приложения, вопрос, достойный размышлений, больше не «какую модель использовать», а «как заставить модель запоминать то, что она должна запоминать».