Что произошло

Команда LangChain недавно опубликовала набор данных бенчмарков, вызвавших потрясение в сообществе AI-агентов:

Та же самая модель GPT-5.2-Codex, ноль изменений параметров, заменён только слой Agent Harness — балл Terminal-Bench прыгнул с 52,8% до 66,5%, чистый прирост 13,7 процентных пункта. Рейтинг взлетел из-за пределов Top 30 напрямую в Top 5.

Ещё более важно то, что LangChain опубликовала ещё одно наблюдение:

«Модели и harness КО-ЭВОЛЮЦИОНИРУЮТ. Модель становится лучше в определённых паттернах использования инструментов и петлях обратной связи. Harness становится лучше в извлечении способностей модели.»

Это означает: модели и scaffolding ко-эволюционируют. Модели становятся лучше в определённых паттернах вызова инструментов и петлях обратной связи, а harness — лучше в выжимании каждой капли способностей из модели.

Почему 13,7 балла важнее обновления модели

Последние 18 месяцев нарратив индустрии доминировался вопросом «кто выпустил модель большего размера». Данные LangChain бросили бомбу контр-нарратива:

| Измерение | Традиционный подход | Что раскрывает LangChain |

|---|---|---|

| Источник производительности | Параметры модели и данные обучения | Дизайн harness имеет равный вес |

| Путь оптимизации | Ждать обновления модели | Изменить собственный scaffolding |

| Конкурентный ров | Вычисления/данные | Инженерная архитектура |

| Структура затрат | Платить за более сильные модели | Платить за лучший дизайн |

Что такое Terminal-Bench

Terminal-Bench — это бенчмарк, измеряющий способность AI-кодинг-агентов выполнять задачи в реальных терминальных средах. В отличие от SWE-bench (исправление кода), Terminal-Bench оценивает полнопроцессные способности агента в среде командной строки: настройка окружения, установка зависимостей, отладка, операции с файлами — гораздо ближе к ежедневной работе реального разработчика.

Скачок с 52,8% до 66,5% означает, что агент перешёл из состояния «часто застревает на полпути» в состояние «способен самостоятельно завершать большинство терминальных задач».

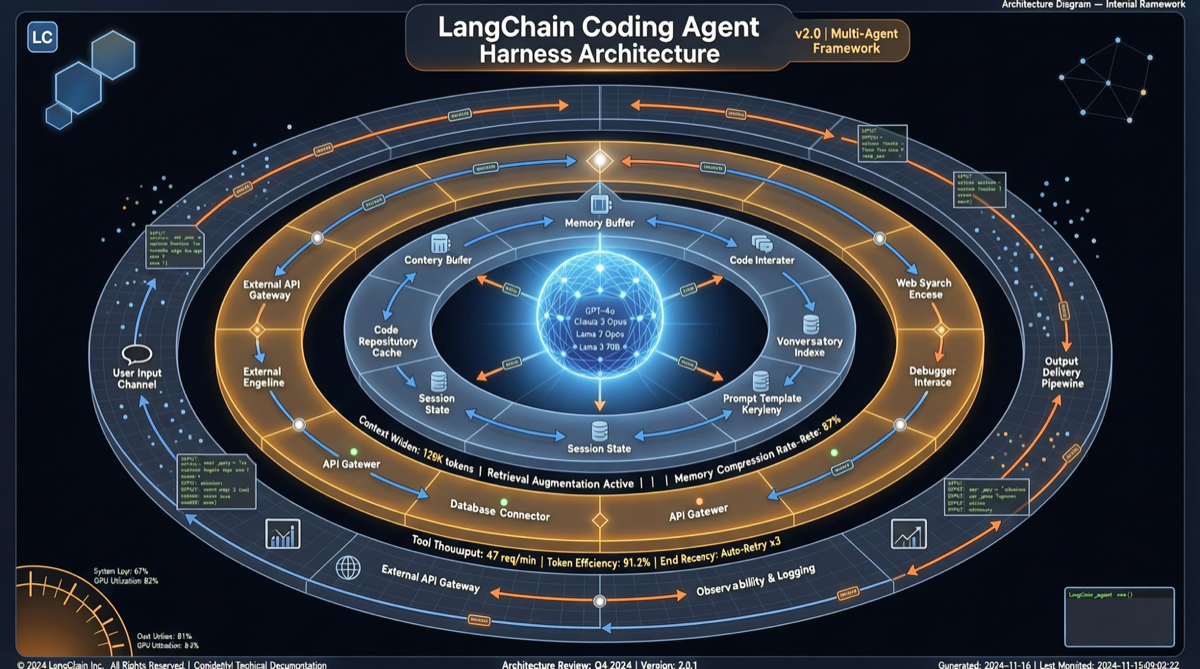

Что именно изменилось в Harness

На основе публичных подсказок LangChain и отраслевого анализа, ключевые улучшения сконцентрированы на трёх уровнях:

1. Стратегия управления контекстом

- Динамическое сжатие: не простое отсечение, а интеллектуальное сохранение критического контекста

- Слоистая история вызовов инструментов: недавнее = детально, старое = резюме

- Осознание файловой системы: автоматическая идентификация, какие состояния файлов требуют сохранения

2. Оркестрация вызовов инструментов

- Параллельные вызовы инструментов: несколько независимых операций выполняются одновременно

- Логика повторных попыток при ошибках: дифференцированные стратегии восстановления для разных типов ошибок

- Композиция цепочек инструментов: атомарные операции, составленные в составные инструменты

3. Дизайн петли обратной связи

- Механизм самокоррекции: агент самопроверяется перед выводом

- Инкрементальная валидация: мгновенные проверки после каждого шага, а не единая финальная проверка

- Обучение на ошибках: случаи неудачи преобразуются в ограничения для следующего выполнения

Влияние на индустрию: Harness как конкурентоспособность

Эти данные меняют конкурентную логику индустрии AI-агентов:

Для вендоров моделей

Если одна и та же модель показывает разницу в 13+ баллов под разными harness, то простая реклама «лидер по бенчмаркам» теряет смысл. Модели становятся товаром; harness — это место дифференциации.

Для фреймворков агентов

Фокус конкуренции для LangChain, CrewAI, Dify, OpenClaw, Hermes Agent и подобных фреймворков смещается. Тот, кто спроектирует лучший harness, сможет заставить «ту же модель» показать результаты высшего уровня.

Для разработчиков

Вам не нужно ждать следующего релиза модели для улучшения способностей вашего агента — оптимизация дизайна harness может принести больший скачок производительности. Это самый действенный инсайт 2026 года.

Ключевые принципы инженерии Harness

На основе данных LangChain и отраслевой практики, вот проверенные принципы дизайна harness:

| Принцип | Описание | Эффект |

|---|---|---|

| Контекстно-зависимое сжатие | Сохранять контекст по важности, а не по времени | Сокращает потерю критической информации |

| Выравнивание паттернов инструментов | Структура harness согласована со средой обучения модели | Разблокирует предобученные способности |

| Слоистая память | Краткосрочная детализация + среднесрочное резюме + долгосрочный индекс | Прорывает лимит контекстного окна |

| Ошибка как данные | Вывод ошибки преобразуется в ограничение для следующего шага | Непрерывное само Improvement |

| Минимальное вмешательство | Вмешиваться в решения модели только при необходимости | Сохраняет способность модели к рассуждению |

Оценка ландшафта

Эксперимент LangChain на 13,7 балла — не изолированный результат, а микрокосм тренда:

Во второй половине 2026 года конкуренция AI-агентов сместится от гонки параметров моделей к гонке инженерии архитектуры harness.

Это открывает окно возможностей для небольших команд — вам не нужно тренировать большие модели, нужно просто спроектировать лучшие harness. Как продемонстрировал LangChain, хороший harness может заставить «не топ-уровневую» модель показать результаты топ-уровня.

Рекомендации к действию

- Если ваш агент работает не так, как ожидалось, не меняйте модель первым делом — проаудируйте дизайн вашего harness, оптимизируя управление контекстом, оркестрацию инструментов и петлю обратной связи по одному

- Сосредоточьтесь на соответствии модели и harness — разные модели имеют разные предпочтения вызова инструментов; harness нуждается в целевом дизайне

- Постройте систему оценки harness — тестируйте ваш harness систематически, как вы тестируете модели, сравнивая разные дизайны под одной моделью

- Рассмотрите open-source решения harness — подход LangChain предполагает, что паттерны harness могут стать новой ареной open-source конкуренции

Эпоха harness наступила. Модели предоставляют потолок способностей; harness определяет, сколько из него вы можете достичь.