Mistral только что сделала несколько контринтуитивный шаг.

За последние два года стратегия поставщиков моделей была «специализированные инструменты для специализированных задач» — модели для рассуждений, модели для чата, модели для кодирования. Пользователи выбирают модель под свой сценарий или, что чаще: вызывают разные API для разных задач.

Mistral Small 4 перекрыла эту дорогу полностью.

Одна модель с рассуждением уровня Magistral, мультимодальным вводом Pixtral и возможностями кодирования Devstral. Пользователям больше не нужно выбирать модель — они просто говорят ей, насколько глубоко думать.

Ключевые цифры

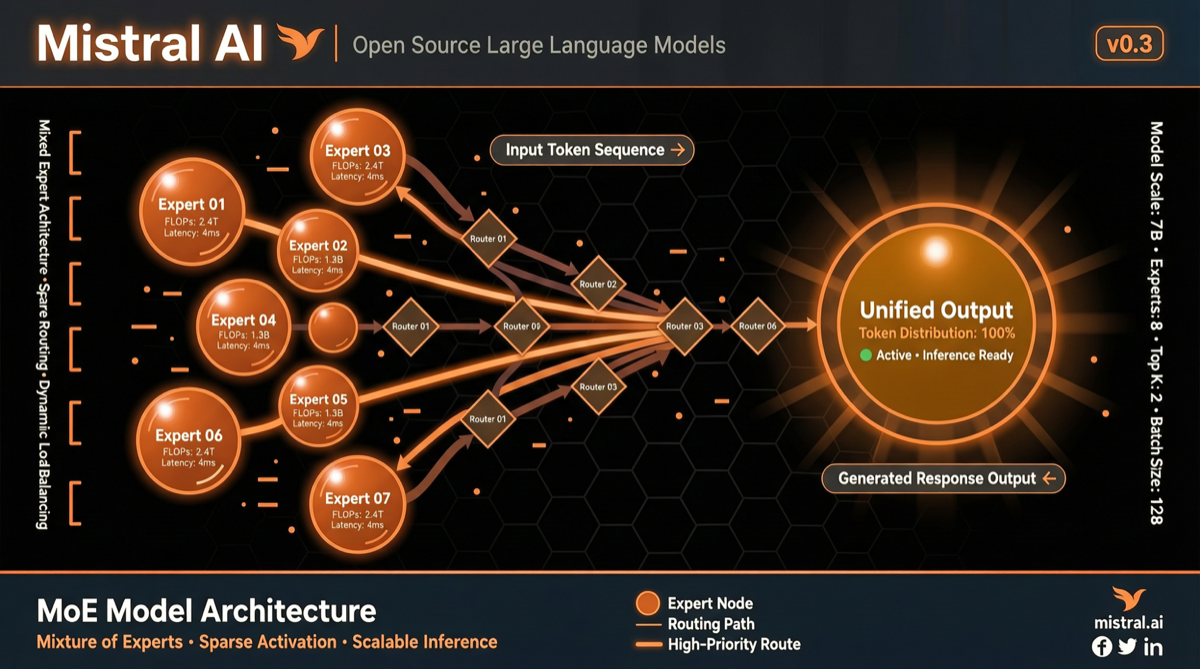

119B общих параметров, 128 экспертов, 4 активных на токен — примерно 6B активных параметров на токен (около 8B включая embedding и выходные слои). Контекстное окно 256K. Apache 2.0 открытый исходный код.

Настраиваемая глубина рассуждения — самый интересный элемент дизайна. Можно включить режим «быстрого ответа» для низкой задержки или переключиться на режим глубокого рассуждения, где модель решает задачи пошагово. Одна модель, два режима работы.

Официальные показатели: по сравнению с Mistral Small 3 время завершения сократилось на 40% в сценариях оптимизации задержки, а количество запросов в секунду утроилось в сценариях оптимизации пропускной способности.

Бенчмарки: эффективность вывода важнее баллов

На бенчмарке AA LCR Mistral Small 4 набирает 0.72 при объёме вывода всего 1.6K символов. Модели Qwen нуждаются в 5.8-6.1K символов для сопоставимых результатов — разница более чем в три раза.

Речь не о том, кто набрал больше баллов. Короткий вывод означает более низкую задержку, меньшую стоимость API и более прямой пользовательский опыт. Модель, которой нужно в три раза больше текста для того же результата, обойдётся дороже при масштабировании.

На LiveCodeBench Small 4 превосходит GPT-OSS 120B, создавая при этом на 20% меньше вывода. Эта разница в эффективности быстро превращается в разницу в стоимости при большом объёме вызовов.

Развёртывание

Рекомендуемая конфигурация: 4x HGX H100, 4x HGX H200 или 2x DGX B200. Партнёрство с NVIDIA реализовано через оптимизацию фреймворков vLLM и SGLang. Сообщество уже обеспечило поддержку через llama.cpp, Transformers и SGLang.

Для локального запуска 119B общих параметров означает минимум 200GB+ видеопамяти. Преимущество MoE-архитектуры: при реальном выводе активна лишь часть параметров, поэтому порог развёртывания после квантования значительно ниже.

Оценка

Позиционирование Small 4 ясно: она не соревнуется с Opus или GPT-5.5 по абсолютной мощности. Её преимущество — «одна модель покрывает большинство сценариев и работает дёшево».

Для небольших и средних команд этот подход привлекателен. Вместо поддержки трёх-четырёх различных API-интеграций, отладки и логики fallback можно использовать один Small 4 для чата, анализа документов, простого кодирования и рассуждений. Немного жертвуешь потолком, но значительно упрощаешь развёртывание.

Но если нужна лучшая глубина рассуждений или навыки кодирования, позиционирование Small 4 как «умеет всё, но не является лучшим ни в чём» может не подойти. Её кодирование на уровне Devstral — достаточно, но не на уровне лидеров SWE-bench.

Mistral выбрала путь прагматизма. В 2026 году, когда избыток возможностей моделей сочетается с высокой чувствительностью к стоимости, история «одна модель делает всё» resonирует с реальными покупателями больше, чем «мы первые в чём-то».

Следующее, за чем стоит наблюдать: покажет ли настраиваемый режим рассуждения Small 4 такие же результаты в реальных сценариях, как на бенчмарках. «Глубокое рассуждение» в бенчмарк-среде и в реальных рабочих процессах — часто две разные вещи.

Связанные статьи:

Основные источники: