Ключевые данные

| Параметр | FlashKDA | FLA Baseline | Ускорение |

|---|---|---|---|

| Прямой вывод (H20) | Оптимизированное ядро CUTLASS | flash-linear-attention | 1.72×–2.22× |

| Пакетная обработка переменной длины | Нативная поддержка | Требуется ручная обработка | ✅ |

| Совместимость бэкенда | Прямая замена | — | Plug-and-play |

| Базовый фреймворк | CUTLASS | Triton | Официальный стек оптимизации NVIDIA |

Технические особенности

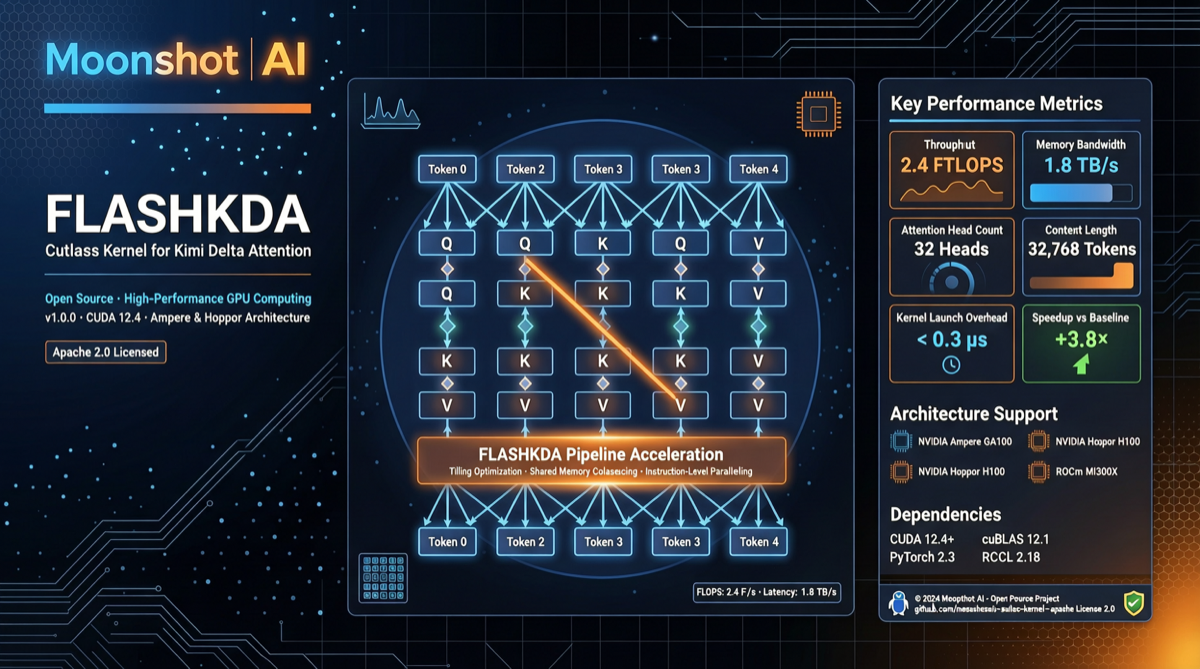

Что такое Delta Attention? Архитектура Delta Attention, используемая в моделях серии Kimi K2, отличается от традиционного самовнимания Transformer — она сокращает избыточные операции за счёт инкрементальных вычислений, что особенно подходит для сценариев с длинным контекстом. Moonshot ранее выпустила реализацию на базе Triton, но оставался prostor для оптимизации производительности.

Почему CUTLASS? CUTLASS — это официальная библиотека CUDA-шаблонов от NVIDIA, та же основа, на которой построен FlashAttention-3. По сравнению с Triton, CUTLASS обеспечивает более точный контроль над иерархией памяти GPU и планированием потоков, что особенно заметно на H20 и других отечественных вычислительных картах.

Ценность пакетной обработки переменной длины В реальных сценариях вывода длины последовательностей значительно различаются между запросами. FlashKDA нативно поддерживает пакетную обработку переменной длины, избегая потерь на заполнение традиционных подходов и напрямую повышая пропускную способность.

Сравнение с Qwen FlashQLA

| FlashKDA (Moonshot) | FlashQLA (Qwen) | |

|---|---|---|

| Целевая архитектура | Delta Attention | GDN (Gated Delta Network) |

| Базовый фреймворк | CUTLASS | TileLang |

| Ускорение на H20 | 1.72×–2.22× | 2–3× |

| Дата open-source | 2026-04-21 | 2026-04-29 |

| Применимые модели | Серия Kimi K2 | Qwen3-Next/3.5/3.6 |

Оба проекта представляют собой независимые исследования китайских команд в области оптимизации ядер внимания. Moonshot выбрала путь CUTLASS, а Qwen — TileLang. Для команд, стремящихся оптимизировать вывод на отечественных моделях, эти два проекта предлагают две различные технические траектории.

Практическое значение

Для пользователей Kimi: Если вы развёртываете или файн-тюните модели серии Kimi K2 локально, FlashKDA может напрямую заменить существующий бэкенд внимания без изменения кода модели.

Для разработчиков оптимизации вывода: Это высококачественная справочная реализация ядра внимания на CUTLASS — структура кода пакетной обработки переменной длины заслуживает изучения.

Для закупки вычислительных ресурсов: Бенчмарки на H20 показывают, что оптимизация на уровне программного обеспечения может извлечь больше производительности из существующего оборудования — не обязательно ждать следующего поколения чипов.

Начало работы

git clone https://github.com/moonshot-ai/FlashKDA.git

cd FlashKDA

pip install -e .После установки может напрямую использоваться как бэкенд flash-linear-attention:

from flash_linear_attention import set_backend

from flashkda import KDACudaBackend

set_backend(KDACudaBackend())Оценка ландшафта

Китайские команды крупных моделей переходят от «инноваций в архитектуре моделей» к «глубокой оптимизации низкоуровневых операторов». Последовательный open-source FlashKDA и FlashQLA знаменует начало конкуренции между двумя техническими направлениями. Тот, кто получит преимущество в стоимости вывода и задержке, займёт лидирующую позицию на рынке Edge/Device Agent.