Ключевой вывод

Маршрутизация нескольких моделей больше не является теоретической — разработчик уже подтвердил её жизнеспособность в реальной производственной среде. Интеллектуальная маршрутизация различных задач на наиболее подходящую модель позволила снизить месячные затраты на API с $500+ до менее $100 при сохранении качества вывода.

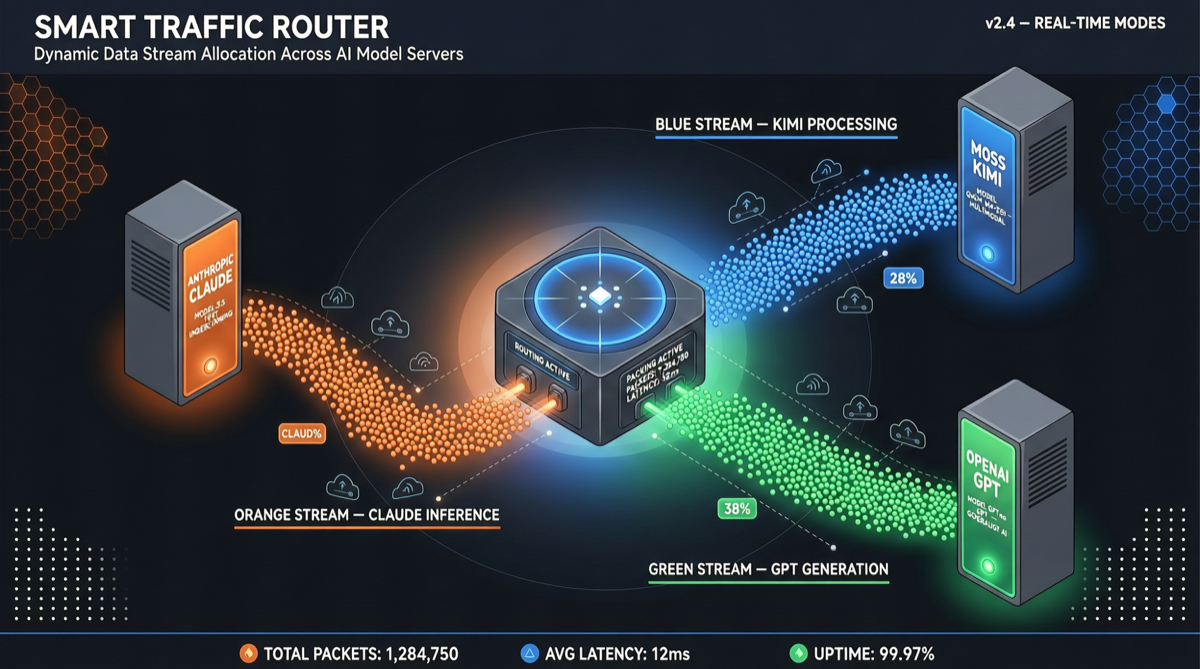

Это не «соглашаться на более дешёвые модели» — это использовать правильную модель для каждой задачи: Claude для кода, Kimi для длинных документов, GPT для многошаговых рассуждений — каждая задача находит модель с наилучшим соотношением цены и качества.

Зачем создавать маршрутизатор?

Ловушка одной модели

Подход большинства разработчиков — «выбрать самую сильную модель и использовать её для всего». У этого три проблемы:

| Проблема | Проявление | Последствие |

|---|---|---|

| Избыточное потребление | Использование Opus 4.7 для простой классификации текста | Трата в 10 раз больше денег за 1x работу |

| Несоответствие способностей | Использование GPT-5.5 для генерации кода | Качество уступает Claude |

| Единая зависимость | Подключение только к API одной модели | Один сбой = полный паралич |

Ключевая логика маршрутизации

Задача поступает → Определение типа → Оценка потребности в способностях → Выбор модели → Вывод → Проверка качества

↓ (если качество не проходит)

Обновление до более сильной модели и повторФактическая стратегия маршрутизации

Правила маршрутизации этого разработчика

| Тип задачи | Основная модель | Резервная модель | Причина выбора |

|---|---|---|---|

| Генерация кода/Отладка | Claude Opus 4.7 | GPT-5.5 | Claude лидирует в способностях кода |

| Анализ длинных документов | Kimi K2.6 | DeepSeek V4-Pro | Kimi превосходит в понимании длинного контекста |

| Многошаговые рассуждения/Агент | GPT-5.5 | Claude Opus 4.7 | GPT имеет более сильные вызовы инструментов и планирование |

| Простой чат/Перевод | Kimi K2.6 (бесплатно) | Qwen3.6-Plus | Самый дешёвый вариант |

| Креативное письмо | Claude Opus 4.7 | GPT-5.5 | Стиль письма Claude более естественный |

| Анализ данных | DeepSeek V4-Pro | GPT-5.5 | Лучшее соотношение цены и качества для анализа длинного контекста |

Сравнение затрат

При обработке 10 000 задач ежемесячно:

| Подход | Месячные затраты | Среднее качество |

|---|---|---|

| Всё Claude Opus 4.7 | ~$500 | 95/100 |

| Всё GPT-5.5 | ~$400 | 92/100 |

| Маршрутизация нескольких моделей | ~$85 | 94/100 |

Ключевые цифры: Подход маршрутизации стоит лишь 17% от подхода с одной Claude при почти идентичном качестве. Экономия достигается за счёт:

- 40% задач (простой чат/перевод) направляются на бесплатные/дешёвые модели

- 30% задач (длинные документы) направляются на более экономичную Kimi

- Только 30% высокоценных задач используют Opus 4.7

Как создать свой маршрутизатор

Минимальная работоспособная версия

class ModelRouter:

ROUTING_RULES = {

"code": {"primary": "claude-opus-4-7", "fallback": "gpt-5.5"},

"long_context": {"primary": "kimi-k2.6", "fallback": "deepseek-v4-pro"},

"reasoning": {"primary": "gpt-5.5", "fallback": "claude-opus-4-7"},

"simple": {"primary": "kimi-k2.6", "fallback": "qwen3.6-plus"},

}

def route(self, task_type: str, prompt: str, budget: str = "normal"):

rule = self.ROUTING_RULES.get(task_type, self.ROUTING_RULES["simple"])

model = rule["primary"] if budget == "normal" else rule["fallback"]

return self.call_model(model, prompt)Продвинутый: Автоматическое обнаружение качества

def execute_with_fallback(self, task_type, prompt):

# Сначала пробуем основную модель

result = self.route(task_type, prompt)

# Проверка качества (может быть простой проверкой длины или оценкой LLM)

if not self.quality_check(result):

# Возврат к более сильной модели

fallback = self.ROUTING_RULES[task_type]["fallback"]

result = self.call_model(fallback, prompt)

return resultАвтоматическое определение типа задачи

Идеальный маршрутизатор не требует ручного указания типа задачи — он должен определять автоматически:

import re

def detect_task_type(prompt: str) -> str:

code_patterns = [r'```', r'def ', r'function ', r'class ', r'import ']

if any(re.search(p, prompt) for p in code_patterns):

return "code"

if len(prompt) > 5000:

return "long_context"

reasoning_patterns = [r'分析', r'推理', r'比较', r'评估', r'为什么']

if any(re.search(p, prompt) for p in reasoning_patterns):

return "reasoning"

return "simple"Рекомендации по выбору

Когда использовать маршрутизацию

- ✅ Высокое использование API: Команды, тратящие более $200/месяц

- ✅ Разнообразные типы задач: Смесь кода, текстов и анализа

- ✅ Некоторая толерантность к качеству: Не каждая задача требует оптимального качества

- ✅ Инженерные возможности: Возможность поддерживать логику маршрутизации и механизмы возврата

Когда НЕ использовать маршрутизацию

- ❌ Низкое использование API: Менее $50/месяц, экономия ничтожна

- ❌ Экстремальные требования к качеству: Медицинские, финансовые сценарии не tolerируют колебания качества

- ❌ Строгие требования соответствия: Некоторые отрасли не могут позволить данным проходить через нескольких провайдеров

Оценка тенденций 2026 года

Маршрутизация нескольких моделей эволюционирует от «трюка экономии отдельных разработчиков» к «стандартной корпоративной архитектуре». По мере сужения разрыва в способностях моделей (Kimi K2.6 приближается к GPT-5.5, DeepSeek V4 приближается к передовым моделям), логика выбора модели полностью сместится от «кто самый сильный» к «кто лучше для этой задачи».

Следующие направления эволюции:

- Автоматизированная маршрутизация: Без ручных правил — пусть ИИ сам решает, какую модель использовать

- Динамическое осознание цен: Маршрутизатор считывает изменения цен API в реальном времени across моделей

- Замкнутый контур качества: Автоматическая оценка качества после каждого вызова, непрерывная оптимизация стратегии маршрутизации