Отечественные модели + фреймворки агентов: важный шаг в интеграции экосистемы

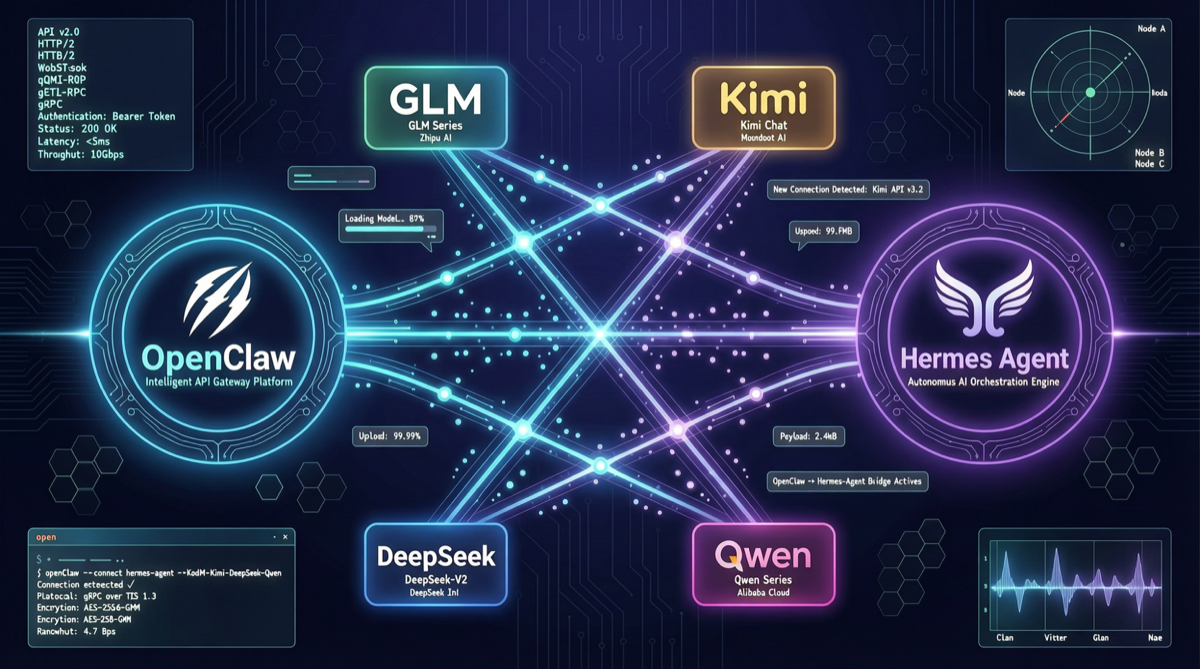

В первой половине 2026 года совместимость моделей в AI-фреймворках достигла важной вехи: OpenClaw и Hermes Agent теперь полностью поддерживают основные китайские отечественные AI-модели.

Это означает, что разработчики больше не привязаны к экосистеме одного поставщика моделей. Вы можете переключаться между GLM-5.1, Kimi K2.6, DeepSeek V4 Pro, Qwen 3.6 и другими моделями в одном фреймворке агентов, выбирая в зависимости от типа задачи и бюджета.

Поддерживаемые отечественные модели

| Модель | Поставщик | Способ интеграции | Лучшее применение |

|---|---|---|---|

| GLM-5.1 | Zhipu AI | API / встроенный OpenClaw / Hermes MCP | Кодирование, ревью кода |

| Kimi K2.6 | Moonshot | API / встроенный Hermes / OpenClaw | Длинный контекст, большие кодовые базы |

| DeepSeek V4 Pro | DeepSeek | API / встроенный OpenClaw | Экономичное кодирование, анализ отладки |

| Qwen 3.6 Max | Alibaba | API / Hermes MCP | Агентное кодирование, многофайловая работа |

| MiniMax M2.7 | MiniMax | API | Высокочастотные вызовы агентов |

| MIMO V2.5 Pro | Xiaomi | API / Ollama | Кодовый агент, edge-развёртывание |

Настройка интеграции в OpenClaw

Конфигурация моделей OpenClaw управляется через .openclaw/config.yaml с поддержкой переключения между моделями.

Интеграция GLM-5.1

models:

glm-5.1:

provider: zhipu

apiKey: "${ZHIPU_API_KEY}"

model: glm-5.1

contextWindow: 131072

maxTokens: 8192

temperature: 0.3Преимущество GLM-5.1 в OpenClaw — стабильность генерации кода. В тестах GLM-5.1 сохраняет соглашения об именовании переменных на протяжении 20+ раундов непрерывного диалога — лучший показатель среди отечественных моделей.

Интеграция Kimi K2.6

models:

kimi-k26:

provider: moonshot

apiKey: "${MOONSHOT_API_KEY}"

model: kimi-k2.6

contextWindow: 256000

maxTokens: 16384

temperature: 0.2Контекстное окно 256K у Kimi K2.6 — это ключевое преимущество. В сценариях с большими кодовыми базами, например, при рефакторинге, требующем одновременного чтения десятков файлов, Kimi значительно превосходит другие отечественные модели.

Интеграция DeepSeek V4 Pro

models:

deepseek-v4-pro:

provider: deepseek

apiKey: "${DEEPSEEK_API_KEY}"

model: deepseek-v4-pro

contextWindow: 128000

maxTokens: 8192

temperature: 0.4Ключевое конкурентное преимущество DeepSeek V4 Pro — экономичность. Стоимость за токен самая низкая среди отечественных моделей, что идеально подходит для рабочих процессов агентов, требующих большого количества API-вызовов.

Сравнение стоимости: отечественные модели в сценариях агентов

При 100 вызовах агентов в день, в среднем 8000 входных + 4000 выходных токенов за вызов:

| Модель | Вход ($/M) | Выход ($/M) | Стоимость/день | Стоимость/мес |

|---|---|---|---|---|

| GLM-5.1 Coding Plan | Подписка | Подписка | — | ¥469 |

| Kimi K2.6 | ~$0.50 | ~$1.00 | ~$0.07 | ~$2.10 |

| DeepSeek V4 Pro | $0.60 | $1.20 | $0.072 | $2.16 |

| Qwen 3.6 Plus | ~$0.30 | ~$0.60 | $0.036 | $1.08 |

| MiniMax M2.7 | $0.30 | TBD | < $0.05 | < $1.50 |

Ключевой вывод: стоимость использования отечественных моделей для агентов составляет лишь 1/10–1/20 от GPT-5.5, что обеспечивает экономически viable развёртывание агентов для индивидуальных разработчиков и небольших команд.

Практические советы

1. Маршрутизация моделей: автопереключение по типу задачи

routing:

rules:

- pattern: ".*генерация кода|написать функцию|реализовать.*"

model: glm-5.1

reason: "Лучшая стабильность генерации кода"

- pattern: ".*анализ.*файлы|рефакторинг.*проект|.*весь код.*"

model: kimi-k2.6

reason: "Преимущество длинного контекста"

- pattern: ".*отладка|поиск.*бага|.*почему ошибка.*"

model: deepseek-v4-pro

reason: "Полная цепочка рассуждений"2. Стратегия резервирования

fallback:

primary: glm-5.1

secondary: kimi-k2.6

tertiary: deepseek-v4-pro

maxRetries: 3Дерево решений для выбора модели

Какая ваша основная задача?

├── Генерация кода / реализация функций

│ ├── Нужен стабильный качественный вывод? → GLM-5.1

│ └── Ограниченный бюджет? → Qwen 3.6 Plus

├── Большая кодовая база / многофайловый рефакторинг

│ └── → Kimi K2.6 (длинный контекст)

├── Отладка / устранение неполадок

│ └── → DeepSeek V4 Pro (полные рассуждения)

├── Высокочастотные циклы агентов

│ └── → MiniMax M2.7 (наименьшая стоимость)

└── Общие задачи / ежедневная помощь

└── → Qwen 3.6 Plus (лучшее соотношение цена/качество)Итог

В первом полугодии 2026 года интеграция отечественных моделей во фреймворки агентов совершила качественный скачок. От «только API-подключения» до «интеграции в один клик без настройки», от «едва usable» до «надёжно работающего» — отечественные модели играют всё более важную роль в экосистеме агентов.

Для разработчиков это означает ключевой сдвиг: вам больше не нужно полагаться на одного поставщика моделей. Как при выборе базы данных, вы можете гибко комбинировать отечественные модели в зависимости от типа задачи, потребностей в производительности и бюджета, создавая оптимальные рабочие процессы агентов.

Источники: