Если вы всё ещё используете RAG-пайплайн «чанкинг → эмбеддинг → векторная БД → поиск по схожести», PageIndex может стать самым важным тревожным звонком 2026 года.

Болевая точка

Каждый шаг в традиционном RAG-пайплайне теряет информацию:

- Чанкинг: Разрезание связных документов на фрагменты, разрыв контекстных связей

- Эмбеддинг: Сжатие семантики в векторы фиксированной размерности, потеря деталей

- Поиск в векторной БД: Извлечение на основе косинусной схожести, но «похожий» не равно «релевантный»

- С拼接 контекста: Запихивание фрагментов в промпт, заставляя LLM самостоятельно собирать полный смысл

Подход PageIndex: Почему бы не позволить LLM просматривать весь документ структурно, как это делает человек?

Решение PageIndex

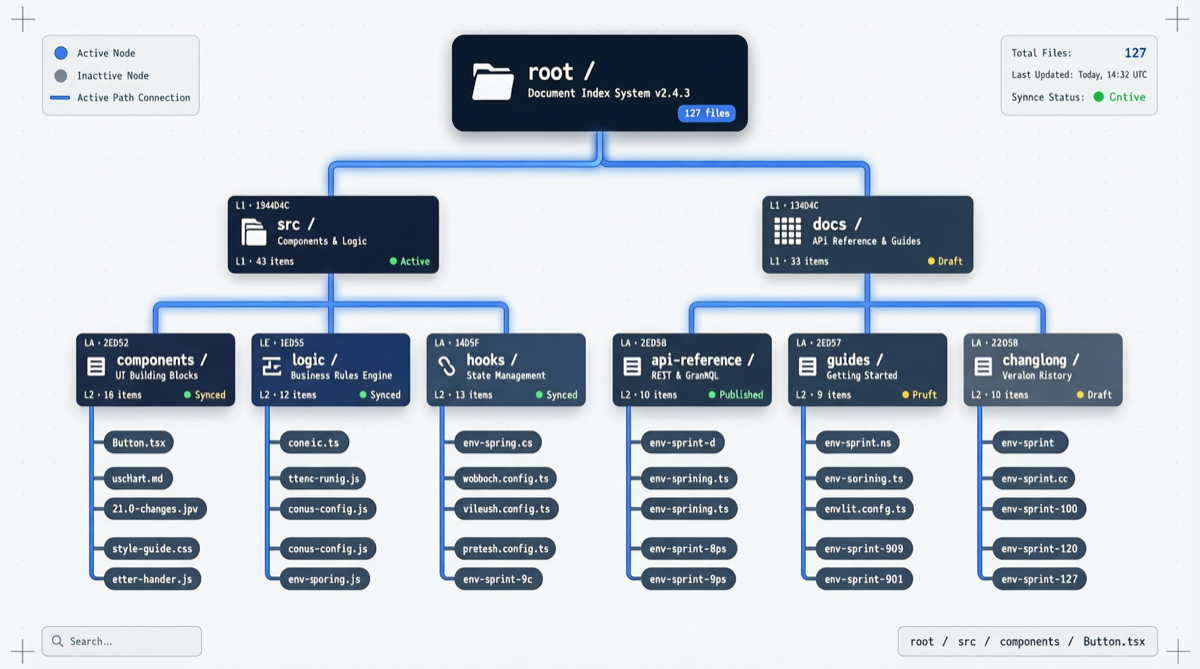

Ключевой механизм PageIndex — древовидный индекс документов:

- Построение иерархической древовидной структуры над документами (главы → разделы → подразделы)

- LLM начинает от корневого узла и переходит слой за слоем к релевантным листовым узлам

- На каждом шаге LLM самостоятельно решает, какую ветку исследовать дальше

- В итоге считываются только наиболее релевантные полные сегменты контента, а не фрагментированные чанки

Этот процесс полностью обходит эмбеддинг и векторный поиск, позволяя модели находить информацию, словно листая оглавление книги.

Сравнение данных

| Параметр | Традиционный RAG | PageIndex |

|---|---|---|

| Требуется векторная БД | Да (Pinecone/Milvus и т.д.) | Нет |

| Требуется модель эмбеддинга | Да | Нет |

| Требуется чанкинг | Да | Нет |

| Требуется поиск по схожести | Да | Нет |

| FinanceBench | ~80-85% | 98.7% |

| Обработка длинных документов | Фрагментация информации | Сохранение иерархической структуры |

| Сложность развёртывания | Много компонентов (эмбеддер + векторная БД + ретривер) | Один компонент |

Результат 98.7% на FinanceBench превосходит все подходы RAG на основе векторного извлечения. Это не маржинальное улучшение — это победа на уровне методологии.

Почему именно сейчас?

Успех PageIndex зависит от двух предварительных условий, которые по-настоящему созрели лишь в 2026 году:

- Контекстные окна LLM стали достаточно большими: Контексты 1M+ токенов позволяют моделям одновременно обрабатывать всё дерево документов

- Навигационные способности LLM стали достаточно сильными: Модели должны принимать многошаговые решения на древовидной структуре, выбирая правильную ветку на каждом шаге

Иными словами, PageIndex не «не нуждается в LLM» — он «нуждается в более мощных LLM». Когда модели становятся достаточно умными, традиционные эмбеддинги и векторный поиск оказываются ненужными промежуточными слоями.

Начало работы

# Установка

pip install pageindex

# Базовое использование

from pageindex import PageIndex

# Построение индекса документов

index = PageIndex.from_documents([

"financial_report_2026.pdf",

"annual_summary.md"

])

# Запрос (LLM автономно навигирует по дереву)

result = index.query("Каковы были основные драйверы роста выручки в Q1 2026?")Применимые сценарии и ограничения

| Подходит для | Не подходит для |

|---|---|

| Длинные документы (отчёты, руководства более 100 страниц) | Короткие текстовые коллекции (посты в соцсетях, краткие отзывы) |

| Структурированные документы (с чёткой иерархией глав) | Неструктурированные текстовые потоки |

| Финансовые/юридические сценарии с высокими требованиями к точности | Поиск в реальном времени, требующий крайне низкой задержки |

| Команды, желающие снизить зависимость от инфраструктуры | Команды с зрелыми пайплайнами векторных БД, которые хорошо работают |

Три оценки

Прирост: Подход RAG, полностью пропускающий эмбеддинг + векторную БД + чанкинг, ранее не проходил масштабную валидацию. Результат 98.7% на FinanceBench — реальное достижение.

Шум: Пока детальные данные только по FinanceBench; производительность на других бенчмарках (HotpotQA, 2WikiMultihopQA) не опубликована. Стоимость построения древовидного индекса на сверхбольших наборах документов остаётся к проверке.

Сигнал: Твит в X с 5 775 лайками и 9 809 закладками демонстрирует высокий интерес сообщества. Когда «RAG без векторной базы данных» становится центром обсуждения,vendorам векторных баз данных нужно серьёзно пересмотреть позиционирование своих продуктов.

Источники: PageIndex GitHub | Обсуждение в X/Twitter