Вывод

Команда Tongyi Qianwen от Alibaba официально открыла исходный код Qwen-Scope — инструментария для анализа и управления внутренними представлениями модели на основе разреженных автоэнкодеров (SAE). Инструмент охватывает 7 моделей семейств Qwen3 и Qwen3.5, и его ключевая ценность заключается в следующем: вы можете направленно управлять поведением вывода модели, манипулируя внутренними признаками, без тонкой настройки модели.

Это не обычная открытая игрушка — это первая систематическая инженерная реализация передовых исследований механистической интерпретируемости (от Anthropic и других институтов), адаптированная для экосистемы китайских больших языковых моделей.

Разбор основных возможностей

| Измерение возможности | Конкретная функция | Практическая ценность |

|---|---|---|

| Локализация признаков | Определение конкретных нейронов/признаков внутри модели | Понимание «почему» модель выдаёт определённый результат |

| Управление выводом | Вмешательство в активацию признаков на этапе инференса | Настройка тенденций поведения модели без обучения |

| Построение классификаторов | Обучение классификаторов признаков на малом количестве примеров | Низкозатратное обнаружение конкретных концепций или намерений |

| Синтез образцов | Генерация образцов длинного хвоста на основе активации признаков | Расширение обучающих данных для редких сценариев |

| Обнаружение аномалий | Определение признаков, вызывающих аномальные выводы | Быстрая диагностика «плохих привычек» модели |

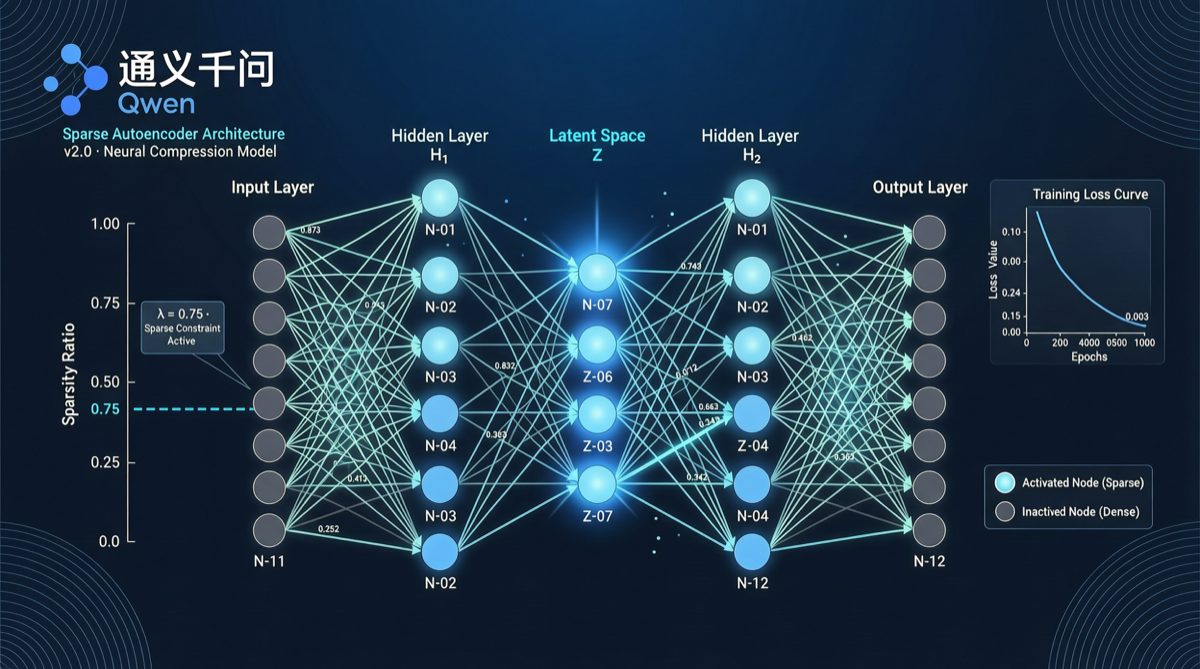

Краткое описание технического принципа

Рабочий процесс Qwen-Scope состоит из трёх шагов:

- Обучение SAE: Обучение разреженных автоэнкодеров на скрытых слоях модели (обычно выходах MLP или Attention), разложение высокоразмерных плотных активаций на множество разреженных «признаков»

- Аннотирование признаков: Автоматическая или полуавтоматическая маркировка семантических значений каждого признака (например, «признак китайского языка», «признак кода», «признак отказа по безопасности»)

- Вмешательство в признаки: Усиление или подавление конкретных признаков во время инференса для достижения точного управления выводом

Элегантность этого подхода в том, что вам не нужно переобучать модель — достаточно «покрутить несколько ручек» во время инференса.

Поддерживаемые модели

Qwen-Scope поддерживает следующие 7 моделей:

- Qwen3-0.6B / 1.7B / 4B / 8B

- Qwen3.5-4B / 8B / 14B

Охвачены все основные спецификации от малых до средних, адаптированные для различных сценариев развёртывания.

Практические сценарии применения

Сценарий 1: Устранение смешения языков

Когда модель неестественно примешивает английский к китайским ответам, можно определить «английский признак» и умеренно подавить его при инференсе — вывод станет чище на китайском.

Сценарий 2: Сокращение повторяющейся генерации

Когда модель производит повторяющийся вывод, определение и подавление признаков, соответствующих паттернам повторения, значительно улучшает качество генерации.

Сценарий 3: Усиление выравнивания безопасности

Без повторного RLHF достаточно увеличить силу активации «признаков отказа по безопасности», чтобы модель стала более чувствительной к вредоносным запросам.

Сценарий 4: Внедрение знаний конкретной предметной области

Определение ключевых признаков целевой области и усиление их активации при инференсе — по сути, это «временная подучка» модели.

Оценка ландшафта

Открытие исходного кода Qwen-Scope передаёт несколько важных сигналов:

- Инструменты интерпретируемости переходят от исследований к инженерии: SAE больше не просто концепция в статьях — это загружаемый, устанавливаемый, используемый инструментарий

- Запущена экосистема интерпретируемости китайских моделей: Ранее инструменты SAE в основном были ориентированы на англоязычные модели (Claude, GPT). Qwen-Scope заполняет этот пробел для китайских LLM

- Значительное снижение затрат на тонкую настройку: Управление признаками как альтернатива тонкой настройке может сэкономить значительные вычислительные ресурсы и время в определённых сценариях

По сравнению с исследованиями SAE от Anthropic, уникальное преимущество Qwen-Scope заключается в оптимизации для характеристик китайского языка, включая признаки токенизации китайского языка, обнаружение смешения китайского и английского — то, что инструменты для англоязычных моделей не могут покрыть.

Рекомендации к действию

- Разработчикам моделей: Используйте Qwen-Scope для диагностики конкретных проблем поведения модели — это эффективнее, чем слепая настройка параметров

- Командам приложений: При столкновении с проблемами качества вывода модели сначала попробуйте управление признаками — возможно, не потребуется повторная тонкая настройка

- Исследователям: Создавайте новые бенчмарки интерпретируемости китайских LLM на основе Qwen-Scope

Начало работы

# Клонирование репозитория

git clone https://github.com/QwenLM/Qwen-Scope.git

cd Qwen-Scope

# Установка зависимостей

pip install -r requirements.txt

# Загрузка предобученного SAE (пример для Qwen3-8B)

from qwen_scope import SAELoader

sae = SAELoader.from_pretrained("Qwen3-8B-MLP-SAE")

# Вмешательство в признаки при инференсе

controlled_output = sae.generate(

prompt="Ваш вопрос",

feature_modulations={"chinese_purity": 1.5, "english_mixed": -0.8}

)Веса SAE опубликованы на Hugging Face и ModelScope, поддерживают прямую загрузку и использование.

Источники данных

- GitHub: github.com/QwenLM/Qwen-Scope

- Официальное объявление Qwen