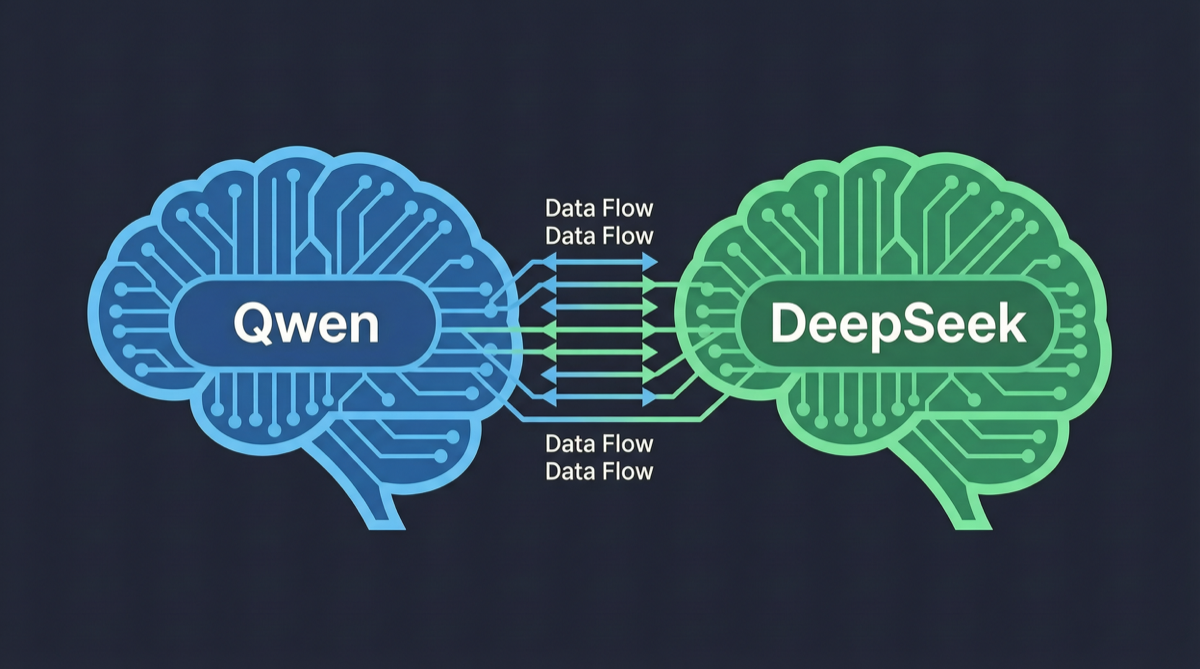

В начале мая 2026 года на Hugging Face появилась новая модель под названием QwenSeek-2B. Это не продукт крупной лаборатории, а независимый проект разработчиков сообщества — эксперимент кросс-модельной дистилляции с использованием Qwen3.5-2B в качестве студенческой модели и цепочек мыслей DeepSeek-V4 в качестве учительских сигналов.

Что произошло

| Параметр | Детали |

|---|---|

| Студенческая модель | Qwen3.5-2B (2B-параметрическая модель с открытым исходным кодом от команды Alibaba Qwen) |

| Учительский сигнал | Цепочки мыслей |

| Лицензия | Apache 2.0 (коммерческое использование разрешено) |

| Платформа | Hugging Face |

| Требования | Одна видеокарта RTX 3060 / 4060 для инференса |

Основная идея проста: научить маленькую модель тому, как рассуждает большая модель. Не просто имитировать результат, а учиться «как думать» — шаги рассуждения DeepSeek-V4, сгенерированные в тегах

Почему это важно

Во-первых, новый путь кросс-модельной дистилляции. Предыдущие работы по дистилляции в основном проводились внутри одного семейства (большая Qwen дистиллируется в маленькую Qwen). QwenSeek-2B нарушает это ограничение: использование способности рассуждения DeepSeek для усиления архитектуры Qwen доказывает, что знания цепочек мыслей могут переноситься между архитектурами.

Во-вторых, порог в 2B параметров крайне практичен. Модель на 2B требует всего 4-6 ГБ видеопамяти, что означает возможность запуска на:

- Потребительских ноутбуках с GPU (RTX 3060/4060)

- Периферийных устройствах (Jetson Orin Nano)

- Недорогих облачных серверах (VPS за $5-10/мес)

В-третьих, лицензия Apache 2.0. Нет коммерческих ограничений — предприятия могут напрямую интегрировать модель в продукты без опасений по поводу соответствия лицензии.

Оценка ландшафта

Этот эксперимент выявляет формирующуюся тенденцию: цепочки мыслей (CoT) сами становятся дистиллируемым активом знаний.

Когда модели с открытым исходным кодом, такие как DeepSeek-V4, широко используют теги

- Дистилляция паттернов рассуждения Claude в Llama

- Дистилляция мультимодального рассуждения GPT-4o в Qwen-VL

- Дистилляция цепочек мыслей от нескольких учителей в одного студента

Это может ускорить тенденцию «маленькие модели, большие возможности» — модели с 2B-7B параметрами, поглощая процессы рассуждения более крупных моделей, приближаются к более крупным конкурентам в определённых задачах.

Рекомендации

| Ваш сценарий | Рекомендация |

|---|---|

| Нужно развернуть агентов рассуждения на периферийных устройствах | Попробуйте QwenSeek-2B, низкий порог видеопамяти |

| Уже развернули Qwen3.5-2B | Сравните качество вывода до и после дистилляции |

| Проводите эксперименты по тонкой настройке моделей | Обратитесь к их процессу дистилляции, попробуйте аналогичные эксперименты со своими учительскими сигналами |

| Интеграция в коммерческий продукт | Apache 2.0 позволяет прямое использование, но сначала проверьте на некритичных путях |

Примечание: Это экспериментальный проект сообщества, а не официальный релиз. Стабильность, безопасность и долгосрочная поддержка не гарантируются. Обязательно проведите собственную оценку перед использованием в продакшене.