Заключение

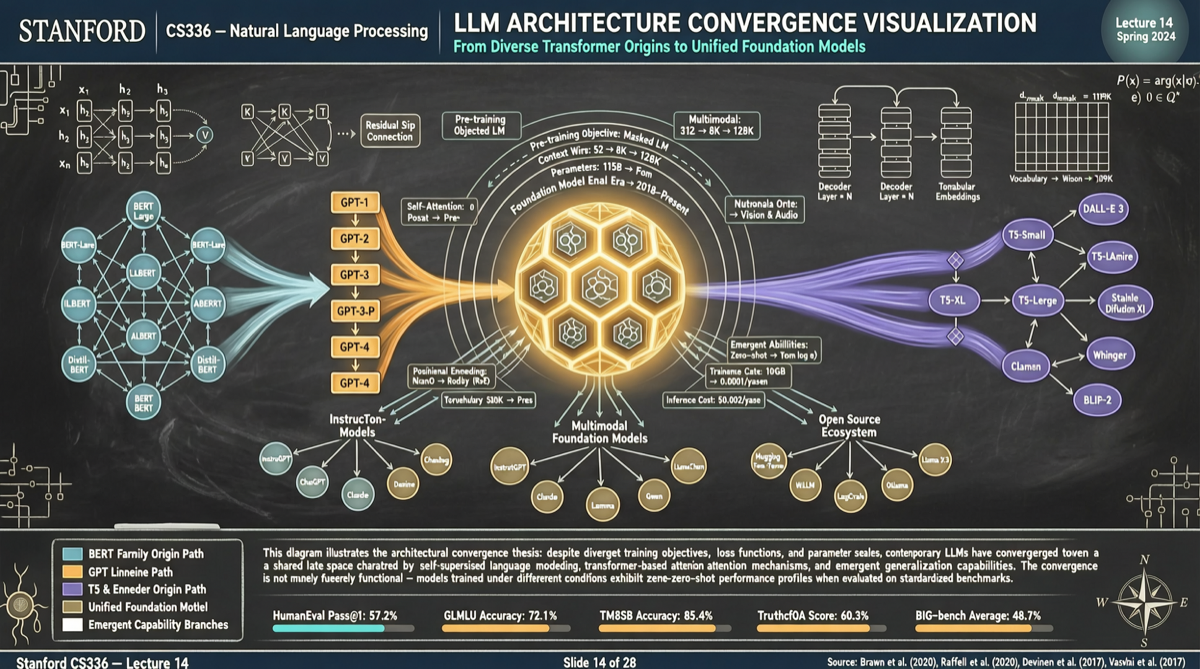

Преподаватель Стэнфордского CS336 (курс обучения LLM) Тацу недавно сделал нечто исключительно информационно плотное: он разобрал каждый основной LLM за последние 3 года и сравнил их архитектурные решения одно за другим.

Вывод оказался довольно «взрывным»: 90% архитектурных решений уже сошлись. Возьмите любую открытую большую модель наугад — будь то Qwen, Llama, DeepSeek или GLM — и они почти идентичны по этим параметрам.

Три предложения преподавателя, подытоживающие последние три года:

- 2024 год: Все косплеили Llama 2

- 2025 год: Тема — «как тренировать, чтобы не схлопнуться»

- 2026 год: ?

Где проявляется архитектурная конвергенция

Курс Тацу разобрал следующие ключевые измерения и обнаружил, что почти все основные модели выбрали одинаковые решения:

1. Варианты Transformer

Практически повсеместно архитектура Decoder-only. Encoder-decoder (семейство T5) полностью маргинализирован в пространстве общих LLM. MoE (Mixture of Experts) перешёл из разряда «опциональных» в «конфигурацию по умолчанию для больших моделей».

2. Механизм внимания

Переход отрасли от Multi-Head Attention к Grouped Query Attention (GQA) произошёл практически синхронно. Преимущества GQA в скорости вывода и потреблении VRAM позволили ему победить без конкуренции.

3. Нормализующие слои

RMSNorm заменил LayerNorm в качестве стандарта, а стабильность архитектуры Pre-Norm при глубоком обучении сделала её практически бесспорной.

4. Функции активации

SwiGLU доминирует. ReLU и GeLU практически исчезли из новых моделей.

5. Позиционное кодирование

RoPE (Rotary Position Embedding) — фактический стандарт для сценариев, требующих длинного контекста. ALiBi по-прежнему занимает своё место в специфических сценариях (таких как потоковый вывод).

Почему конвергенция произошла в 2024-2025 годах

Это не совпадение. За архитектурной конвергенцией стоит наложение трёх сил:

Стоимость вычислений: Обучение модели 70B+ стоит миллионы долларов, практически не оставляя пространства для ошибок. После того как Llama 2 валидировал набор архитектурных решений в диапазоне 7B-70B, у последователей практически не осталось мотивации всё опрокинуть и начать заново.

Прозрачность открытого кода: Открытие Llama серии сделало все архитектурные детали прозрачными. Последующим командам моделей не нужно было «переоткрывать» — можно было ссылаться напрямую.

Теоретическая поддержка: Исследование законов масштабирования (Scaling Laws) значительно созрело, дав сообществу более чёткое понимание того, «какие решения работают на масштабе».

О чём 2026 год?

Если архитектуры сошлись, куда сместилась конкуренция?

Качество данных и стабильность обучения.

Преподаватель намекнул, что ключевые конкурентные измерения 2026 года смещаются в сторону:

- Оптимизация соотношения данных: Оптимальные пропорции смешивания кода, математики, многоязычных и инструктивных данных

- Стабильность процесса обучения: Как избежать всплесков потерь (loss spike) и взрывов градиентов

- Методы пост-обучения: Эффективность и качество методов выравнивания, таких как RLHF, DPO, ORPO

Это также объясняет, почему китайские модели, такие как Qwen и DeepSeek, могут по-прежнему достигать значительных различий в производительности, несмотря на архитектурную конвергенцию — за счёт стратегии данных и мастерства обучения.

Что это значит для практиков

Если вы занимаетесь чем-либо из следующего, эта информация важна:

- Выбор модели: Не дайте себя обмануть маркетинговыми разговорами об «уникальной архитектуре». Реальные различия кроются в данных и пост-обучении

- Локальное развёртывание: Поскольку архитектуры сходятся, опыт оптимизации одной модели (например, схемы квантизации, фреймворки вывода) можно перенести на другие

- Точки входа для исследований: Если пространство архитектурных инноваций сужается, следующий прорыв скорее всего придёт со стороны данных или методологии обучения

Позиция китайских моделей в этом ландшафте конвергенции

Стоит отметить одну деталь: китайские модели (Qwen, DeepSeek, GLM) не только не отстали от тренда архитектурной конвергенции, но и создали дифференциацию по некоторым измерениям:

- Постоянные инвестиции Qwen в многоязычные способности и длинный контекст

- Агрессивная стратегия DeepSeek в архитектуре MoE и оптимизации стоимости вывода

- Преимущества GLM в понимании китайского языка и локализованных знаниях

Архитектурная конвергенция не означает конвергенцию способностей — данные и мастерство обучения являются истинным водоразделом.

Одним словом

Конвергенция архитектуры LLM — это не конец инноваций, а смена конкурентных измерений. Война моделей 2026 года — это борьба за данные, мастерство обучения и качество выравнивания — и это именно те области, в которых китайские модели активно инвестируют.