结论先行

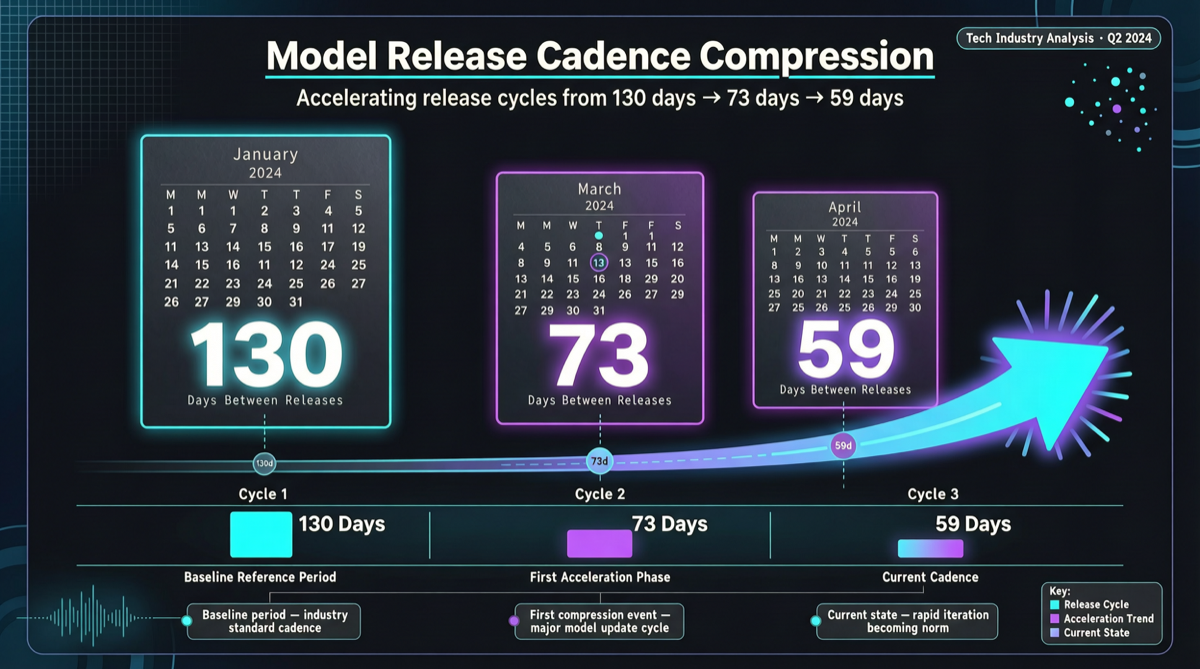

Claude 的发布间隔正在以惊人的速度压缩:

| 版本迭代 | 间隔天数 |

|---|---|

| Sonnet 4 → 4.5 | 130 天 |

| Opus 4.5 → 4.6 | 73 天 |

| Opus 4.6 → 4.7 | 59 天 |

4 个月内发布间隔缩短了 55%。这不是线性的改进,而是指数级的加速。

数据分析

发布节奏变化

2025 Q4 ← Sonnet 4

│ 130天

2026 Q1 ← Sonnet 4.5 / Opus 4.5

│ 73天

2026 Q2 ← Opus 4.6

│ 59天

2026 Q2 ← Opus 4.7(当前)从 130 天到 59 天,发布周期缩短了超过一半。如果按照这个趋势线性外推,下一版本的间隔可能只有 40 天左右。

横向对比:其他模型的发布节奏

| 模型系列 | 当前发布间隔 | 趋势 |

|---|---|---|

| Claude (Anthropic) | ~59 天 | 加速中 ⬇️ |

| GPT (OpenAI) | ~90 天 | 相对稳定 |

| Gemini (Google) | ~60 天 | 加速中 ⬇️ |

| Qwen (阿里) | ~45 天 | 快速迭代 |

| DeepSeek | ~60 天 | 稳定 |

Claude 的加速并非孤立现象,但 59 天的节奏已经接近行业最快的水平。

对工程实践的影响

1. 模型版本锁定策略需要重构

如果你的生产环境固定了 Claude 模型版本:

| 过去 | 现在 |

|---|---|

| 年度规划模型升级 | ❌ 不够用 |

| 半年一次评估 | ⚠️ 可能错过重要更新 |

| 季度评估 + 按需升级 | ✅ 推荐方案 |

2. 回归测试频率必须提升

每次模型迭代都可能带来:

- 能力提升(新功能、更准确)

- 行为变化(输出格式、推理模式)

- 潜在回归(某些场景能力下降)

建议:建立自动化回归测试套件,每次模型更新后自动跑一遍。

3. 多模型路由策略的必要性上升

当单个模型的迭代速度过快时,多模型路由成为降低风险的关键:

请求进入

├── 稳定任务 → 固定版本模型(已验证)

├── 新功能探索 → 最新版本模型

└── 关键路径 → 双模型交叉验证竞争格局解读

Anthropic 为什么加速?

- 竞争压力:OpenAI GPT-5.5、Google Gemini 3.2 Flash、Qwen3.6 密集发布

- 技术成熟:训练基础设施和评估流程已经标准化,迭代成本降低

- 市场需求:企业对 AI 能力的期望在持续上升

对其他玩家的影响

- OpenAI:GPT 系列需要维持至少同频的迭代速度

- Google:Gemini 的加速趋势与 Claude 同步

- 国产模型:Qwen 已经保持 ~45 天的迭代节奏,处于领先位置

行动建议

对于使用 Claude API 的团队:

- 将模型版本评估纳入每季度的工程例会

- 建立新版本的自动化测试流程

- 考虑多模型路由架构,降低单一模型升级风险

对于选择技术栈的创业者:

- 不要假设某个模型版本会稳定可用超过 3 个月

- 抽象化 LLM 调用层,让切换模型成本降到最低

- 评估开源模型作为”稳定锚”的价值——迭代节奏由自己控制