核心结论

NVIDIA 官方披露了 DeepSeek V4 在 Blackwell 平台上的推理性能数据,核心信息量很大:

- DeepSeek V4(1.6T 参数 MoE)在 Blackwell 上实现了 20 倍的每 token 成本降低

- 原生支持 100 万 token 上下文窗口,上线第一天即可运行

- NVIDIA 强调这是唯一一个与 MoE 模型协同设计的硬件平台

这不仅仅是一个「跑得更快」的声明——它揭示了一个更深层的趋势:Agentic AI 正在从根本上改变推理芯片的设计逻辑。

为什么是 20 倍?

要理解这个数字的分量,需要先了解 DeepSeek V4 的架构特点和 Blackwell 的针对性优化:

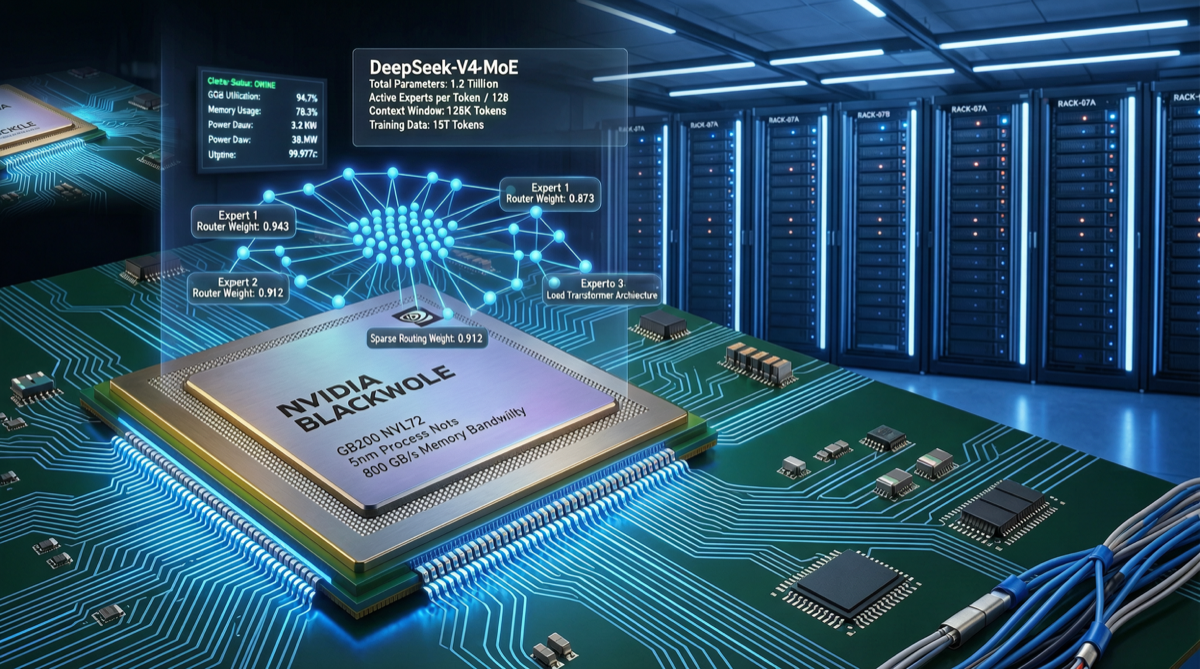

DeepSeek V4 的 MoE 架构

DeepSeek V4 采用混合专家(MoE)架构:

- 总参数:1.6 万亿

- 激活参数:约 370 亿(每次推理仅激活一小部分专家)

- 上下文:100 万 token

MoE 的特点是计算稀疏但显存密集——不是所有参数都在每次推理中被使用,但所有参数都需要驻留在显存中。

Blackwell 的针对性优化

NVIDIA Blackwell 针对 MoE 做了几个关键设计:

- NVLink 5 互联带宽提升——MoE 需要在多个 GPU 之间快速路由到不同专家,互联带宽是瓶颈

- 第二代 Transformer Engine——支持更细粒度的 FP4/FP6 混合精度,降低激活显存

- Decompression Engine——压缩权重在传输中解压,减少内存带宽压力

当 MoE 的稀疏计算遇上 Blackwell 的针对性优化,20 倍的成本降低就变得可解释了。

Agentic AI 对推理的新要求

NVIDIA 在这份声明中特别强调了「Agentic AI」这个关键词。为什么?

传统的推理场景是「一问一答」:用户输入 → 模型输出 → 结束。

Agentic AI 的场景完全不同:

- 多轮自主交互:Agent 可以连续调用模型数十甚至数百次

- 长上下文累积:每次交互的历史都要保留在上下文中

- 工具调用:模型需要反复调用外部工具和 API

在这种场景下,每 token 成本直接决定了 Agent 的经济可行性。如果 Agent 一次任务需要消耗 50 万 token,那么 $3.48/M tokens 的定价意味着每次任务约 $1.74——这在大规模部署时是可以接受的。但如果是传统定价的 20 倍,每次任务 $34.8,商业模型就不成立了。

行业影响

| 维度 | 影响 |

|---|---|

| 模型部署成本 | 1.6T MoE 的部署门槛大幅降低,中小企业也可以考虑前沿模型 |

| Agent 经济模型 | 20 倍成本降低使复杂多步 Agent 的规模化部署成为可能 |

| 芯片竞争 | NVIDIA 通过协同设计建立了 MoE 推理的硬件护城河 |

| 国产模型出海 | DeepSeek V4 的国际竞争力因 Blackwell 优化进一步增强 |

一个值得注意的细节

NVIDIA 声称这是「唯一一个与 MoE 模型协同设计的平台」(the only platform co-designed)。

这意味着什么?AMD 的 MI400 系列和 Google 的 TPU v6 在 MoE 推理上可能暂时落后。 MoE 正在成为主流架构(DeepSeek V4、Mixtral、Qwen-MoE 都在走这条路),如果 NVIDIA 在硬件层面建立了 MoE 优化的先发优势,这个差距可能持续数个产品周期。

结论

DeepSeek V4 + Blackwell 的组合说明了 2026 年 AI 基础设施竞争的一个核心逻辑:

不是模型越大越好,而是「模型架构 + 硬件平台」的协同程度决定了最终的生产力。

对于使用 DeepSeek V4 的开发者来说,选择 Blackwell 平台意味着每 token 成本降低了 20 倍——这在 Agent 场景下,可能直接决定一个项目是做还是不做。