中国 AI 监管的靴子落地了。

4 月 30 日,中央网信办印发通知,在全国范围内部署开展为期四个月的"清朗·整治 AI 应用乱象"专项行动。不是一般性的行业倡议,而是分阶段、有重点的执法行动。

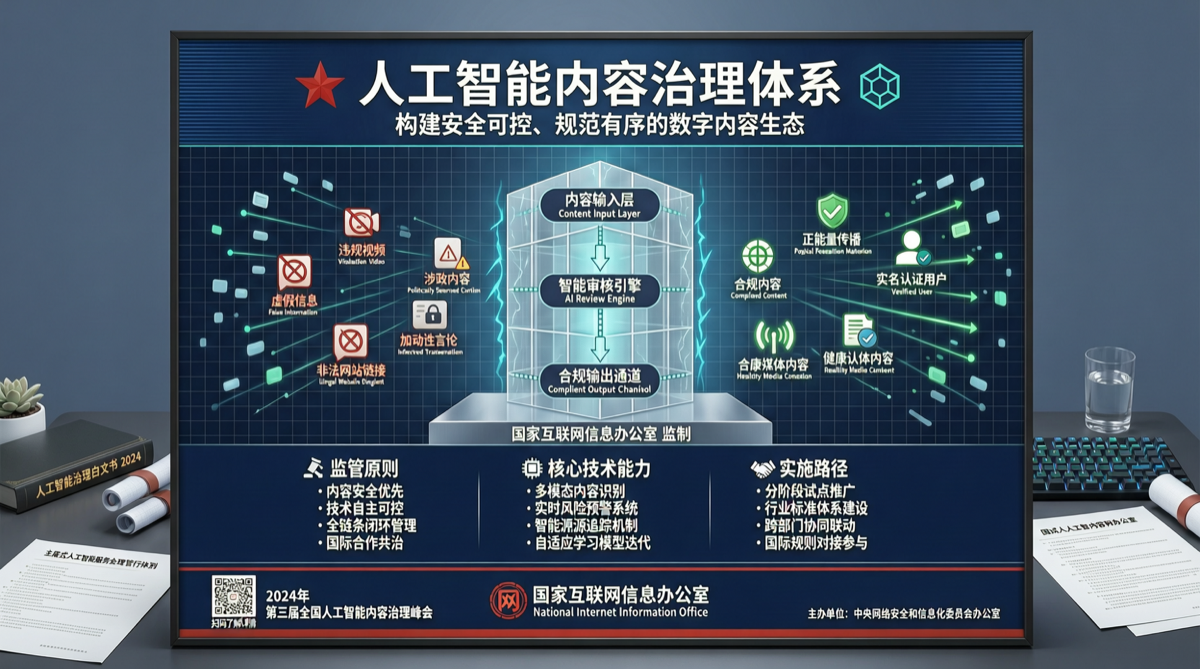

第一阶段针对 AI 技术源头:未按规定履行大模型备案登记、安全审核能力不足、训练语料安全问题、数据投毒、生成合成内容标识落实不到位。

第二阶段聚焦 AI 信息内容乱象:利用 AI 生成"数字泔水"、制作发布虚假信息、散播暴力低俗内容、假冒仿冒他人、侵害未成年人权益。

这不是第一次,但这次不一样

去年广电总局已经开展过"AI 魔改"视频专项治理,针对的是滥用 AI 工具篡改经典影视、动画的行为。小红书也在 2 月宣布对未主动标识的 AI 生成合成内容限制分发。

但这次的规格和覆盖面都更高。两个阶段分别打向技术层和内容层,而且明确提到了"训练语料安全"和"数据投毒"——这两个词直接指向模型训练阶段的数据治理,是之前监管文件中较少具体触及的领域。

翻译一下:不只是管你生成什么,还要管你用什么数据训练的。

对国内 AI 公司意味着什么

备案登记义务已经在执行中,但"安全审核能力不足"这一条给了监管更大的自由裁量空间。什么叫"不足"?没有明确的量化标准,意味着每家大模型服务商都可能被要求证明自己做到了什么程度。

对创业公司来说,合规成本正在快速上升。训练语料的安全审查、合成内容的标识系统、防止数据投毒的技术措施——这些都不是小团队随手能搞定的。

对头部公司反而是利好。百度、阿里、字节、月之暗面这些已经建立了合规体系的厂商,合规本身就成了竞争壁垒。小玩家要么投入资源跟进,要么被挡在门外。

国际视角

中国 AI 监管的节奏和力度在全球范围内都属于第一梯队。欧盟的 AI Act 侧重于风险分级和事前合规,美国目前更多依赖行业自律和州级立法。中国的做法更接近"专项行动"模式——集中执法、明确时间表、覆盖全链条。

这种模式的优势是执行效率高,问题是可能过度压缩创新空间。特别是"数字泔水"这种定义模糊的表述,在实践中可能产生寒蝉效应。

判断

AI 生成内容的监管从"讨论该不该管"进入"怎么管、谁来管、管到什么程度"阶段,这是全球性趋势。中国的节奏最快,执法力度也最大。

对开发者的直接影响:如果你的产品涉及 AI 生成内容,现在就需要把内容标识、语料合规、安全审核这三件事提到最高优先级。不要等到被抽查。

下一步观察点:专项行动结束后的执法案例公示,以及是否有针对特定公司或模型的处罚落地。这会给整个行业划出实际的合规底线。

主要来源:

- 中央网信办"清朗·整治 AI 应用乱象"专项行动通知(2026-04-30)

- 华尔街见闻相关报道

- 小红书 AI 生成内容标识政策(2026-02)