终端里跑编程助手,听上去像是 2024 年的事。但这个月它又火了一次,而且火得更猛。

DeepSeek-TUI,一个让 DeepSeek 模型在终端里直接运行编程任务的工具,本周 GitHub star 涨了 22,034 个,总星数到了 24,836。Trending 总榜第一,Python 分类也是第一。

它到底做了什么

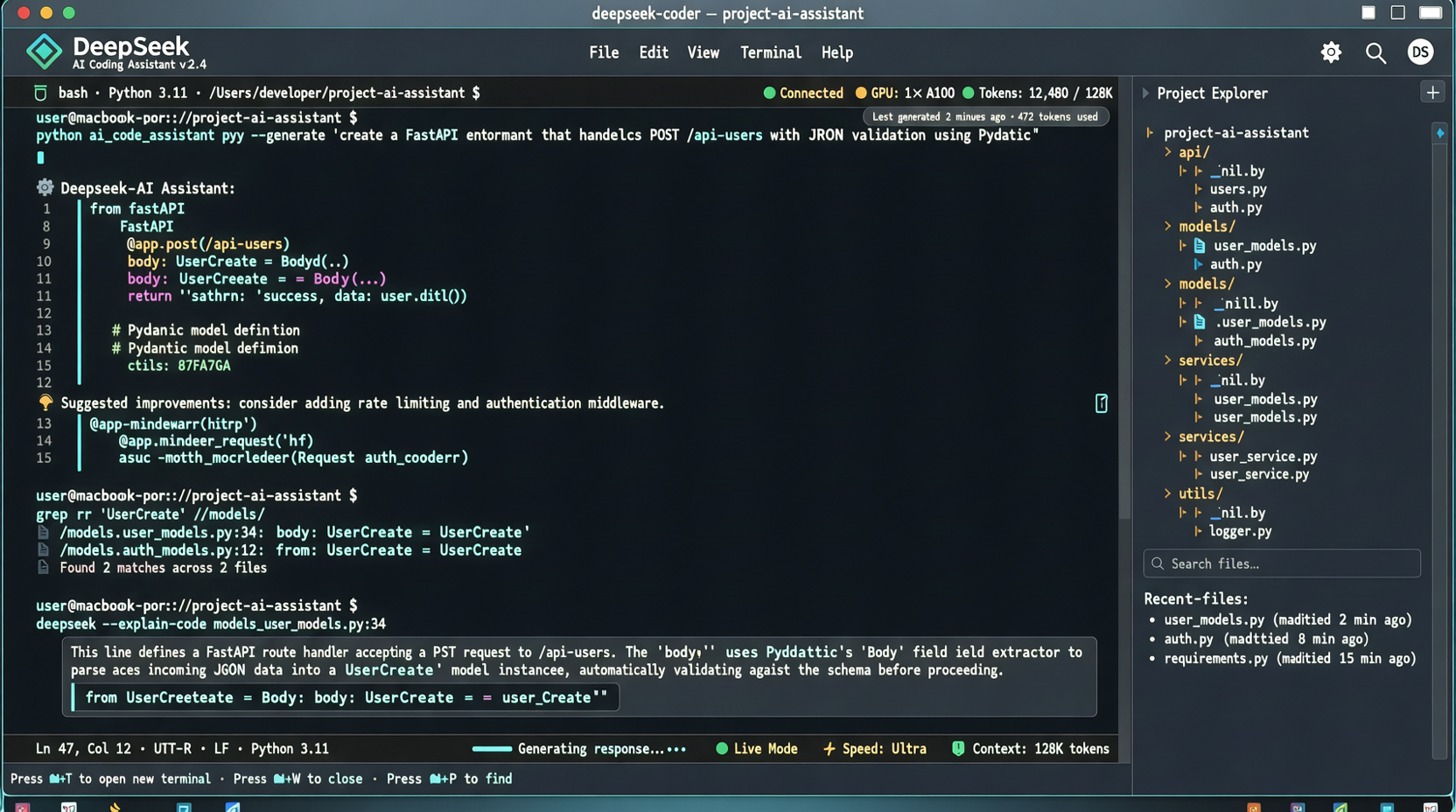

不是什么新概念。本质上是一个 terminal UI,把 DeepSeek 的 coding 能力封装成一个可以在命令行里直接交互的 agent。你打开终端,输入任务描述,它就开始写代码、改文件、跑测试——全程不用切到 IDE 或者浏览器。

看起来平平无奇,直到你仔细想想它解决了什么问题。

为什么是现在

有三个原因叠加在一起:

第一,DeepSeek 的模型能力确实到了能用的地步。 不管你对 DeepSeek 有什么看法,它的 coding benchmark 分数摆在那里。加上 API 价格便宜,个人开发者用起来没心理负担。

第二,终端工作流正在回潮。 Cursor、Claude Code、Copilot 这些 IDE 插件确实好用,但它们把你锁在了编辑器里。对于习惯 tmux + neovim + 命令行工具链的人来说,任何需要切出终端的东西都是体验降级。DeepSeek-TUI 直接长在终端里,对这批人来说是原生体验。

第三,开源生态的长尾效应。 这个项目不是一夜冒出来的。它已经迭代了几个月,最近几个 release 把 MCP 支持、多文件编辑、测试集成都做进去了。Trending 的爆发是积累到临界点的结果,不是营销事件的产物。

值得你花半小时装来试试吗

如果你符合以下条件,值得:

- 大量时间在终端里工作

- 用 DeepSeek 的 API(或者打算用)

- 不喜欢 IDE 的臃肿

如果你主要用 VS Code 或者 Cursor,那 DeepSeek-TUI 对你的吸引力有限。它解决的是终端用户的痛点,不是所有人的。

几个观察

翻了一下 issue 区,有几个值得注意的点:

- 有人反映在 M4 上运行流畅,但在旧 Intel Mac 上有延迟。这不是 DeepSeek-TUI 的问题,是本地推理的普遍问题。

- 有用户在问是否支持其他模型——作者回复了 roadmap,计划支持 Ollama 接入。

- 文档写得不算差,但"快速开始"部分对非 Linux 用户不够友好。

这个项目不会替代 Cursor 或者 Claude Code。但它证明了一件事:编程工具的市场不是"谁取代谁",而是"谁在哪个场景下更好用"。 终端场景需要一个好的 agent 工具,DeepSeek-TUI 填了这个空缺。

主要来源:GitHub Trending (2026年5月第2周), DeepSeek-TUI 仓库