发生了什么

DeepSeek 在 2026 年 4 月底密集发布了两项视觉能力更新,标志着国产模型在多模态推理路径上走出了一条差异化路线。

第一项:DeepSeek Vision Beta 上线。4 月 30 日,DeepSeek 在官方聊天界面中推出原生图像理解模式。用户无需切换工具或调用第三方 API,直接在对话框中发送图片即可获得分析结果。

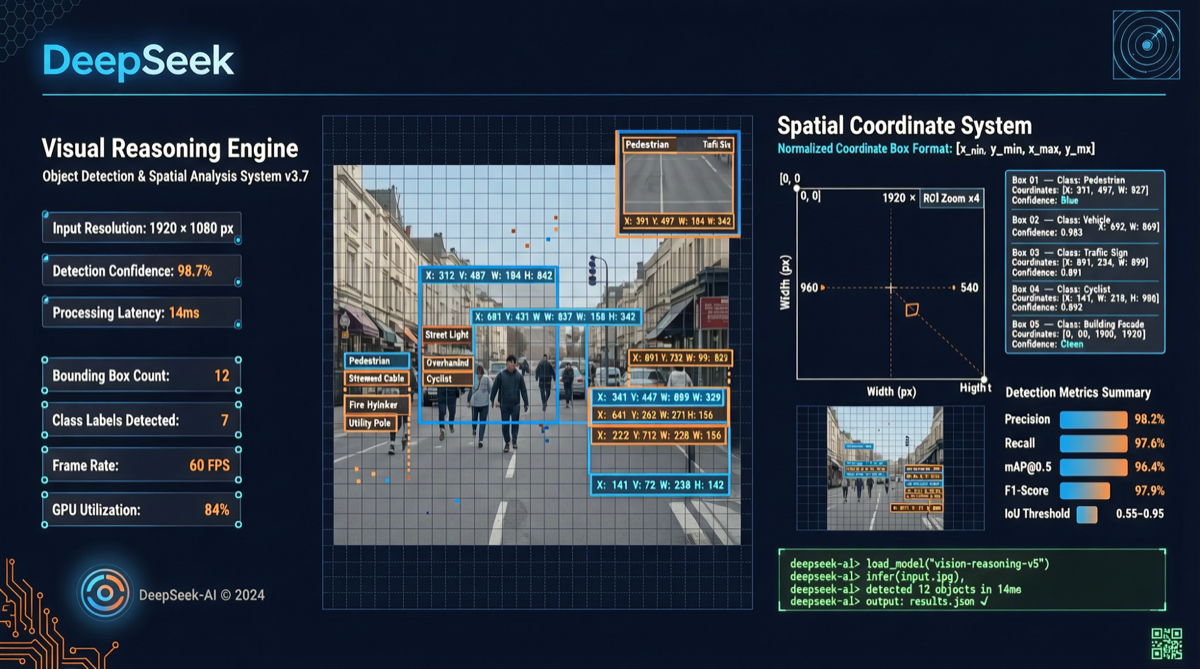

第二项:《Thinking with Visual Primitives》技术报告。DeepSeek-V4-Flash 团队发表了一篇引人注目的论文,提出了一种全新的多模态推理范式——模型不再将图像”翻译”成文字描述后再推理,而是直接在视觉空间中操作。

技术突破:双轨思维机制

传统多模态模型的工作流是:图像 → 编码为 token → 用语言链式推理(CoT)→ 输出文字答案。DeepSeek 认为这条路径存在根本性缺陷——当模型需要用语言”描述”空间关系时,信息损耗已经发生。

DeepSeek-V4-Flash 的核心创新是双轨思维:

| 维度 | 传统 CoT | DeepSeek 视觉原语 |

|---|---|---|

| 推理介质 | 纯语言 token | 语言 + 空间坐标 |

| 视觉锚点 | 文字描述位置 | 直接输出定位框/点标记 |

| 空间关系 | ”物体 A 在物体 B 左侧” | 精确 bounding box 坐标 |

| 推理过程 | 线性链式 | 并行交织 |

报告中展示的示例显示,模型在分析复杂图表时会同时输出文字推理和精确的视觉标注——不是先想再说,而是”边指边想”。

格局判断

这一路线与当前主流多模态模型形成鲜明对比:

- GPT-4o / Claude:以语言为中心的视觉理解,图像被编码后融入文本推理链

- Gemini:原生多模态但推理仍以 token 序列为主

- DeepSeek-V4-Flash:首次将空间操作(指向、框选)作为一等公民纳入推理过程

对于实际应用来说,这意味着在需要精确定位和空间推理的场景(医学影像分析、工业质检、UI 自动化测试)中,DeepSeek 的新范式可能带来显著精度提升。

可以怎么用

| 场景 | 传统方案 | DeepSeek 视觉原语 |

|---|---|---|

| 文档信息提取 | OCR → 文本解析 → 定位 | 直接框选关键字段 |

| 工业缺陷检测 | 标注框训练分类器 | 模型直接输出缺陷坐标 |

| 图表分析 | 文字描述数据趋势 | 指向具体数据点并解释 |

| 代码 UI 调试 | 截图 + 文字描述 bug | 直接标注出问题的 UI 区域 |

行动建议:如果你在做视觉相关的 AI 应用,值得关注 DeepSeek-V4-Flash 的视觉原语能力是否已在 API 中可用。对于需要精确定位的场景,这可能是一个性价比显著高于纯语言推理方案的选择。同时,DeepSeek Vision Beta 已可在官方聊天界面免费体验。