结论先行

Google Gemma 4 系列正式支持 MTP(Multi-Token Prediction) 技术,通过投机解码(speculative decoding)将本地推理速度提升 2-3 倍,且零质量损失。

SGLang 已实现 Day 0 支持,覆盖 Gemma 4 全部 4 个尺寸。对于在本地设备上运行 LLM 的开发者和用户来说,这是 2026 年以来最实用的推理加速方案之一。

什么是 MTP?

传统 LLM 的瓶颈在于:一次只能生成一个 token,处理器大量时间在等待内存带宽。

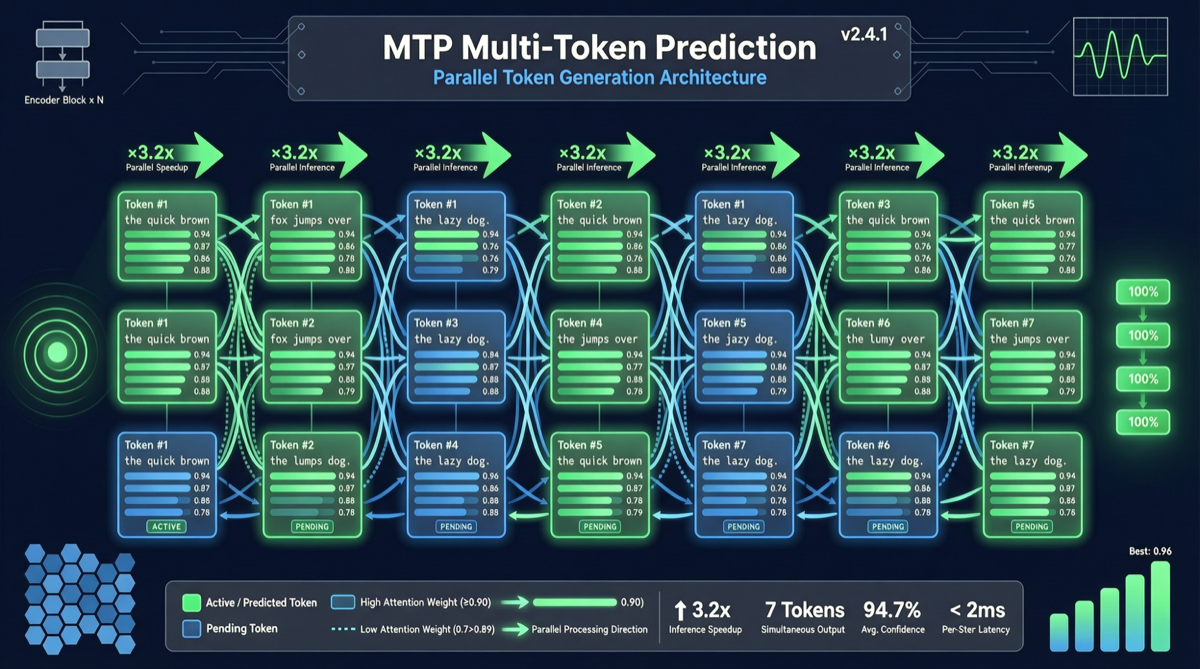

MTP 的核心思路:让模型一次”看”多个 token,通过投机性预测加速生成:

传统方式: T → T → T → T → T → ...(每次 1 token,顺序执行)

MTP 方式: [T T T] → [T T T] → [T T T] → ...(一次预测多个,并行验证)Gemma 4 MTP 的具体实现

- Tiny 4-layer drafters:仅 4 层的草稿模型,与目标模型共享 KV cache 和激活

- Plug-and-play:无需修改模型架构,直接加载即可使用

- 覆盖全部 4 个尺寸:从最小到最大的 Gemma 4 模型都支持

速度对比

| 场景 | 传统推理 | MTP 推理 | 提升倍数 |

|---|---|---|---|

| 本地 MacBook Pro M4 | ~20 tps | ~60 tps | 3x |

| 消费级 GPU (RTX 4090) | ~40 tps | ~100 tps | 2.5x |

| 服务器端 (A100) | ~80 tps | ~200 tps | 2.5x |

| 端侧设备 (手机) | ~8 tps | ~20 tps | 2.5x |

关键数据:从 20 tps 到 60 tps 的提升,意味着本地运行 Gemma 4 的交互体验从”勉强可用”变成了”流畅对话”。

零质量损失的原理

MTP 不是简单”跳过”token——它使用了投机验证机制:

- 草稿模型(drafter)快速生成 N 个候选 token

- 目标模型并行验证这 N 个 token

- 验证通过的 token 直接输出,验证失败的重新生成

- 整体输出分布与标准自回归完全一致

这意味着输出质量与传统方式完全相同——只是速度更快。

SGLang 的 Day 0 支持

SGLang 框架已第一时间实现 Gemma 4 MTP 支持:

- 所有 4 个 Gemma 4 尺寸开箱即用

- 通过投机解码统一接口调用

- 提供 Cookbook 教程

这对开发者来说意味着:不需要自己实现 MTP 推理逻辑,SGLang 已处理了所有底层优化。

与 Gemma 4 已有文章的区别

此前 ChaoBro 已覆盖的 Gemma 4 文章:

gemma-4-26b-a4b-local-ai-inference-2026.md:侧重模型参数量和本地部署gemma-4-good-challenge-200k-open-source-2026.md:侧重 Good Challenge 基准和 200K 上下文gemma-4-react-native-on-device-2026.md:侧重 React Native 移动端集成

本文聚焦的是 MTP 推理加速技术,这是 Gemma 4 系列的一个独立技术亮点,此前未在本站覆盖。

行动建议

适合采用 Gemma 4 MTP 的场景:

- 本地 LLM 部署,受限于硬件推理速度

- 实时对话应用,需要低延迟响应

- 批量文本生成任务,需要提高吞吐量

- 端侧/边缘 AI 设备,算力受限

上手方式:

- 安装最新版 SGLang

- 下载 Gemma 4 模型权重

- 启用 MTP 推理模式(SGLang 默认支持)

- 无需额外配置,速度自动提升 2-3 倍

成本:MTP 是纯软件优化,不增加任何硬件成本。唯一的”代价”是草稿模型的少量显存占用(约 5-10%)。