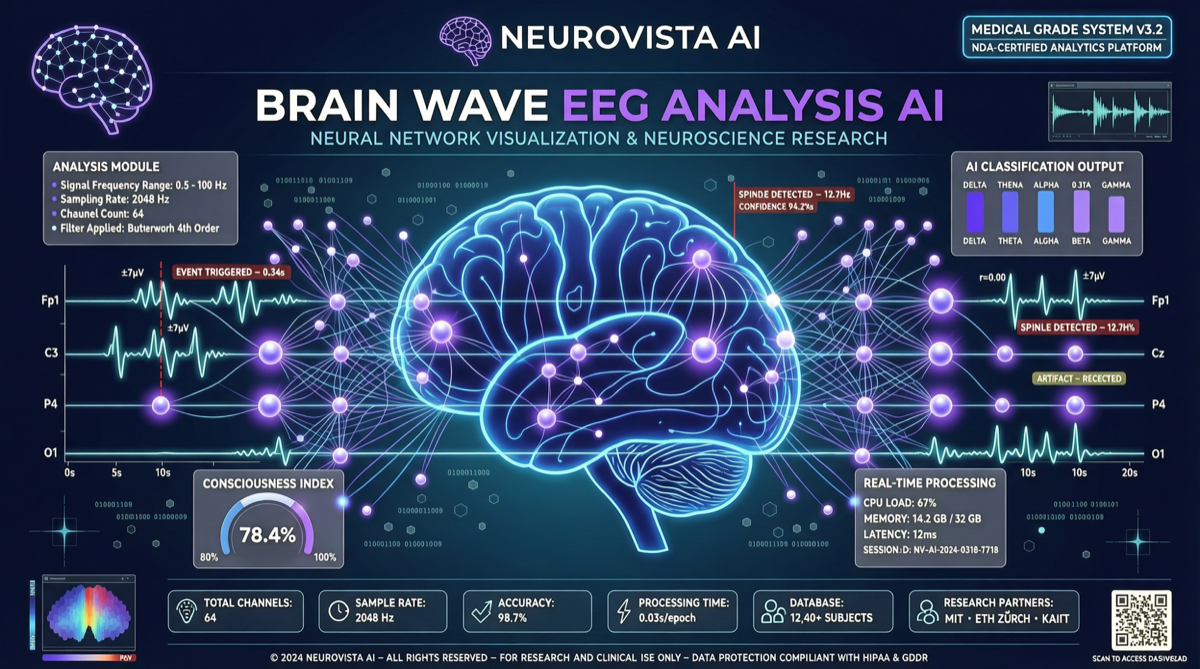

脑电(EEG)AI 这个赛道一直有个问题:各家模型用自己的数据集、自己的 pipeline、自己的指标,你没法说谁的模型更好。

Meta 刚刚发布的 NeuralBench 就是来解决这个问题的。

它解决了什么

NeuroAI 领域的评估一直很混乱:

- 不一致的 pipeline:每个团队的数据预处理方式不同

- 狭窄的任务集:只测一两个任务就说模型"很强"

- 不兼容的指标:不同论文用不同的评分标准

结果就是跨模型比较几乎不可能。你发一篇论文说你的 EEG 模型达到了 85% 准确率,我发一篇说我的达到了 90%——但我们用的数据集、预处理、评估指标全都不一样。

NeuralBench 提供了一个统一的评估框架:标准化的数据集、标准化的 pipeline、标准化的指标。终于可以在同一个起跑线上比了。

为什么值得关注

EEG 基础模型这个方向其实挺有意思的。不是聊天机器人、不是代码生成,而是让 AI 理解人脑信号。应用场景包括:

- 脑机接口(BCI)

- 认知状态监测

- 神经系统疾病的辅助诊断

- 专注度和疲劳度检测

这个方向的研究进展一直受限于缺乏统一的评测标准。NeuralBench 可能会加速这个领域的竞争和迭代。

谁该关注

- 做 BCI 研究的团队

- 对 EEG 信号处理感兴趣的开发者

- 想用 AI 分析脑电数据的研究者

说实话,这个方向离大规模商业化还有距离。但统一评测标准是第一步——没有标准化的 benchmark,这个领域永远在各自为战。

主要来源:Meta AI Research、GitHub 仓库