AI Agent 的效率之战

4 月 29 日,英伟达发布了新一代开源全模态模型 Nemotron 3 Nano Omni。与以往追求参数规模的竞赛不同,这次的焦点很明确:效率。

在 AI 大模型走向应用落地的时代,模型不再是实验室里的评测数字,而是要在真实场景中 24 小时运行的 Agent。这时候,效率就是生命线。

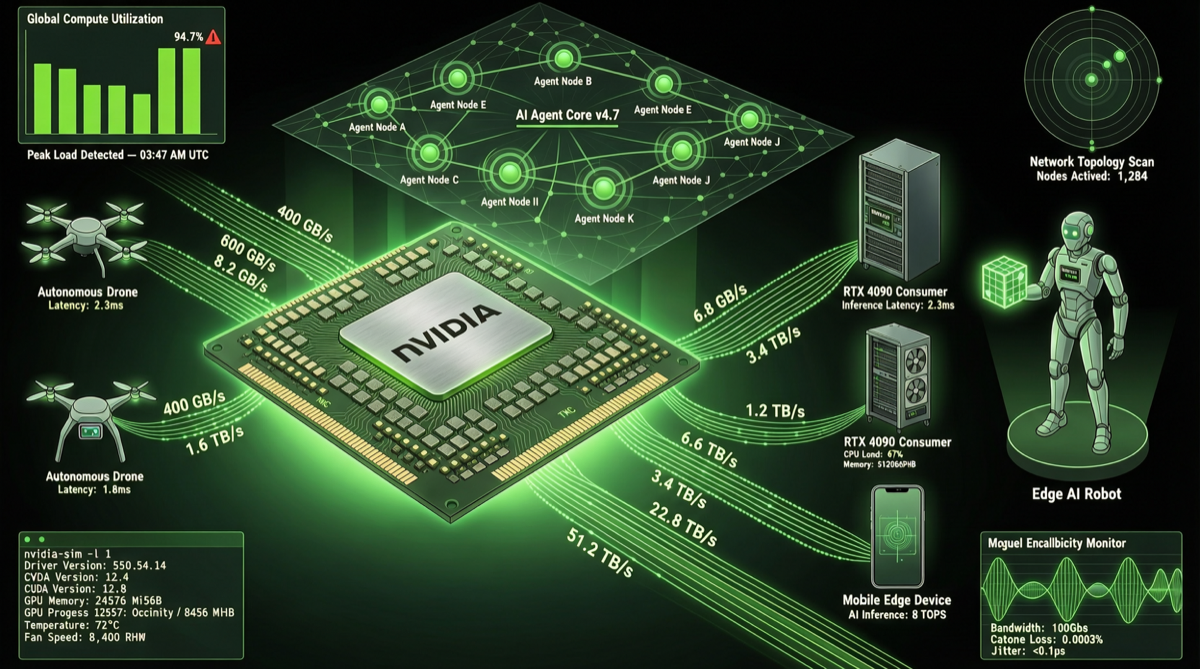

硬件兼容:从数据中心到消费级显卡

Nemotron 3 Nano Omni 的硬件兼容策略值得注意:

- 深度优化 Hopper 和 Blackwell 架构的 FP8 推理,充分发挥英伟达最新 GPU 的性能

- 兼容 RTX 5090 等消费级显卡,意味着个人开发者和小型团队也能跑全模态 Agent

- 支持 Jetson Thor 机器人平台,打开了边缘 Agent 的应用场景

这是英伟达作为「AI 卖铲人」的典型打法:模型开源是手段,生态锁定是目的。当开发者习惯在英伟达硬件上优化和部署模型,整个生态的粘性就建立了。

效率提升 9 倍

官方数据显示,相比上一代 Nemotron 模型,Nano Omni 版本在 Agent 场景下的效率提升了约 9 倍。这个数字意味着什么?

假设一个 AI Agent 需要处理一个包含文本、图像和代码的复杂任务:

- 以前可能需要 30 秒,消耗大量 GPU 资源

- 现在只需约 3-4 秒,资源消耗大幅下降

对于需要大规模部署 Agent 的企业来说,这种效率提升直接转化为成本节约。

三个规模:Nano、Super、Ultra

Nemotron 3 系列包含三个规模,设计目标直指 AI 应用中的高效和节能:

| 版本 | 定位 | 典型场景 |

|---|---|---|

| Nano | 轻量/边缘 | 消费级显卡、机器人、端侧 Agent |

| Super | 中型/生产 | 企业级推理服务、多 Agent 编排 |

| Ultra | 旗舰/极限 | 复杂推理、大规模多模态任务 |

这种分级策略让不同规模的团队都能找到合适的模型,降低了 Agent 开发的技术门槛。

为什么是「全模态」?

「全模态」(Omni)意味着模型可以同时理解和处理文本、图像、音频、视频等多种模态。对 Agent 而言,这是关键能力:

- 一个客服 Agent 需要同时理解用户文字和上传的截图

- 一个编程 Agent 需要阅读代码文件、错误截图和文档

- 一个数据分析 Agent 需要处理表格、图表和自然语言查询

多模态不再是一个「加分项」,而是 Agent 的「基础设施」。

巨头激战 Agent 赛道

英伟达此次发布的时间点值得玩味。同一时期:

- OpenAI 在加速 Agent 工具的集成和部署

- 谷歌云 AI 开源了 Agent Skills 工具箱

- 中国厂商(DeepSeek、Kimi、GLM)在 Agent 能力上持续迭代

- 小米 开源了 MiMo-V2.5-Pro,主打 Code Agent

大模型竞争的上半场是「能力上限」的较量,进入 2026 年之后,竞争的焦点正在转向「效率」和「可用性」。谁能以更低的成本、更高的效率部署 Agent,谁就能在应用层占据优势。

对开发者的实际意义

Nemotron 3 Nano Omni 的开源对开发者有几个直接的价值:

- 低成本试错:RTX 5090 即可运行全模态 Agent,无需租用昂贵的 GPU 集群

- 生产可用:FP8 推理优化意味着生产部署的性能有保障

- 多场景覆盖:Nano 到 Ultra 三个版本覆盖从边缘到数据中心的部署需求

- 生态锁定少:开源协议意味着不会被单一供应商绑定

总结

英伟达 Nemotron 3 Nano Omni 的发布,标志着 AI 大模型竞争进入了新阶段:参数规模不再是唯一指标,效率、成本、硬件兼容性正在成为 Agent 时代的核心竞争力。

当模型不再是奢侈品而是基础设施时,谁能以更高效的方式把它送到开发者手中,谁就掌握了下一个赛道的入场券。