国产模型 + Agent 框架:生态融合的关键一步

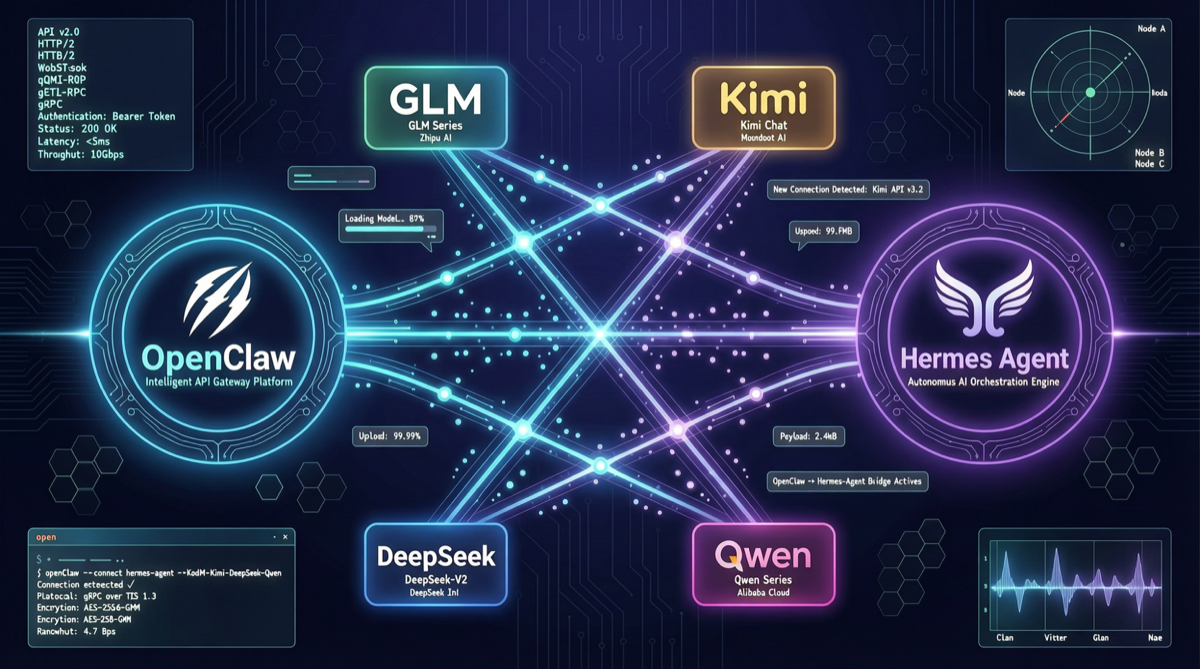

2026 年上半年,AI Agent 框架的模型兼容性出现了一个标志性变化:OpenClaw 和 Hermes Agent 已全面支持接入主流国产模型。

这意味着开发者不再被锁定在单一模型供应商的生态中。你可以在同一个 Agent 框架里切换 GLM-5.1、Kimi K2.6、DeepSeek V4 Pro、Qwen 3.6 等国产模型,根据任务类型和成本预算灵活选择。

社区已有产品实现了”同时给 OpenClaw 和 Hermes 提供易用 Web 界面,只要填写 AI Key,剩下什么都不用配置”的零门槛接入体验。这标志着国产模型在 Agent 框架生态中的可用性已经从”能接”迈入了”好用”阶段。

支持的国产模型全景

目前主流 Agent 框架已支持接入的国产模型包括:

| 模型 | 提供商 | 接入方式 | 最佳场景 |

|---|---|---|---|

| GLM-5.1 | 智谱 | API / OpenClaw 内置 / Hermes MCP | 编程 Agent、代码审查 |

| Kimi K2.6 | 月之暗面 | API / Hermes 内置 / OpenClaw | 长上下文、大型代码库 |

| DeepSeek V4 Pro | DeepSeek | API / OpenClaw 内置 | 性价比编程、调试分析 |

| Qwen 3.6 Max | 阿里 | API / Hermes MCP | 智能体编程、多文件协作 |

| MiniMax M2.7 | MiniMax | API | 高频 Agent 调用 |

| MIMO V2.5 Pro | 小米 | API / Ollama | Code Agent、边缘部署 |

OpenClaw 接入配置

OpenClaw 的模型配置通过 .openclaw/config.yaml 管理,支持多模型切换。

GLM-5.1 接入

models:

glm-5.1:

provider: zhipu

apiKey: "${ZHIPU_API_KEY}"

model: glm-5.1

contextWindow: 131072

maxTokens: 8192

temperature: 0.3GLM-5.1 在 OpenClaw 中的优势是代码生成稳定性。实测在连续 20 轮以上的编程对话中,GLM-5.1 对变量命名约定的保持能力在国产模型中最强。

Kimi K2.6 接入

models:

kimi-k26:

provider: moonshot

apiKey: "${MOONSHOT_API_KEY}"

model: kimi-k2.6

contextWindow: 256000

maxTokens: 16384

temperature: 0.2Kimi K2.6 的 256K 上下文窗口是核心优势。在大型代码库场景中——比如需要同时读取几十个源文件的 refactoring 任务——Kimi 的表现明显优于其他国产模型。

DeepSeek V4 Pro 接入

models:

deepseek-v4-pro:

provider: deepseek

apiKey: "${DEEPSEEK_API_KEY}"

model: deepseek-v4-pro

contextWindow: 128000

maxTokens: 8192

temperature: 0.4DeepSeek V4 Pro 的核心竞争力是性价比。它的单位 token 成本在国产模型中最低,适合需要大量 API 调用的 Agent 工作流。

Hermes Agent 接入配置

Hermes Agent 通过 MCP(Model Context Protocol)和内置模型配置两种方式接入国产模型。

MCP 方式接入

{

"mcpServers": {

"zhipu-glm": {

"command": "npx",

"args": ["-y", "@zhipu/mcp-server"],

"env": {

"ZHIPU_API_KEY": "${ZHIPU_API_KEY}",

"MODEL": "glm-5.1"

}

},

"moonshot-kimi": {

"command": "npx",

"args": ["-y", "@moonshot/mcp-server"],

"env": {

"MOONSHOT_API_KEY": "${MOONSHOT_API_KEY}",

"MODEL": "kimi-k2.6"

}

}

}

}内置模型配置

Hermes Agent 的 .hermes/models.json 支持直接配置国产模型:

{

"defaultModel": "kimi-k2.6",

"models": {

"kimi-k2.6": {

"provider": "moonshot",

"apiKey": "${MOONSHOT_API_KEY}",

"capabilities": ["code", "long-context", "reasoning"]

},

"glm-5.1": {

"provider": "zhipu",

"apiKey": "${ZHIPU_API_KEY}",

"capabilities": ["code", "tool-use"]

},

"deepseek-v4-pro": {

"provider": "deepseek",

"apiKey": "${DEEPSEEK_API_KEY}",

"capabilities": ["code", "debug", "reasoning"]

}

}

}成本对比:国产模型在 Agent 场景的实际开销

对于需要高频调用的 Agent 工作流,模型选择直接影响运营成本。以下以每日 100 次 Agent 调用、平均每次 8000 输入 + 4000 输出 token 计算:

| 模型 | 输入 ($/M) | 输出 ($/M) | 日均成本 | 月成本 |

|---|---|---|---|---|

| GLM-5.1 Coding Plan | 订阅制 | 订阅制 | — | ¥469 |

| Kimi K2.6 | ~$0.50 | ~$1.00 | ~$0.07 | ~$2.10 |

| DeepSeek V4 Pro | $0.60 | $1.20 | $0.072 | $2.16 |

| Qwen 3.6 Plus | ~$0.30 | ~$0.60 | $0.036 | $1.08 |

| MiniMax M2.7 | $0.30 | 未公开 | < $0.05 | < $1.50 |

关键发现:国产模型的 Agent 使用成本仅为 GPT-5.5 的 1/10 到 1/20,为个人开发者和小型团队提供了经济可行的 Agent 部署方案。

实战技巧

1. 模型路由:按任务类型自动切换

在 OpenClaw 中可以配置模型路由规则,让框架根据任务自动选择最优模型:

routing:

rules:

- pattern: ".*代码生成|写函数|实现.*"

model: glm-5.1

reason: "代码生成稳定性最佳"

- pattern: ".*分析.*文件|重构.*项目|.*全部代码.*"

model: kimi-k2.6

reason: "长上下文处理优势"

- pattern: ".*debug|排查.*bug|.*为什么出错.*"

model: deepseek-v4-pro

reason: "推理链条完整"

- pattern: ".*翻译|摘要|总结.*"

model: qwen-3.6-plus

reason: "性价比高"2. 降级策略:主模型不可用时的自动切换

fallback:

primary: glm-5.1

secondary: kimi-k2.6

tertiary: deepseek-v4-pro

maxRetries: 33. 上下文管理:国产模型的 Context 优化

国产模型虽然支持大上下文窗口,但实际有效注意力范围有限。建议:

- GLM-5.1:实际有效上下文约 64K,建议分块处理超大代码库

- Kimi K2.6:实际有效上下文约 128K,是国产模型中最好的

- DeepSeek V4 Pro:实际有效上下文约 64K,适合中等规模任务

模型选择决策树

你的主要任务是什么?

├── 代码生成 / 实现功能

│ ├── 需要稳定高质量输出? → GLM-5.1

│ └── 预算敏感? → Qwen 3.6 Plus

├── 大型代码库 / 多文件重构

│ └── → Kimi K2.6(长上下文)

├── Debug / 排查问题

│ └── → DeepSeek V4 Pro(推理链条完整)

├── 高频 Agent 循环调用

│ └── → MiniMax M2.7(成本最低)

└── 通用任务 / 日常辅助

└── → Qwen 3.6 Plus(性价比最佳)总结

2026 年上半年,国产模型在 Agent 框架中的集成度已经发生了质的飞跃。从”只能接 API”到”零配置一键接入”,从”勉强能用”到”稳定好用”,国产模型正在 Agent 生态中扮演越来越重要的角色。

对于开发者而言,这意味着一个关键转变:你不再需要依赖单一模型供应商,而是可以像选择数据库一样,根据任务类型、性能需求和预算,灵活组合国产模型来构建最优的 Agent 工作流。

主要来源: