搜索这件事,从关键词匹配到语义搜索,再到现在的多模态搜索,迭代速度快得让人跟不上。OpenSearch-VL 是这条线上最新的开源玩家。

它解决什么问题

多模态深度搜索 Agent 的核心难点不是"搜什么",是"搜失败了怎么办"。

Agent 先感知输入(可能是文本+图片),然后规划搜索策略,调用工具,分析结果,再决定下一步。这个链条里任何一环断了,整个搜索就废了。

OpenSearch-VL 用了一个叫 fatal-aware GRPO 的方法来应对这个问题。GRPO 是 Group Relative Policy Optimization,一种强化学习算法。fatal-aware 的意思是,模型在训练时就学会了区分"小失误"和"致命错误",对后者做出不同的响应。

简单说:普通 GRPO 遇到错误会尝试修复,fatal-aware GRPO 先判断这个错误是不是致命的,如果是,直接切换策略而不是硬修。

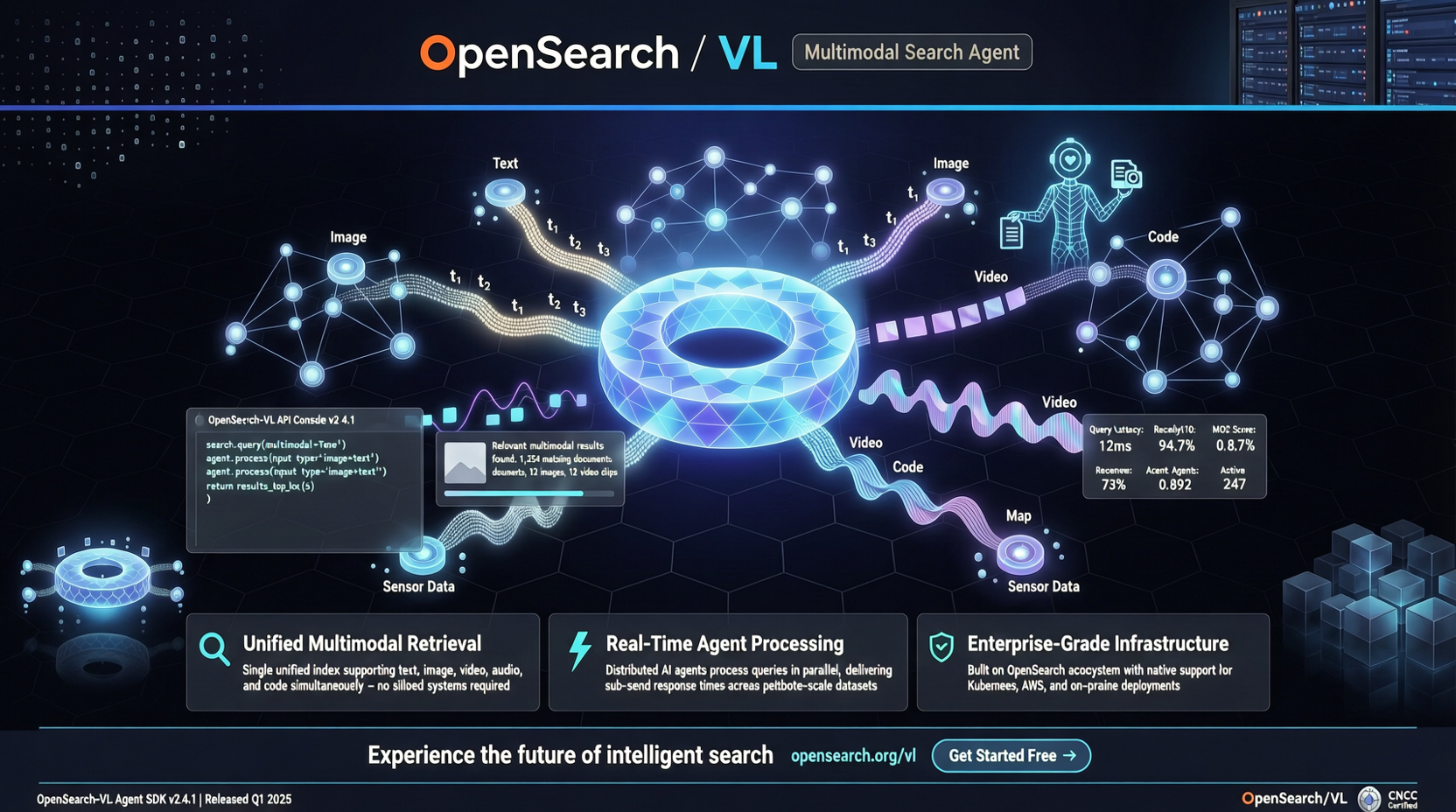

工具箱是统一的

框架内置了一个统一的工具环境,搜索 Agent 可以调用的工具包括检索、分析、排序、多模态理解等。这些工具不是松散拼接的,而是在一个统一的环境里被 RL 训练。

这意味着工具之间的切换成本更低,Agent 学到的策略更稳定。

数据集是策展过的

报告提到使用了"curated datasets"。这点值得注意——多模态搜索的训练数据质量直接决定了 Agent 的上限。随便抓一批图文对来训练,效果不会好。

OpenSearch 团队在数据筛选上花了功夫,这对复现效果很重要。

能不能用

项目完全开源,包含模型权重和训练代码。如果你在做搜索相关的产品,或者对多模态 Agent 感兴趣,这个 repo 值得看。

几个需要留意的地方:

- 10+ 项能力提升这个说法比较模糊,具体数字和基线模型需要在论文里找

- 多模态搜索对算力要求不低,本地跑需要一定的 GPU 资源

- GRPO 训练本身也不便宜,如果要 fine-tune 的话要有预算

主要来源: