Agent 圈现在有两派。

一派还在死磕 prompt engineering——换个系统提示词、加几个 few-shot 例子、调调 temperature,指望 Agent 突然开窍。另一派已经开始用强化学习了。

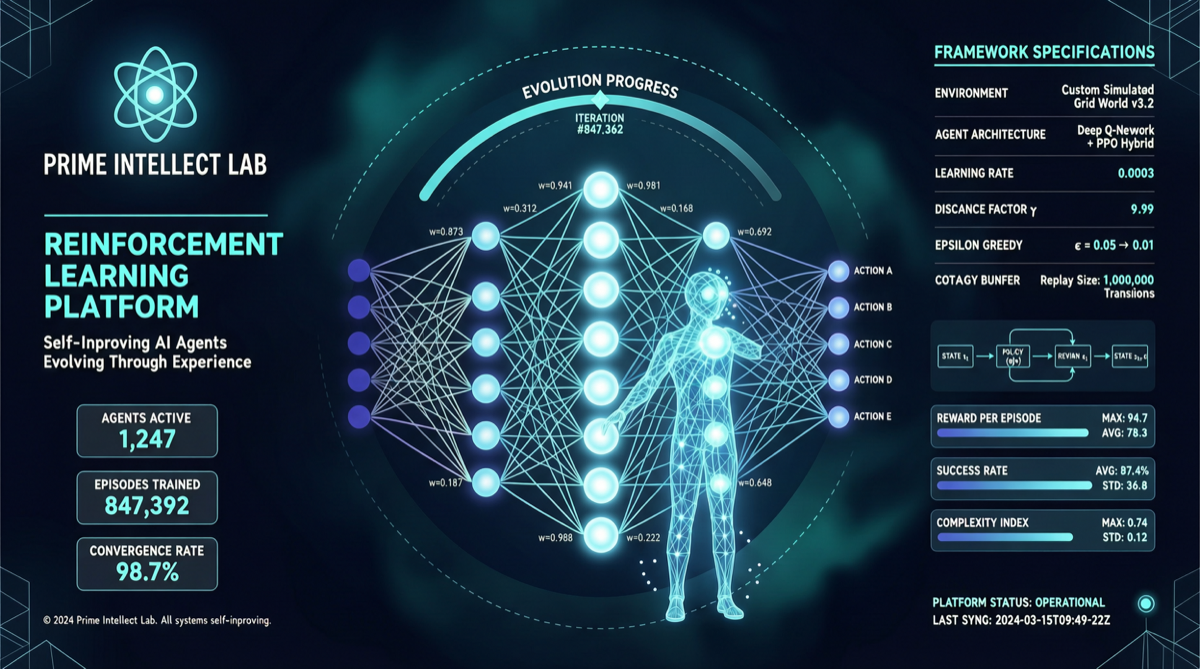

Prime Intellect Lab 今天正式结束 Beta,对外开放。它的定位很明确:别写 prompt 了,让系统自己从经验里学。

传统微调 vs 持续学习

传统的模型微调是这样的:收集一批标注数据,跑一次训练,部署上线。训练完的那一刻,模型的能力就固化了。新场景、新反馈,它不会自己更新。

Prime Intellect 做的是在线强化学习:Agent 在真实环境中执行任务,拿到结果反馈,自动更新策略。做得好就强化,做得不好就调整。跟人类"从实践中学习"的逻辑一样。

用他们自己的话说:"STOP PROMPTING, START TRAINING."

平台能力

Prime Intellect Lab 提供了一套完整的 RL 训练管线:

- RL 环境构建:定义 Agent 的任务空间和奖励函数

- 评估体系:自动跑评测,量化 Agent 表现

- 后训练(Post-training):在预训练模型基础上做 RL 微调

- 部署:训练完直接部署为可调用的 Agent

端到端的意思就是:从定义任务到 Agent 上线,不需要在多个工具之间跳来跳去。

这个方向为什么重要

Agent 领域正在出现一个共识:最好的 Agent 不是 prompt 写出来的,是训出来的。

Claude 的 Dreaming 功能(回顾过去会话提取模式)、Anthropic 的 Outcomes(基于 rubric 自动迭代)、甚至一些开源项目里的 self-learning 机制,本质上都在往同一个方向走——让 Agent 有能力从自身经验中改进。

Prime Intellect 把这条路径产品化了。它不是某个大模型公司的内部工具,而是一个开放的、任何人都可以用的 RL 训练平台。

门槛在哪里

强化学习不是新东西,但把 RL 用在 Agent 训练上,门槛不低:

- 奖励函数设计:怎么定义"做得好"?这是 RL 里最难的环节之一

- 训练稳定性:在线学习容易出现 catastrophic forgetting(学了新的忘了旧的)

- 算力成本:RL 训练比监督微调吃算力得多

Prime Intellect Lab 的价值就在于把这些工程问题封装好了。开发者不需要从零搭建 RL 管线,可以直接开始定义任务和奖励函数。

适合谁用

- Agent 框架开发者:想给 Agent 加自改进能力,但不想自己从头写 RL 管线

- 垂类应用团队:有明确的业务场景和反馈信号(比如客服 Agent 的用户满意度),可以用 RL 持续优化

- 研究团队:需要一个标准化的 RL Agent 训练环境做实验

不适合的场景:如果你的 Agent 任务是静态的、环境不变的、反馈信号不清晰的,RL 训练大概率是杀鸡用牛刀。

主要来源:Prime Intellect 官方公告、X/Twitter 社区讨论