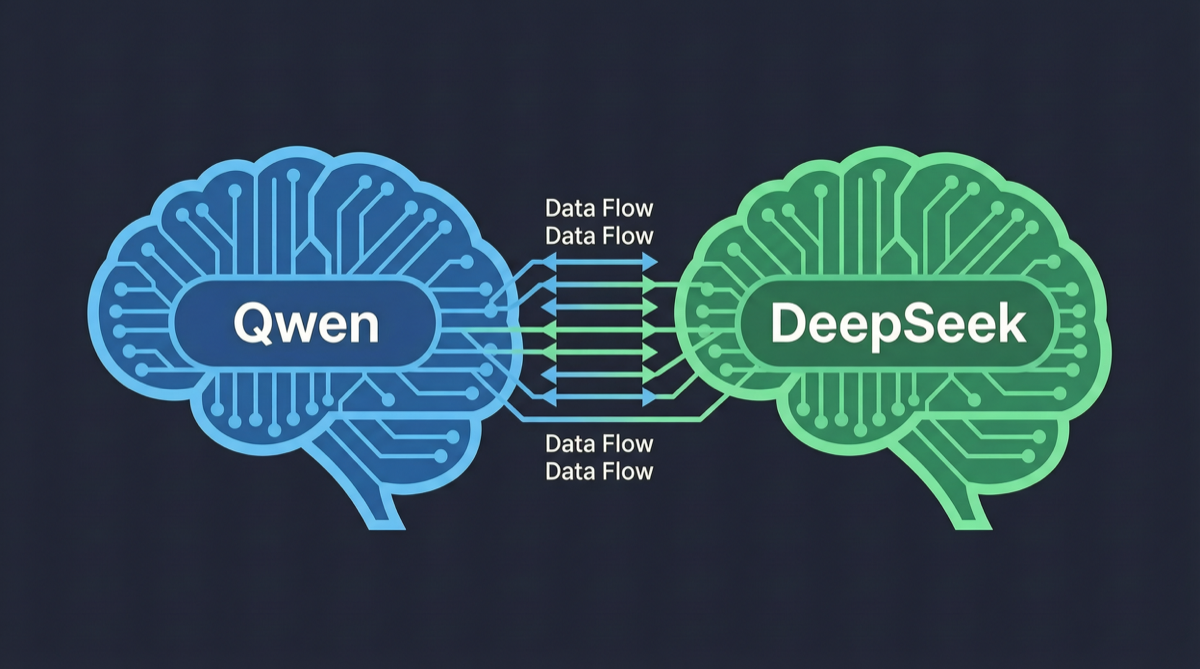

2026 年 5 月初,Hugging Face 上出现了一个名为 QwenSeek-2B 的新模型。它不是大厂出品,而是来自社区开发者的独立项目——用 Qwen3.5-2B 作为学生模型,DeepSeek-V4 的

发生了什么

| 维度 | 详情 |

|---|---|

| 学生模型 | Qwen3.5-2B(阿里 Qwen 团队的 2B 参数开源模型) |

| 教师信号 | DeepSeek-V4 输出的 |

| 许可证 | Apache 2.0(可商用) |

| 发布平台 | Hugging Face |

| 运行要求 | 单张 RTX 3060 / 4060 即可推理 |

核心思路很简单:让一个小模型学会大模型的推理过程。不是简单地模仿输出结果,而是学习”怎么想”——DeepSeek-V4 在回答前生成的

为什么值得关注

第一,跨模型蒸馏的新路径。 此前的蒸馏工作大多在同一家族内进行(大 Qwen 蒸馏到小 Qwen)。QwenSeek-2B 打破了这个限制:用 DeepSeek 的推理能力来增强 Qwen 架构,证明了思维链知识可以跨架构迁移。

第二,2B 参数门槛极具实用价值。 2B 模型只需要 4-6GB 显存即可运行,意味着它可以在:

- 消费级笔记本 GPU(RTX 3060/4060)

- 边缘设备(Jetson Orin Nano)

- 低成本云服务器($5-10/月的 VPS)

第三,Apache 2.0 许可证。 没有商用限制,企业可以直接集成到产品中,无需担心许可证合规问题。

格局判断

这个实验揭示了一个正在形成的趋势:思维链(CoT)本身正在成为一种可蒸馏的知识资产。

当 DeepSeek-V4 这样的开源模型大量使用

- 用 Claude 的推理模式蒸馏到 Llama

- 用 GPT-4o 的多模态推理蒸馏到 Qwen-VL

- 用多个教师的思维链集成蒸馏到一个学生

这可能会加速”小模型大能力”的趋势——2B-7B 参数量的模型,通过吸收更大模型的推理过程,在某些任务上逼近更大的竞争对手。

行动建议

| 你的场景 | 建议 |

|---|---|

| 需要在边缘设备部署推理 Agent | 尝试 QwenSeek-2B,显存门槛低 |

| 已有 Qwen3.5-2B 部署 | 可以横向对比蒸馏前后的输出质量差异 |

| 做模型微调实验 | 参考其蒸馏流程,用你自己的教师信号做类似实验 |

| 商用产品集成 | Apache 2.0 允许直接使用,但建议先在非关键路径验证 |

注意:这是社区实验性项目,不是官方发布。稳定性、安全性和长期维护没有保障。生产环境使用前务必自行评估。