動画、画像、音声、テキスト――かつて各モーダルごとに別々のモデルパイプラインが必要だった。ByteDanceはそれを1つで済ませたいと考えている。

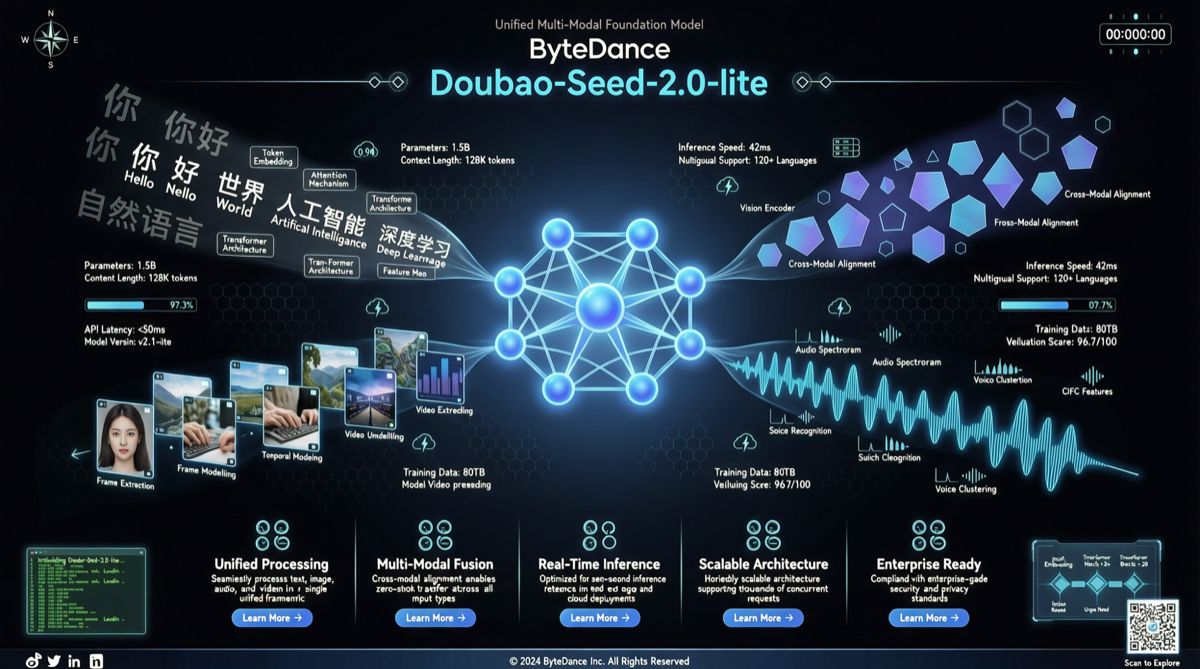

火山引擎は本日Doubao-Seed-2.0-liteを発表した。豆包ファミリー初の「フルモーダル理解モデル」だ。核心の売点はシンプル:動画、画像、音声、テキストを統合パイプラインで処理、モデルの切り替えは不要。

変更点

注目すべきアップグレードポイント:

音声・映像統合推論。単純な「動画フレーム抽出+音声認識」のパイプラインではない。モデルは生のビデオストリームとオーディオストリーム上で同時に推論を行う。つまり、音声の感情や環境音――背景の咳払い、外の車の音――を検知し、理解に組み込める。何を言ったかを文字起こしするだけではない。

19言語の文字起こし+14言語の相互翻訳。前世代からカバレッジが大幅に拡大。多言語シナリオで翻訳モデルを別途アタッチする必要がない。

高度な推論と細粒度認識。具体的なベンチマーク数値は公表されていないが、デモからSeedance 1.0時代からの質的飞跃がうかがえる。eスポーツコーチング、教育、ECシーンですでに商用化が進んでいる。

実用例:AI eスポーツコーチ

コミュニティでの面白い事例:Harness Agentフレームワーク+Doubao-Seed-2.0-LiteでCS2のAI eスポーツコーチを作った人がいる。試合の録画をドロップするだけで、ポジショニング、ムーブメント、銃撃戦、プリエイム、ユーティリティ使用、経済などを分析し、アドバイスとトレーニング方針を提示する。

このデモがバズった後ByteDanceが公式リツイートしており、「フルモーダル+垂直シーン」路线を_push_していることがわかる。汎用大モデルを作って撒き散らすのではなく、フルモーダル能力が明確に勝る具体的なシーンを見つけて、そこに深く入っていく。

ポジショニング

Doubao-Seed-2.0-liteの位置づけは明確:GPT-5.5やClaude Opus 4.7と汎用テキスト能力で競うのではない。マルチモーダル理解のレーンで「フルモーダル」のラベルを確保するのが目的だ。

Seedance 2.0はすでにLMArena動画ランキングで1位(KlingとHappy Horseをリード)。Seed-2.0-liteが音声とクロスモーダル能力を追加し、ByteDanceはマルチモーダル面で明らかに先行している。

ただしテキスト能力は依然として基盤。DoubaoがLMArenaテキストランキングでGPTやClaudeに追いつけないなら、マルチモーダルの強さはボーナスであってコアコンピタンスではない。

次に注目すべきはDoubao-Seed-2.0-liteのAPI価格戦略と、豆包の有料サブスクリプションに統合されるかどうかだ。豆包はすでに有料ティアをテスト中であり、今回のモデルリリースはその重要な交渉材料になる可能性がある。

情報源

- 火山引擎公式発表

- Xコミュニティユーザー報告

- 豆包有料サブスクリプションテスト