视频、图片、音频、文字,以前每个模态各跑一套模型,现在字节跳动想用一个搞定。

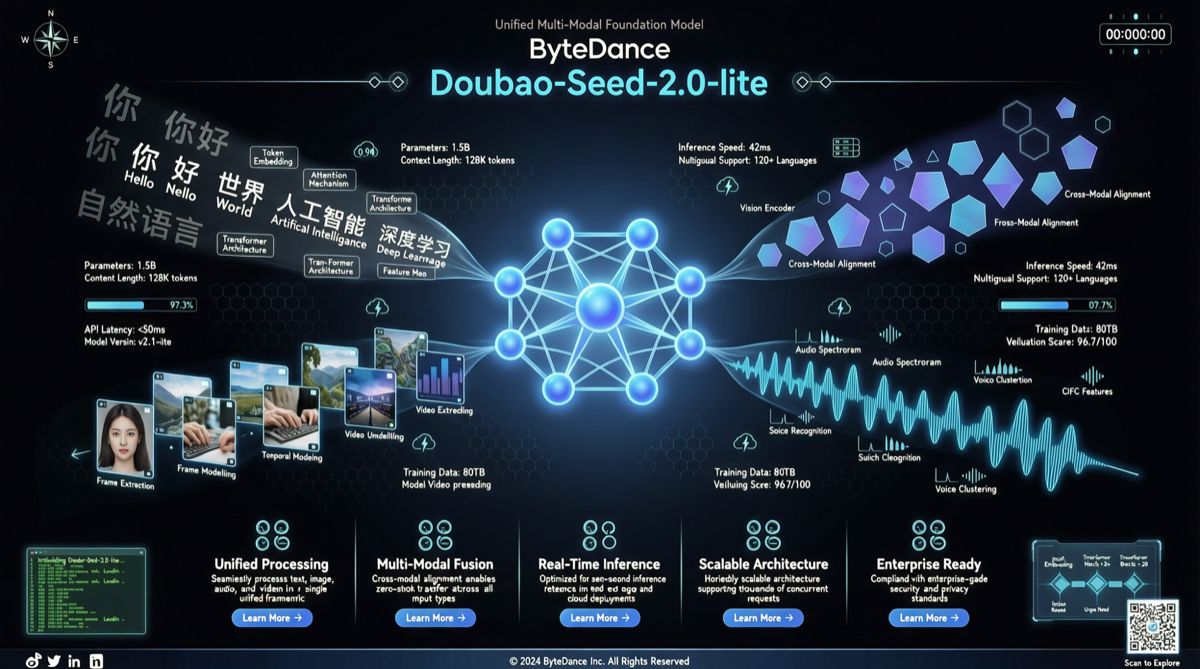

火山引擎今天发布了 Doubao-Seed-2.0-lite,豆包家族的首款"全模态理解模型"。核心卖点很直白:视频、图像、音频、文本统一处理,不需要你在不同模型之间切来切去。

能力拆解

几个值得留意的升级点:

音画联合推理。不是简单的"视频抽帧 + 语音转文字"拼接,而是让模型在原始视频流和音频流上同时做推理。这意味着它可以识别语音情绪和环境声——背景里有人在咳嗽、窗外有车流声,这些细节会被纳入理解范围,而不仅仅是转录说了什么。

19 种语种转写 + 14 种语言互译。覆盖范围比上一代明显扩展,多语言场景下不用额外挂载翻译模型。

高阶推理与细粒度感知。官方没说具体 benchmark 分数,但从演示来看,它在视频场景理解上的表现比 Seedance 1.0 时代有了质的提升。电竞教练、教育辅导、电商场景已经开始商业化落地。

实际场景:从 AI 电竞教练开始

一个有意思的案例是社区里有人用 Harness Agent 框架 + Doubao-Seed-2.0-Lite 做了一个 CS2 AI 电竞教练。拖进去比赛录屏,它能分析走位、身法、对枪、预瞄、投掷物、经济等各种数据,然后给出建议和训练方向。

这个 Demo 火了之后被字节跳动官方转发,说明他们确实在推"全模态 + 垂直场景"的路线。不是做一个通用大模型然后撒胡椒面,而是先找到能展示全模态优势的具体场景,再做深。

位置判断

Doubao-Seed-2.0-lite 的定位很清楚:不是跟 GPT-5.5 或 Claude Opus 4.7 拼通用文本能力,而是在多模态理解这条赛道上抢占一个"全模态"的标签。

目前来看,视频理解领域 Seedance 2.0 已经在 LMArena 视频榜排到第一(领先 Kling 和 Happy Horse),加上 Seed-2.0-lite 的音频和跨模态能力,字节在多模态这条线上确实走在了前面。

但文本能力仍然是地基。如果 Doubao 在 LMArena 文本榜上追不上 GPT 和 Claude,那多模态再强也只是加分项,不是核心竞争力。

下一步值得观察的是:Doubao-Seed-2.0-lite 的 API 定价策略,以及它是否会集成到豆包付费订阅体系中去。之前豆包已经在测试付费层级,这次的模型发布可能是付费内容的重要筹码。

来源

- 火山引擎官方发布

- X 社区用户实测分享

- Doubao 付费订阅测试