Видео, изображения, аудио, текст — раньше каждый модальность требовал отдельного конвейера моделей. ByteDance хочет заменить это одним решением.

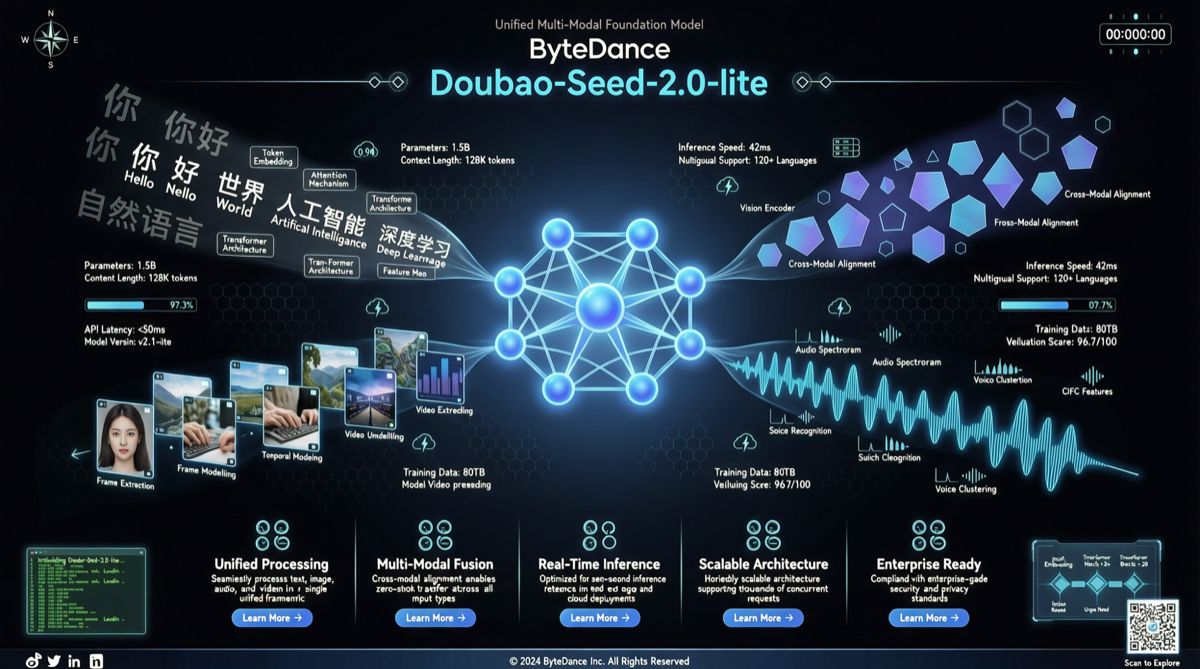

Volcengine сегодня выпустила Doubao-Seed-2.0-lite — первую «полномодальную модель понимания» в семействе Doubao. Основная идея проста: видео, изображения, аудио и текст обрабатываются в едином конвейере, без переключения между моделями.

Что изменилось

Несколько ключевых улучшений:

Совместный аудио-визуальный вывод. Это не простой конвейер «извлечение кадров из видео + распознавание речи». Модель выполняет выводы одновременно на сырых видеопотоках и аудиопотоках. Это означает, что она может распознавать эмоции голоса и окружающие звуки — кашель на заднем плане, шум транспорта за окном — и учитывать их в понимании, а не просто транскрибировать сказанное.

Транскрипция на 19 языках + перевод на 14 языков. Покрытие значительно расширилось по сравнению с предыдущим поколением. Многоязычные сценарии больше не требуют подключения отдельной модели перевода.

Продвинутый вывод и детализированное восприятие. Конкретные бенчмарки не опубликованы, но демо показывают качественный скачок по сравнению с Seedance 1.0 в понимании видеосцен. Сценарии киберспортивного коучинга, образования и электронной коммерции уже коммерциализируются.

Реальный сценарий: ИИ-тренер для киберспорта

Интересный пример из сообщества: кто-то создал ИИ-тренера для CS2 с использованием Harness Agent Framework + Doubao-Seed-2.0-Lite. Загрузите запись матча — и он анализирует позиционирование, движение, огневые контакты, прицеливание, использование утилит, экономику и многое другое, а затем даёт рекомендации и направление тренировок.

ByteDance официально ретвитнула это демо после того, как оно стало вирусным, что сигнализирует об их стратегии: «полномодальность + вертикальные сценарии» вместо создания универсальной модели в надежде на лучшее.

Позиционирование

Позиционирование Doubao-Seed-2.0-lite ясно: она не конкурирует с GPT-5.5 или Claude Opus 4.7 в общих текстовых возможностях. Она закрепляет метку «полномодальности» в полосе мультимодального понимания.

Seedance 2.0 уже занимает первое место в видео-рейтинге LMArena (впереди Kling и Happy Horse). С добавлением аудио- и кросс-модальных возможностей от Seed-2.0-lite, ByteDance явно лидирует в мультимодальном направлении.

Но текстовые возможности остаются фундаментом. Если Doubao не догонит GPT и Claude в текстовом рейтинге LMArena, мультимодальная сила будет бонусом, а не ключевой компетенцией.

Следующее, за чем стоит наблюдать: стратегия ценообразования API Doubao-Seed-2.0-lite и будет ли она интегрирована в платные подписки Doubao. Doubao уже тестирует платные уровни, и этот релиз модели может стать важным козырем.

Источники

- Официальное объявление Volcengine

- Отчёты пользователей X

- Тестирование платных подписок Doubao