核心的な結論

OpenAIのモデルイテレーションペースは前例のない加速を迎えている。GPT-5からGPT-5.5までの8ヶ月間で、バージョン間のインターバルは97日から49日に圧縮された――約半分に短縮されたのだ。これは偶然の最適化ではなく、競争圧力に基づく戦略的転換である。

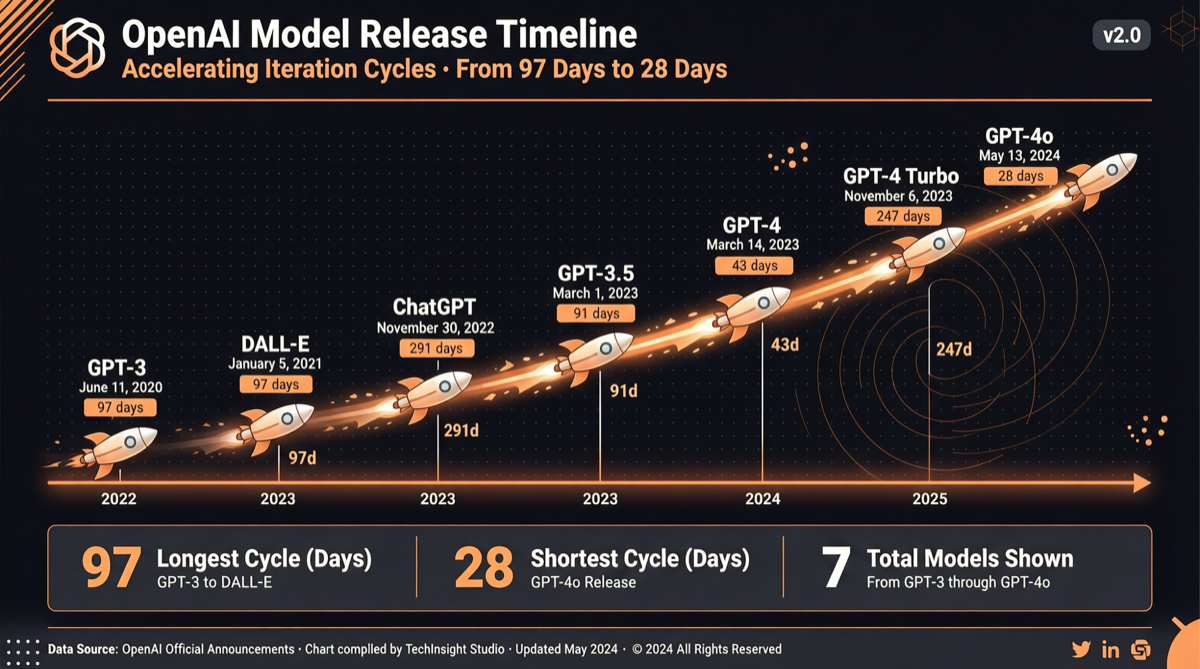

リリースサイクルデータ

| バージョン | リリース日 | 前バージョンからの期間 | 主な変更点 |

|---|---|---|---|

| GPT-5 | 2025-08-07 | — | 第5世代ベースモデル |

| GPT-5.1 | 2025-11-12 | 97 日 | 推論能力の強化 |

| GPT-5.2 | 2025-12-11 | 29 日 | 迅速なイテレーションによる修正 |

| GPT-5.3 Codex | 2026-02-05 | 56 日 | コーディング能力の専門強化 |

| GPT-5.4 | 2026-03-05 | 28 日 | 最短インターバル |

| GPT-5.5 | 2026-04-23 | 49 日 | Terminal-Benchでの優れたパフォーマンス |

| GPT-5.6 | 6月中旬予想 | 約50 日 | 未リリース |

リリース間隔短縮の背景にある要因

1. 競争圧力

- Anthropicは2026年Q1に28の新機能をリリースし、Claude Opus 4.7は複数のベンチマークで首位を占めた

- GoogleはGemini 3.5 Proを準備中であり、Google I/O(5月19日)前後でのリリースが噂されている

- 中国国産モデルではGLM 5.1やKimi K2.6がトップティアに到達しており、格差は縮まりつつある

2. インフラの成熟

- トレーニングパイプラインの最適化により、イテレーション速度が「月」単位から「週」単位へ向上した

- RLHFおよびAgent RLの自動化レベルが向上した

- 評価システムの標準化により、手動評価のボトルネックが解消された

3. ビジネスロジックの変化

- API収益モデルは顧客維持のために継続的な機能更新を必要としている

- 企業顧客は「最新モデル」を調達の基準とし始めた

- オープンソースモデルの追い上げにより、クローズドソースモデルはイテレーション速度を維持せざるを得なくなっている

GPT 5.6 のリリース可能性が高い時期

シナリオA:6月中旬リリース(ベースライン予測)

- 約50日のインターバル規律に従う場合

- GPT-5.5から十分なデータ収集期間を確保できる

シナリオB:5月19日 Google I/O 前後のリリース(加速予測)

- GoogleがGemini 3.5 Proをリリースする場合、OpenAIは注目を集めるためにリリースを前倒しする可能性がある

- これは「防御的リリース」戦略である

シナリオC:7月 AMD Advancing AI カンファレンス前後

- ハードウェアリリースのタイミングに合わせる

- AMDチップ上でのGPT-5.6の最適化パフォーマンスを披露する

開発者への影響

技術面:

- モデルの更新が頻繁になるにつれ、「最新を追いかける」コストが増大している

- 各新バージョンを手動で適応させるのではなく、自動化されたモデル切り替えメカニズムの構築を推奨する

- API互換性の変更に注目する――急速なイテレーションは破壊的変更(breaking changes)をもたらす可能性がある

ビジネス面:

- OpenAIが50日ごとに新バージョンをリリースする場合、企業の調達判断では「このモデルがいつ陳腐化するか」を考慮する必要がある

- 切り替えコストを低減するため、モデル抽象化レイヤー(Sim、LangChainなど)の採用を検討する

- APIの価格はバージョンイテレーションに応じて調整される可能性があり、コスト変動に注意する

業界構造の見通し

モデルリリースサイクルの圧縮は、「Model-as-a-Service」競争が性能比較から速度競争へ進化したことを意味する。研究成果をより迅速にプロダクト化できる者が、開発者エコシステムで先行優位に立てる。

Anthropicは「品質重視」路線を歩む――機能は少ないが厳選されている。OpenAIは「速度重視」路線――迅速なイテレーションと小刻みな改善を繰り返す。Googleは「エコシステム統合」路線――検索、クラウド、Androidなどの既存プロダクトにモデル機能を組み込む。

これら3つの路線に絶対的な優劣はないが、速度重視路線の利点は次の点にある。AIという急激に変化する領域において、「速さ」そのものが競争上の堅牢な防壁(モート)となるのだ。

アクション提案

- GPT 5.6 を待たない:現在のGPT-5.5はすでに成熟して利用可能なバージョンであり、まず活用を開始する

- モデル抽象化レイヤーの構築:LangChainやLiteLLMなどのツールを活用し、モデル切り替えコストを低減する

- API変更ログの監視:急速なイテレーションはより多くの破壊的変更を伴うため、常にチェックする

- マルチモデル戦略の検討:すべての依存を単一モデルに置かず、GLM 5.1、Kimi K2.6、DeepSeek V4 Proなど有力な代替案を確保する