Ключевые выводы

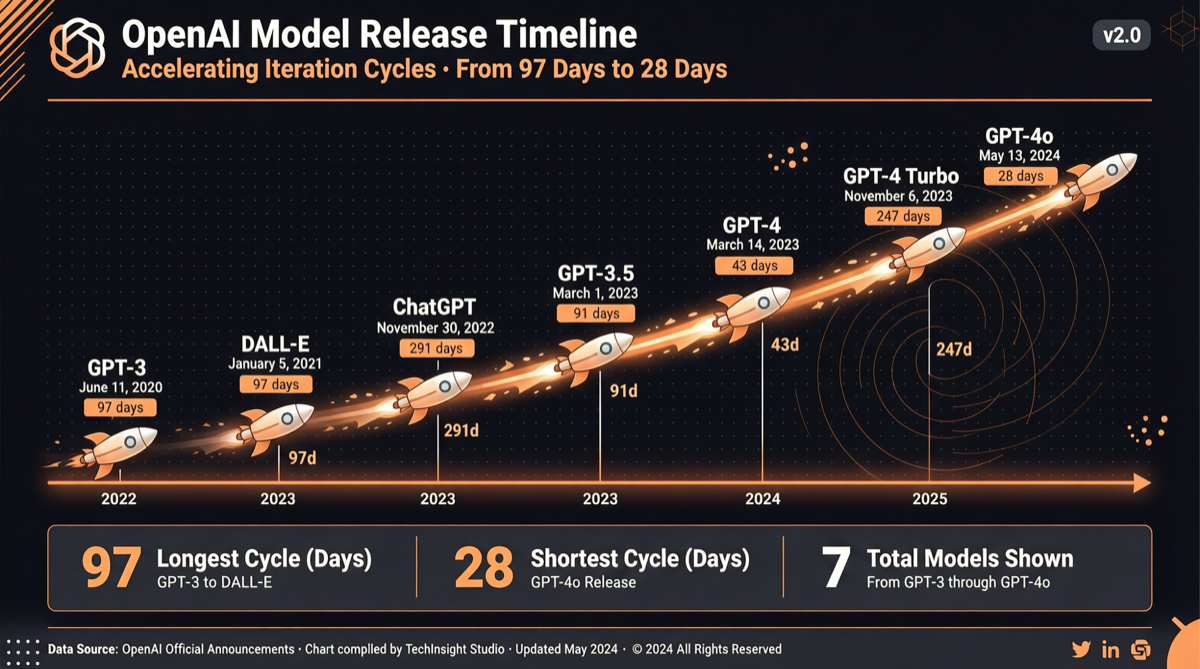

Темпы обновления моделей OpenAI переживают небывалое ускорение. За 8 месяцев, прошедших с GPT-5 до GPT-5.5, интервал между выпусками сократился с 97 до 49 дней — в два раза. Это не случайная оптимизация, а стратегическая корректировка под давлением конкуренции.

Данные о циклах выпуска

| Версия | Дата выпуска | Интервал с предыдущей | Основные изменения |

|---|---|---|---|

| GPT-5 | 2025-08-07 | — | Базовая модель пятого поколения |

| GPT-5.1 | 2025-11-12 | 97 дней | Усиление способностей к рассуждению |

| GPT-5.2 | 2025-12-11 | 29 дней | Быстрая итерация исправлений |

| GPT-5.3 Codex | 2026-02-05 | 56 дней | Специализация на программировании |

| GPT-5.4 | 2026-03-05 | 28 дней | Самый короткий интервал |

| GPT-5.5 | 2026-04-23 | 49 дней | Выдающиеся результаты в Terminal-Bench |

| GPT-5.6 | Ожидается: середина июня | ~50 дней | Ожидает выпуска |

Драйверы сжатия циклов выпуска

1. Давление конкуренции

- Anthropic выпустила 28 новых функций в Q1 2026, а Claude Opus 4.7 лидирует в ряде бенчмарков

- Google готовит Gemini 3.5 Pro, по слухам, выпуск намечен на период вокруг Google I/O (19 мая)

- Что касается китайских моделей, GLM 5.1 и Kimi K2.6 уже вошли в число лидеров начального сегмента, и разрыв сокращается

2. Зрелость инфраструктуры

- Оптимизация тренировочных конвейеров (pipeline) ускорила итерации с «месячного» до «недельного» уровня

- Возросла степень автоматизации RLHF и Agent RL

- Стандартизация систем оценки устранила узкие места, связанные с ручной проверкой

3. Изменение бизнес-логики

- Модель доходов от API требует постоянных обновлений функций для удержания клиентов

- Корпоративные клиенты начинают использовать «новейшую модель» как критерий закупок

- Догоняющие открытые модели вынуждают проприетарные решения сохранять высокие темпы обновления

Возможные временные окна для GPT 5.6

Сценарий A: Выпуск в середине июня (базовый прогноз)

- Следуя закономерности интервала ~50 дней

- Оставляет достаточно времени для сбора данных по GPT-5.5

Сценарий B: Выпуск в период вокруг Google I/O 19 мая (ускоренный прогноз)

- Если Google выпустит Gemini 3.5 Pro, OpenAI может ускорить релиз, чтобы перехватить внимание

- Это стратегия «оборонительного выпуска»

Сценарий C: В период конференции AMD Advancing AI в июле

- Синхронизация с графиком выпуска оборудования

- Демонстрация оптимизации GPT-5.6 на чипах AMD

Влияние на разработчиков

Технический уровень:

- Обновления моделей становятся всё чаще, стоимость «погони за новинками» растёт

- Рекомендуется внедрить автоматизированные механизмы переключения моделей вместо ручной адаптации к каждой новой версии

- Следите за изменениями совместимости API — быстрые итерации могут приводить к критическим изменениям (breaking changes)

Бизнес-уровень:

- Если OpenAI выпускает новую версию каждые 50 дней, при корпоративных закупках необходимо учитывать, «как быстро эта модель устареет»

- Рассмотрите использование уровней абстракции моделей (например, Sim, LangChain) для снижения затрат на переход

- Ценообразование API может корректироваться с выходом новых версий, следите за изменением затрат

Оценка ландшафта отрасли

Сжатие циклов выпуска моделей означает, что конкуренция в сегменте «Модель как услуга» перешла от сравнения производительности к гонке скоростей. Тот, кто быстрее превратит исследования в продукт, получит преимущество в экосистеме разработчиков.

Anthropic придерживается стратегии «качество превыше всего» — меньше функций, но они отточены. OpenAI делает ставку на «скорость» — быстрые итерации, движение маленькими шагами. Google выбирает путь «экологической интеграции» — встраивание возможностей моделей в существующие продукты: поиск, облако, Android и т.д.

У каждого из трёх подходов нет абсолютного превосходства, но преимущество скоростной стратегии заключается в следующем: в такой быстротечной сфере, как ИИ, скорость сама по себе становится конкурентным рвом (moat).

Рекомендации к действию

- Не ждите GPT 5.6: текущая версия GPT-5.5 уже зрелая и готовая к использованию, начните работать с ней

- Создайте уровень абстракции модели: используйте инструменты вроде LangChain, LiteLLM для снижения затрат на переключение

- Следите за журналом изменений API: быстрые итерации означают больше критических изменений (breaking changes)

- Рассмотрите многомодельную стратегию: не кладите все яйца в корзину одной модели, GLM 5.1, Kimi K2.6 и DeepSeek V4 Pro являются сильными альтернативами