マルチモーダル検索エージェントには共通の問題がある:最初のエンティティを調べ、次に二番目、次に三番目——ツールを一つずつ呼び出し、対話ラウンド数がクエリ内のエンティティ数に比例して増加する。

小紅書の論文はこの問題を逆転させた:なぜエージェントに一度に複数のエンティティを検索させないのか?

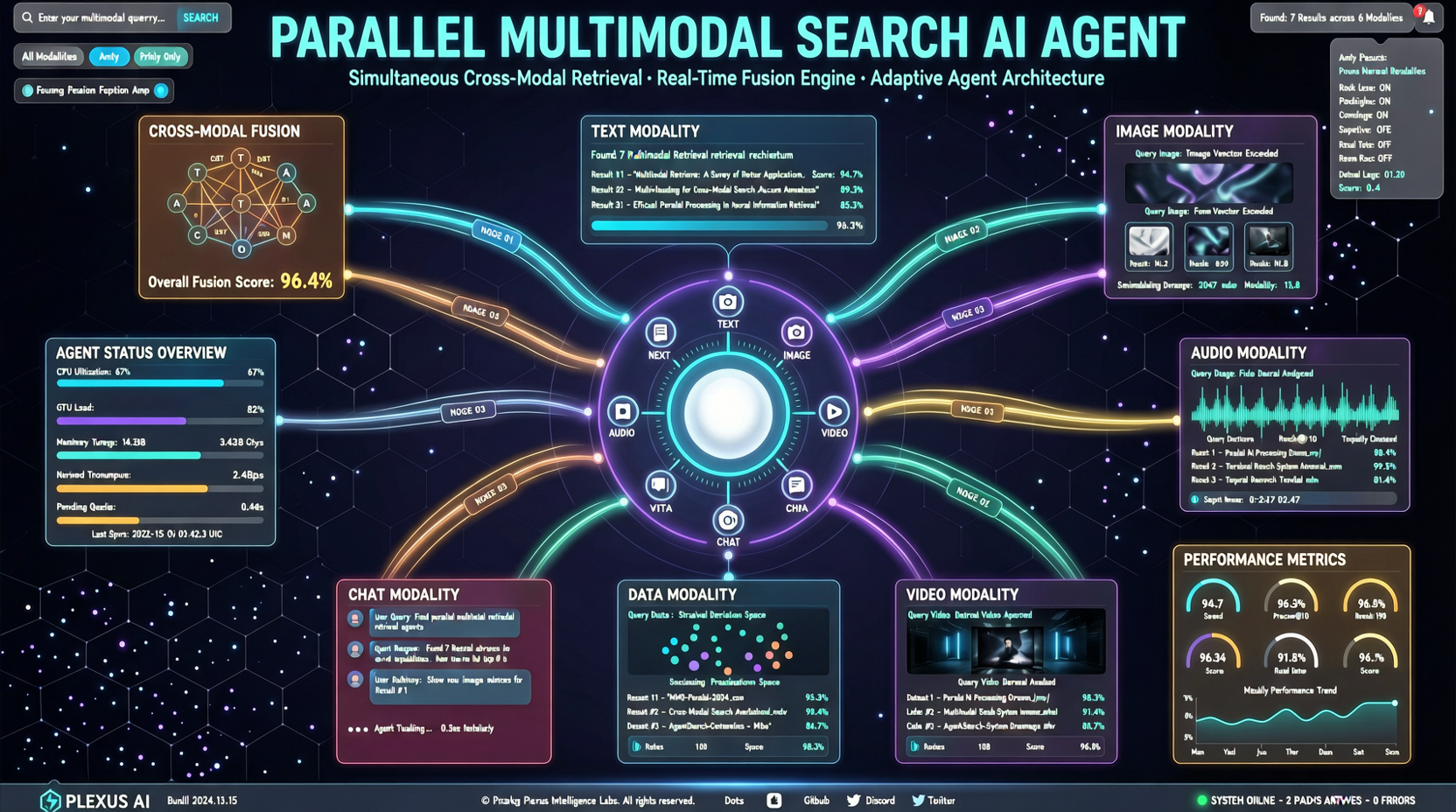

HyperEyesは視覚グラウンディングと検索を単一のアトミックアクションに融合し、1ラウンド内で複数のエンティティを並列検索可能にする。さらに珍しい設計選択として、推論効率を一等の訓練目標(first-class training objective)として扱い、事後最適化の指標にしていない。

二段階訓練

コールドスタート段階ではParallel-Amenable Data Synthesis Pipelineでデータを合成し、Progressive Rejection Samplingで効率重視の軌跡を選別する。

核心はDual-Grained Efficiency-Aware RLフレームワーク:

マクロレベル:TRACE(Tool-use Reference-Adaptive Cost Efficiency)、トレーニング中に参照を単調に引き締め、真のマルチホップ検索を妨げずに不要なツール呼び出しを抑制。

ミクロレベル:On-Policy Distillationで外部教師モデルからdenseなトークンレベルの修正信号を注入し、スパースな結果報酬のcredit assignment問題を解決。

300件人手キュレーションのIMEBベンチマークも提案。6つのベンチマークでHyperEyes-30Bは最強のオープンソースエージェントを精度9.9%上回り、ツール呼び出しラウンドは平均5.3倍削減。

コードとIMEBベンチマークはオープンソース。

主要ソース:

- arXiv:2605.07177, "HyperEyes: Dual-Grained Efficiency-Aware Reinforcement Learning for Parallel Multimodal Search Agents", Guankai Li et al. (Xiaohongshu), May 2026

- GitHub: github.com/Guankai-Li/HyperEyes