多模态搜索 Agent 有个通病:查到第一个实体,再去查第二个,再去查第三个——一个接一个地调工具,调用轮数随着查询中的实体数量线性增长。

小红书的这篇论文把这个问题翻过来了:为什么不让 Agent 一次查多个?

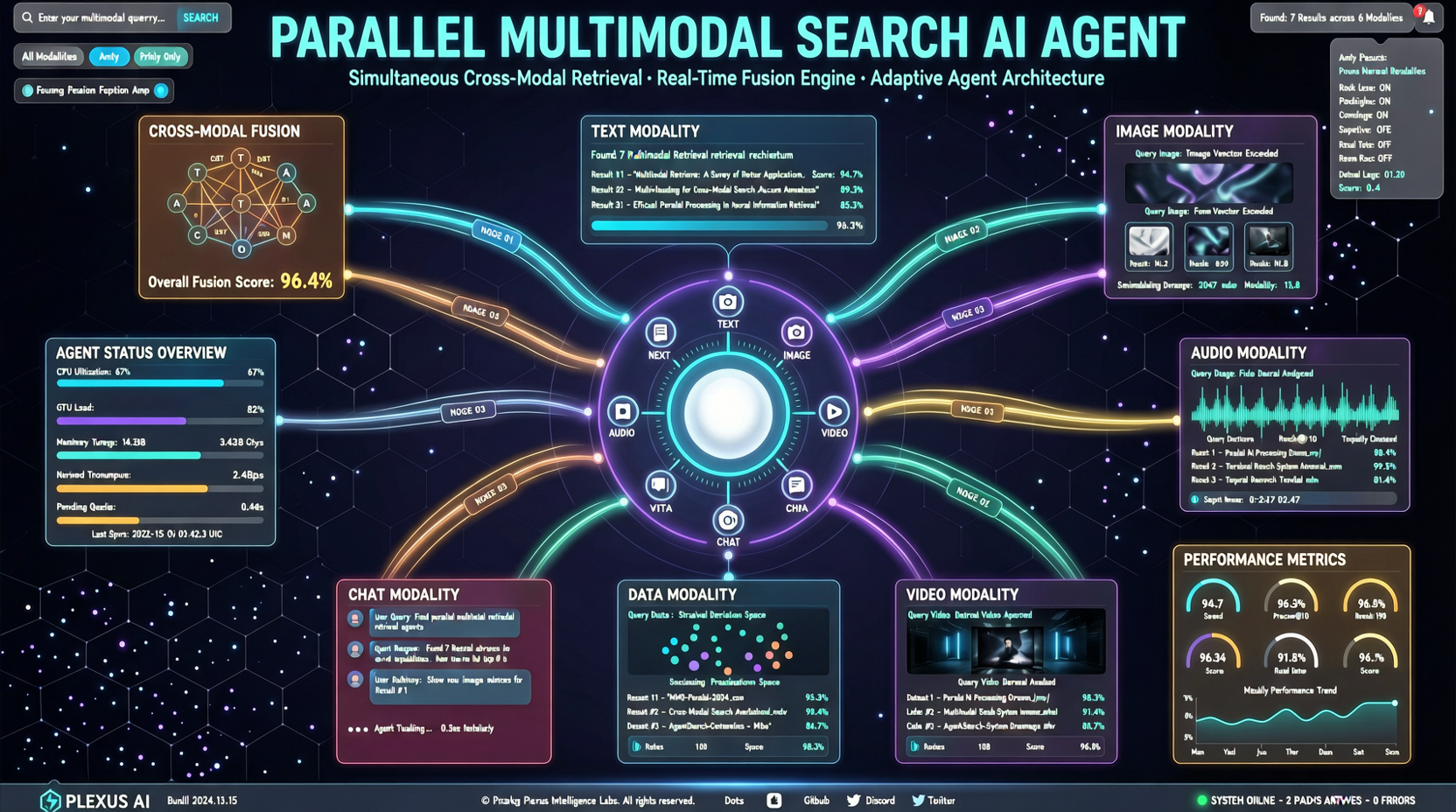

HyperEyes 的核心是把视觉定位和检索合并成一个原子动作(atomic action),在一次 round 内并发搜索多个实体。论文还做了一个很少见的决定:把推理效率当作一等训练目标(first-class training objective),而不是事后优化的指标。

双层训练框架

训练分两个阶段。冷启动阶段用 Parallel-Amenable Data Synthesis Pipeline 合成数据,覆盖视觉多实体和文本多约束查询,通过 Progressive Rejection Sampling 筛选出效率导向的轨迹。

核心贡献是 Dual-Grained Efficiency-Aware RL 框架,分两层:

宏观层:TRACE(Tool-use Reference-Adaptive Cost Efficiency),轨迹级别的奖励。训练过程中单调收紧参考标准,在不限制真实多步搜索的前提下抑制多余的工具调用。

微观层:用 On-Policy Distillation 从外部教师模型注入密集的 token 级别纠错信号,解决稀疏结果奖励的 credit assignment 问题。

他们还提出了 IMEB 基准——300 条人工标注的测试集,同时评估搜索能力和效率。六个基准上,HyperEyes-30B 比最强的可比开源 Agent 准确率高 9.9%,平均工具调用轮数少 5.3 倍。

值得关注的点

把效率当作训练目标而不是事后优化,这个思路在 Agent 领域还不常见。大多数论文只报告准确率,忽略推理成本。HyperEyes 的 TRACE 奖励机制在训练过程中动态收紧参考标准,既能减少冗余调用又不会误伤真正的多步推理需求。

30B 参数的模型在开源 Agent 里算是中等规模,5.3x 的工具调用缩减在实际部署中的成本收益比很可观。不过合成数据的质量和 IMEB 基准的覆盖范围还需要社区进一步验证。

代码和 IMEB 基准已开源。

主要来源:

- arXiv:2605.07177, "HyperEyes: Dual-Grained Efficiency-Aware Reinforcement Learning for Parallel Multimodal Search Agents", Guankai Li et al. (Xiaohongshu), May 2026

- GitHub: github.com/Guankai-Li/HyperEyes