У мультимодальных поисковых агентов есть общая проблема: они ищут первую сущность, затем вторую, затем третью — вызывают инструменты одну за другой, а количество раунтов взаимодействия растёт линейно с числом сущностей в запросе.

Статья от Xiaohongshu переворачивает это: почему бы не позволить агенту искать несколько сущностей одновременно?

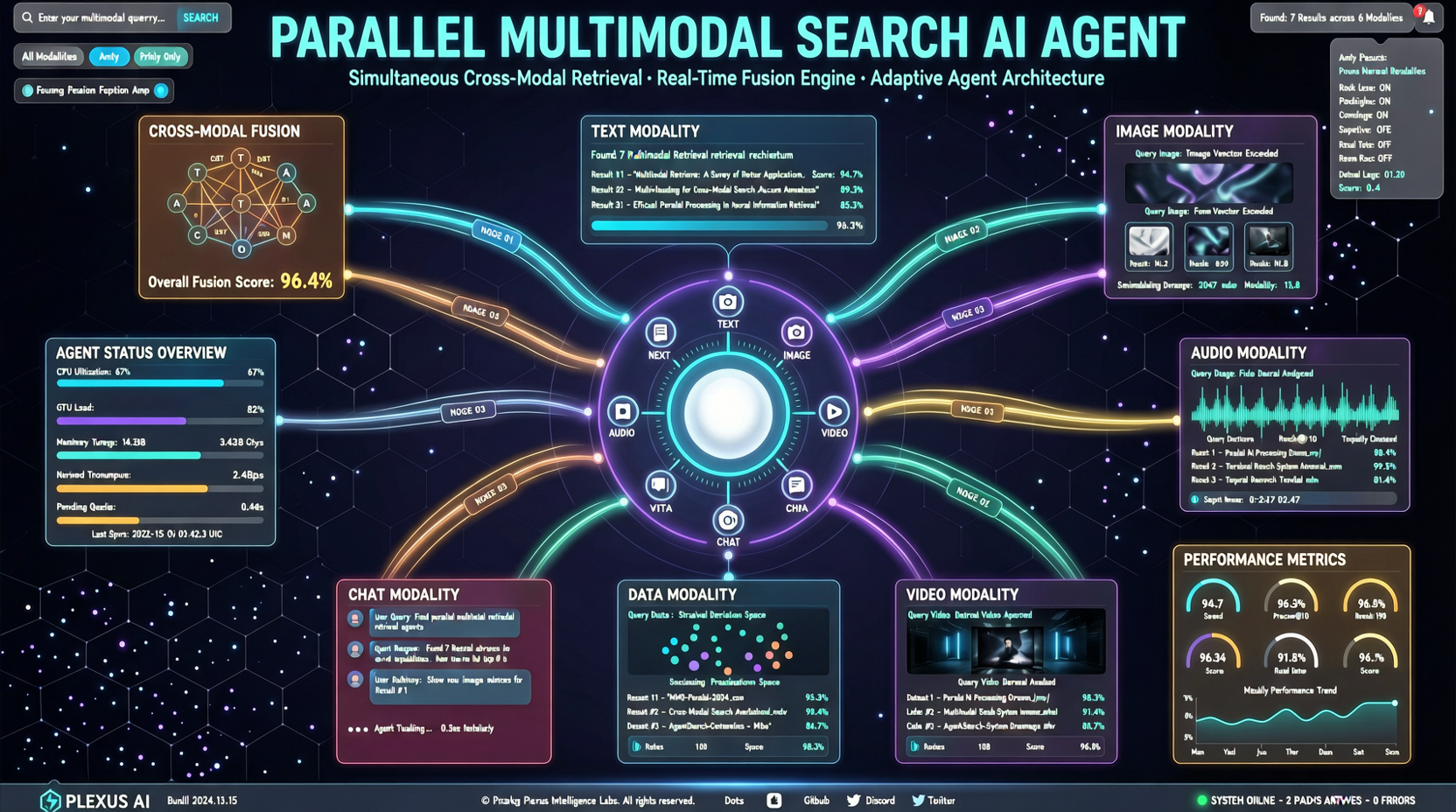

HyperEyes объединяет визуальное привязывание и поиск в одно атомарное действие, позволяя параллельно искать несколько сущностей в одном раунде. Необычное дизайн-решение: эффективность вывода рассматривается как цель обучения первого класса, а не как постфактум метрика.

Двухэтапное обучение

На этапе холодного старта Parallel-Amenable Data Synthesis Pipeline синтезирует данные, охватывая визуальные мульти-сущностные и текстовые мульти-ограничительные запросы, с Progressive Rejection Sampling для отбора траекторий, ориентированных на эффективность.

Ядро — Dual-Grained Efficiency-Aware RL фреймворк:

Макроуровень: TRACE (Tool-use Reference-Adaptive Cost Efficiency) — reward на уровне траектории, эталон которого монотонно ужесточается в процессе обучения, подавляя избыточные вызовы инструментов без блокировки настоящего многошагового поиска.

Микроуровень: On-Policy Distillation внедряет плотные токеновые корректирующие сигналы от внешней teacher-модели на неудачных rollout'ах, решая проблему назначения кредитов при sparse outcome rewards.

Предложен IMEB — бенчмарк из 300 вручную отобранных экземпляров, оценивающих как поисковую способность, так и эффективность. На шести бенчмарках HyperEyes-30B превосходит сильнейший сопоставимый open-source агент на 9.9% по точности при в 5.3 раза меньшем количестве раундов вызова инструментов.

Код и бенчмарк IMEB открыты.

Источники:

- arXiv:2605.07177, "HyperEyes: Dual-Grained Efficiency-Aware Reinforcement Learning for Parallel Multimodal Search Agents", Guankai Li et al. (Xiaohongshu), May 2026

- GitHub: github.com/Guankai-Li/HyperEyes