なぜエージェントシナリオには専門的な最適化が必要なのか?

現在のLLM最適化の多くは標準的な対話シナリオを対象としている——ユーザーが質問し、モデルが答える。しかし、エージェントワークロードは根本的に異なる:

- 長文脈が継続的に蓄積:エージェントがタスクを実行する際、ツール呼び出しの結果、中間状態、フィードバックを継続的に収集する。コンテキストウィンドウは時間とともに成長し続ける。

- 高密度なマルチターン推論:1つのエージェントタスクが10〜30回の連続推論ラウンドをトリガーすることがあり、それぞれが完全な注意力計算を必要とする。

- レイテンシに敏感:エージェントのユーザーエクスペリエンスはラウンドごとの推論レイテンシに直接依存する。累積レイテンシは全体体験の崩壊につながる。

これが、汎用LLM推論最適化がエージェントシナリオで効果が限定的な理由だ——それらはこれらの特殊なパターン向けに設計されていない。

Tokenspeed MLAライブラリ:エージェント専用に構築された最適化

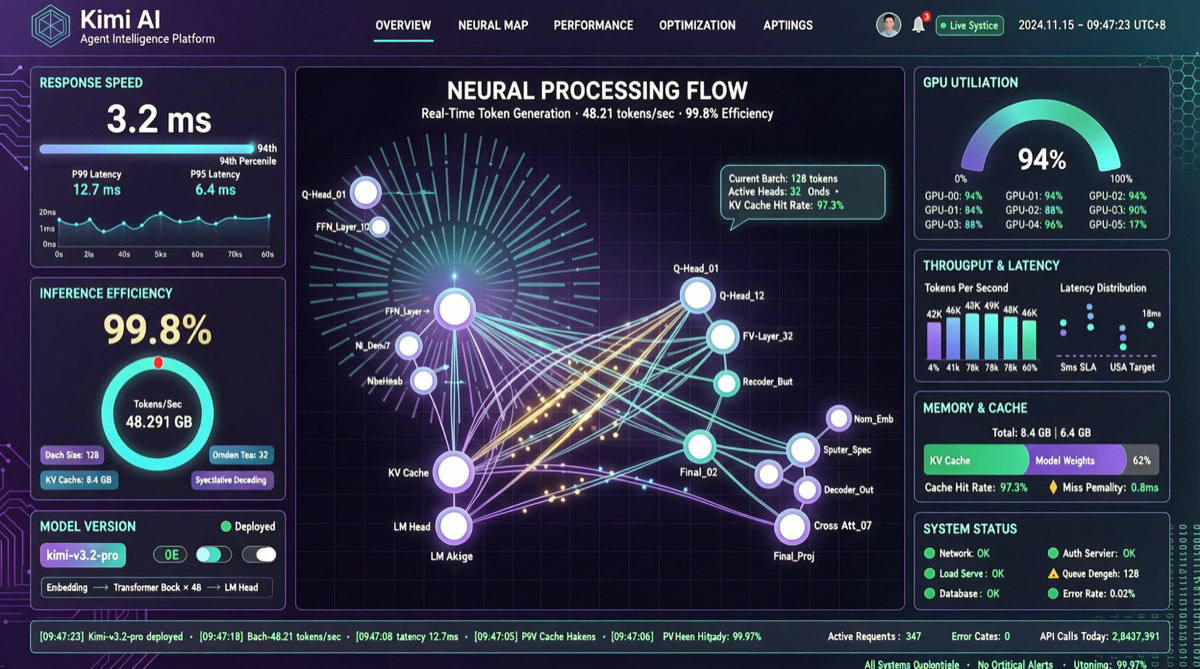

Tokenspeedは近日、MLA(Multi-Latent Attention)推論ライブラリのday-0バージョンをリリースした。NVIDIAハードウェア上でのKimi 2.5/2.6とDeepSeek R1のエージェントワークロードに特化して最適化されている。

核心的な最適化方向:

1. 長文脈注意力圧縮

MLAアーキテクチャ自体が長序列の注意力計算複雑さを大幅に低減できる。Tokenspeedはこの上にKVキャッシュ管理戦略をさらに最適化し、10万+トークンのコンテキスト下で推論レイテンシの成長曲線をより緩やかににしている。

2. マルチターン会話のコンテキスト再利用

エージェントのマルチラウンド推論において、コンテキストの大部分は変わらないである(システムプロンプト、ツール定義、コードベースインデックス)。TokenspeedのMLAライブラリはラウンド間のコンテキストプレフィックス再利用をサポートし、冗長計算を回避する。

3. NVIDIAハードウェア深い適応

Hopper(H100/H200)およびBlackwell(B100/B200)アーキテクチャ向けのFP8推論最適化。RTX 5090などのコンシューマーグレードGPUとも互換性あり。

エージェントレースにおけるKimi 2.5/2.6のポジショニング

月之暗面のKimiシリーズは中国AIのエージェント分野で重要なプレイヤーであり続けている:

- Kimi K2.6:4月のマルチモデル横断評価において、Kimi K2.6は中国語エージェントシナリオで優れたパフォーマンスを発揮した。特にマルチツール呼び出しと長文脈理解において。

- Kimi 2.5/2.6の継続的イテレーション:月之暗面は迅速なイテレーションペースを維持しており、各世代がエージェント能力を強化している。

Tokenspeed MLAライブラリのリリースは、Kimiのエージェントシナリオにおけるパフォーマンスアンプを提供する——同じモデルでも、MLA最適化後、エージェントワークロードでのスループットとレイテンシに知覚可能な改善が得られる。

開発者にとっての実践的意味

Kimi 2.5/2.6を使用してエージェントアプリケーションを構築している、または検討中の場合、以下の主に情報を押さえておくべきだ:

デプロイメントレベル:

- Tokenspeed MLAライブラリはNVIDIA GPUが必要(Hopper/Blackwellアーキテクチャで最高の効果)

- DeepSeek R1と同じ最適化パスを共有——複数のモデルを同時に使用する場合、同じインフラを再利用可能

性能期待値:

- 長文脈(10万+トークン)シナリオでの推論レイテンシ30〜50%低減

- マルチターンエージェントタスクのエンドツーエンド時間20〜40%短縮

- VRAM使用率向上、同一ハードウェアでより長いコンテキストを処理可能

エコシステムの位置づけ:

- Kimiは現在、国産モデルの中でエージェント能力が第一ティアにランクイン

- MLA最適化はデプロイメントレイヤーの性能ギャップを埋める

- Ollamaなどのローカルデプロイメントツールと組み合わせることで、Kimiのエージェント能力をより多くのシナリオに拡張可能

横断比較:エージェントレースにおけるKimi vs 他の国産モデル

| モデル | エージェント能力の亮点 | デプロイメント最適化の進展 |

|---|---|---|

| Kimi 2.5/2.6 | 中国語エージェントシナリオでリーディング、マルチツール呼び出しが成熟 | Tokenspeed MLAライブラリ最適化 |

| DeepSeek V4-Pro | 100万コンテキスト、オープンソースウェイト | Ollamaネイティブサポート |

| Qwen 3.6 | コンシューマーGPUで実行可能、軽量エージェント | 多種量子化スキームサポート |

| GLM-5.1 | SWE-benchでClaude Opus 4.7に接近 | オープンソースエージェント戦略 |

| MiniMax | Sentient Arena評価で好調 | 主にクラウドAPI |

Kimiの優位性はエンドツーエンドのエージェント体験にある——モデル能力から推論最適化、エコシステム統合まで、完全なテクノロジースタックを形成しつつある。

まとめ

Tokenspeed MLAライブラリのリリースは、エージェント分野におけるKimiのもう一つのインフラストラクチャブーストだ。エージェントアプリケーション用に国産モデルを評価している開発者にとって、これは国産モデルと国際最先端の間のデプロイメント性能ギャップをさらに狭めるものだ。

Kimi + MLA最適化 + 豊富なエージェントツールエコシステム——この技術ルートはますます説得力を増している。