Почему агентным сценариям нужна специализированная оптимизация?

Текущие оптимизации LLM в основном нацелены на стандартные диалоговые сценарии — пользователь задаёт вопрос, модель отвечает. Но агентные рабочие нагрузки принципиально иные:

- Длинный контекст накапливается непрерывно: по мере выполнения задач агенты постоянно собирают результаты вызовов инструментов, промежуточные состояния и обратную связь. Окно контекста растёт со временем.

- Плотный многоходовый инференс: одна агентная задача может запустить 10-30 последовательных раундов инференса, каждый из которых требует полного вычисления внимания.

- Чувствительность к задержкам: пользовательский опыт агента напрямую зависит от задержки инференса на каждом раунде. Кумулятивная задержка приводит к коллапсу общего опыта.

Именно поэтому оптимизации общего назначения для LLM-инференса оказываются недостаточными в агентных сценариях — они не были спроектированы для этих особых паттернов.

Библиотека Tokenspeed MLA: оптимизация, созданная для агентов

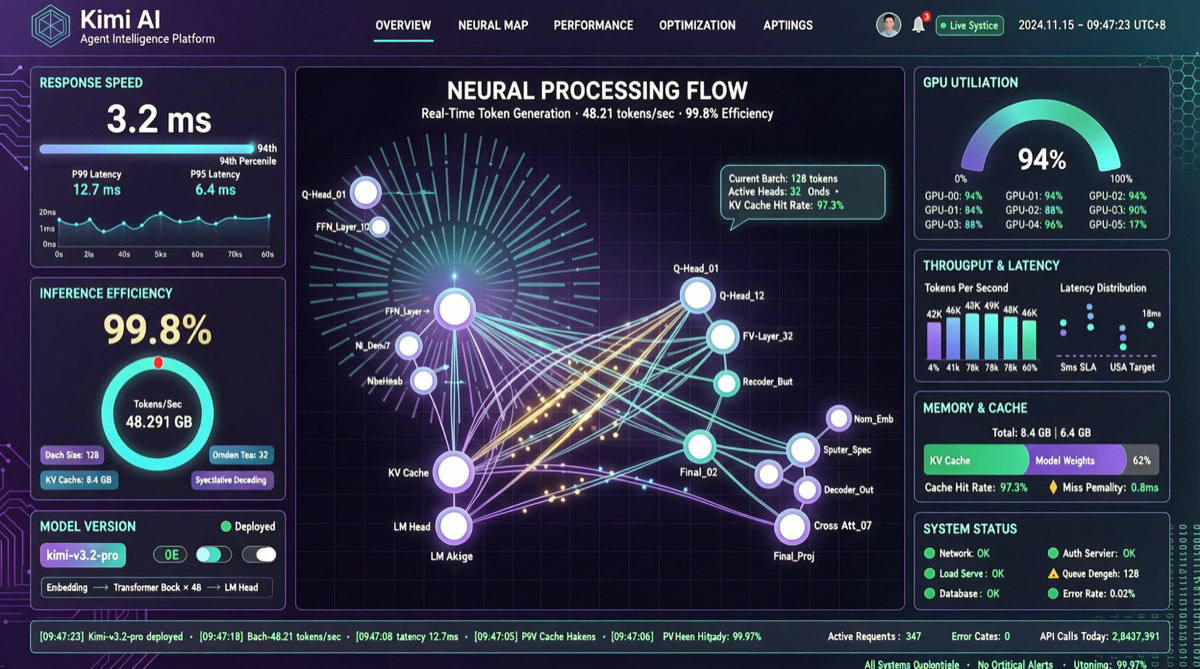

Tokenspeed недавно выпустила day-0 версию своей библиотеки MLA (Multi-Latent Attention) инференса, специально оптимизированной для Kimi 2.5/2.6 и DeepSeek R1 на оборудовании NVIDIA в агентных рабочих нагрузках.

Основные направления оптимизации:

1. Сжатие внимания для длинного контекста

Архитектура MLA сама по себе значительно снижает вычислительную сложность внимания для длинных последовательностей. Tokenspeed дополнительно оптимизирует стратегию управления KV-кэшем, делая кривые роста задержки инференса более пологими при контекстах в 100 тысяч+ токенов.

2. Повторное использование контекста в многоходовых диалогах

В ходе многораундового агентного инференса большая часть контекста остаётся неизменной (системные промпты, определения инструментов, индексы кодовой базы). Библиотека MLA от Tokenspeed поддерживает повторное использование префикса контекста между раундами, избегая избыточных вычислений.

3. Глубокая адаптация к оборудованию NVIDIA

Оптимизация FP8-инференса для архитектур Hopper (H100/H200) и Blackwell (B100/B200), с совместимостью для потребительских GPU, таких как RTX 5090.

Позиционирование Kimi 2.5/2.6 в агентной гонке

Серия Kimi от Moonshot AI является значимым игроком в китайской ИИ-агентной гонке:

- Kimi K2.6: в апрельской кросс-оценке нескольких моделей Kimi K2.6 показал отличные результаты в китайскоязычных агентных сценариях, особенно в многоинструментальных вызовах и понимании длинного контекста.

- Непрерывная итерация Kimi 2.5/2.6: Moonshot AI поддерживает быстрый темп итераций, и каждое поколение усиливает агентные возможности.

Выпуск библиотеки Tokenspeed MLA предоставляет усилитель производительности для Kimi в агентных сценариях — та же модель после MLA-оптимизации получит ощутимые улучшения пропускной способности и задержки для агентных рабочих нагрузок.

Практическое значение для разработчиков

Если вы используете или рассматриваете Kimi 2.5/2.6 для создания агентных приложений, вот ключевые выводы:

Уровень развёртывания:

- Библиотека Tokenspeed MLA требует GPU NVIDIA (лучшие результаты на архитектурах Hopper/Blackwell)

- Разделяет тот же путь оптимизации с DeepSeek R1 — если вы используете несколько моделей, можноповторно использовать ту же инфраструктуру

Ожидания по производительности:

- Снижение задержки инференса на 30-50% в сценариях длинного контекста (100 тысяч+ токенов)

- Сокращение сквозного времени на 20-40% для многоходовых агентных задач

- Улучшение использования VRAM, позволяющее обрабатывать более длинные контексты на том же оборудовании

Позиционирование в экосистеме:

- Kimi в настоящее время входит в первый эшелон по агентным способностям среди отечественных моделей

- MLA-оптимизациязаполняетает пробел в производительности на уровне развёртывания

- В сочетании с инструментами локального развёртывания, такими как Ollama, агентные способности Kimi могут расшириться на большее количество сценариев

Сравнительная таблица: Kimi vs другие отечественные модели в агентной гонке

| Модель | Ключевые агентные способности | Прогресс оптимизации развёртывания |

|---|---|---|

| Kimi 2.5/2.6 | Лидер в китайскоязычных агентных сценариях, зрелые многоинструментальные вызовы | Оптимизация библиотекой MLA от Tokenspeed |

| DeepSeek V4-Pro | Контекст 1 млн токенов, веса с открытым кодом | Нативная поддержка Ollama |

| Qwen 3.6 | Запуск на потребительских GPU, лёгкие агенты | Поддержка множества схем квантования |

| GLM-5.1 | SWE-bench близок к Claude Opus 4.7 | Стратегия открытых агентных решений |

| MiniMax | Сильные результаты в оценке Sentient Arena | Преимущественно облачный API |

Преимущество Kimi заключается в сквозном агентном опыте — от способностей модели до оптимизации инференса и интеграции экосистемы, формируется полный технологический стек.

Итог

Выпуск библиотеки Tokenspeed MLA — это ещё один инфраструктурный буст для Kimi в агентной гонке. Для разработчиков, оценивающих отечественные модели для агентных приложений, этодальнейше сужает разрыв в производительности развёртывания между отечественными моделями и международными лидерами.

Kimi + MLA-оптимизация + богатая экосистема агентных инструментов — этот технологический маршрут становится всё более убедительным.