OpenAIが先日、WebRTCを音声AIのリアルタイム通信にどう使っているかという技術ブログを公開した。結果、WebRTCのベテランエンジニアから反論が来た——プロトコルレベルで「これを使うべきではない」と。

著者はLuke Curley。TwitchでWebRTC SFUを書き、DiscordでWebRTC SFUをRustで書き直した人物。彼の核心主張は直接的だ:WebRTCは音声AIに合わない。

問題点はどこにあるか

WebRTCはビデオ会議向けに設計された——低遅延、リアルタイムインタラクション、パケットは落ちたら落ちたまま。音声AIのニーズは違う:

音声入力は高価なプロンプトだ。 ネットワークが悪い時、WebRTCは低遅延維持のために積極的に音声パケットをドロップする。会議ではこれでいい。音声AIでは、完全なプロンプトが200msの遅延より重要だ。

もっと厄介なのは、WebRTCがブラウザ内で音声パケットの再送信をサポートしていないこと。結果、ユーザーの発話がネットワーク不良で途切れ、LLMは不完全なプロンプトを受け取り、間違った回答を返す。ユーザーはネットワークのせいだとは思わない——AIがバカだと思うだけだ。

代替案

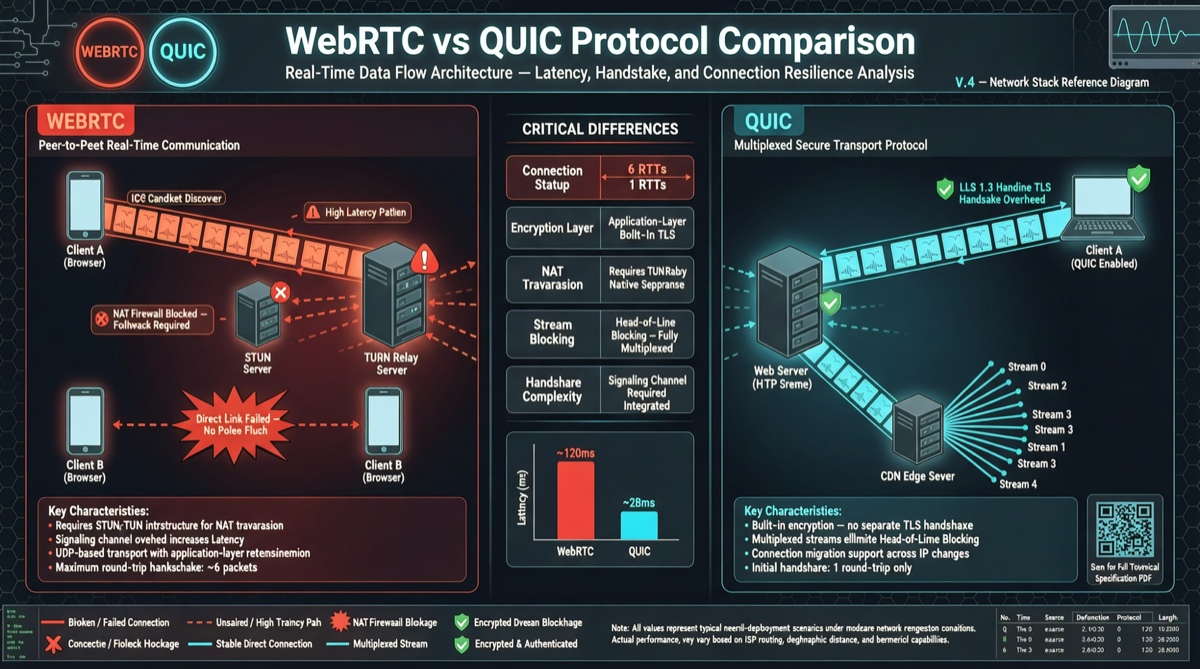

記事は**MoQ(Media over QUIC)**を推奨している。QUICベースのリアルタイムメディアプロトコルで、IETFで標準化中。Cloudflareが既にCDNサポートを提供。

主な情報源:

- OpenAI's WebRTC Problem, Luke Curley, 2026-05-06