OpenAI 前几天发了篇技术博客讲怎么用 WebRTC 做语音 AI。结果被一个 WebRTC 老兵怼了——从协议层面说你不该用这个。

作者 Luke Curley,在 Twitch 写过 WebRTC SFU,在 Discord 用 Rust 重写过 WebRTC SFU。核心观点:WebRTC 和语音 AI 的适配度很差。

问题出在哪

WebRTC 网络不好时会 aggressively 丢包来保持低延迟。开会通话可以接受。语音 AI 不行——完整的 prompt 比 200ms 延迟重要得多。

更麻烦的是 WebRTC 在浏览器里不支持重传音频包。用户的语音输入被截断,LLM 收到残缺的 prompt,返回错误的回答。用户不会觉得是网络问题——只会觉得 AI 很蠢。

替代方案

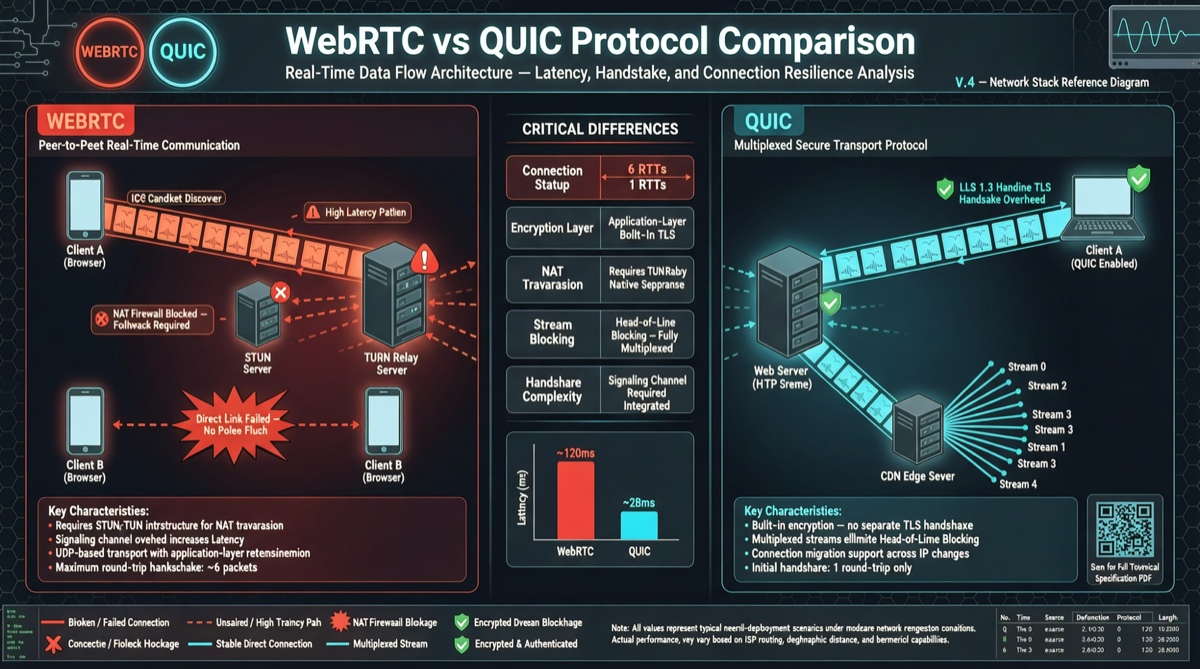

文章推荐 MoQ(Media over QUIC)——基于 QUIC 的实时媒体协议,IETF 标准化中,Cloudflare 已提供 CDN 支持。

主要来源:

- OpenAI's WebRTC Problem, Luke Curley, 2026-05-06