結論

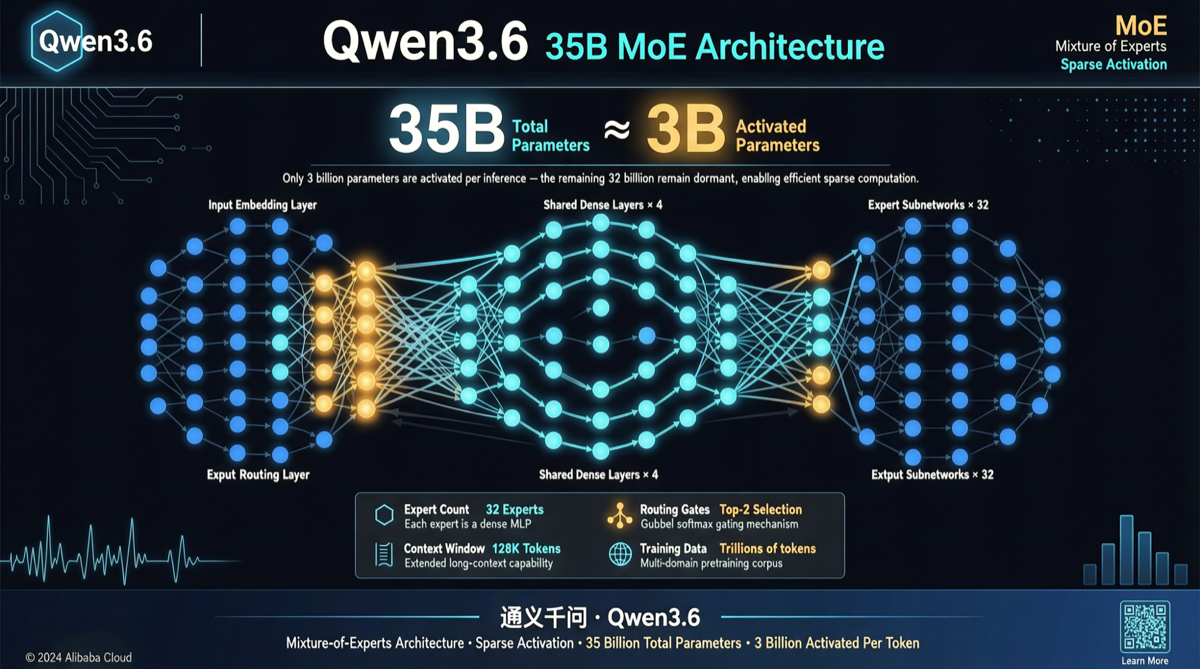

通義千問チームはHugging Face上にQwen3.6-35B-A3Bを公開しました。これはQwen3.6シリーズ初のオープンソースバリアントです。総パラメータ35B、推論時はわずか3Bのみ活性化。256エキスパートMoEとGated DeltaNetのハイブリッドアーキテクチャを採用。Apache 2.0ライセンス、ネイティブ262Kコンテキストウィンドウ、100万トークンまで拡張可能。

| 項目 | Qwen3.6-35B-A3B |

|---|---|

| 総パラメータ | 35B |

| 活性化パラメータ | 3B |

| エキスパート数 | 256(8ルーティング + 1共有を活性化) |

| コンテキスト | 262K ネイティブ、1Mまで拡張可能 |

| ライセンス | Apache 2.0 |

| アーキテクチャ | Gated DeltaNet → MoE + Gated Attention → MoE |

| マルチモーダル | Vision Encoder内蔵(Image-Text-to-Text) |

何が起こったのか

アーキテクチャ:Gated DeltaNetとMoEのハイブリッド設計

Qwen3.6-35B-A3Bの核心的イノベーションはハイブリッドアテンションレイアウトにあります:

10 × [

3 × (Gated DeltaNet → MoE)

1 × (Gated Attention → MoE)

]これは単純なMoEの積み重ねではありません。**線形アテンション(Gated DeltaNet)とグローバルアテンション(Gated Attention)**を交互に組み合わせ、DeltaNet 3層ごとにグローバルアテンション層1層を配置しています。DeltaNetは効率的なローカルコンテキストモデリングを担当し、グローバルアテンション層は長距離情報伝達が減衰しないことを保証します。

具体的なパラメータ:

- 40層、隠れ次元 2048

- Gated DeltaNet:32個のVヘッド + 16個のQKヘッド、ヘッド次元 128

- Gated Attention:16個のQヘッド + 2個のKVヘッド(GQA)、ヘッド次元 256

- MoE:256個のエキスパート、呼び出しごとに8個のルーティングエキスパート + 1個の共有エキスパートを活性化、エキスパート中間次元 512

- ボキャブラリサイズ:248,320(パディング後)

推論効率:3B活性化パラメータが意味すること

3Bの活性化パラメータは、現在のオープンソースMoEモデルの中で極めて低い水準です。比較すると:

| モデル | 総パラメータ | 活性化パラメータ | 活性化比率 |

|---|---|---|---|

| Qwen3.6-35B-A3B | 35B | 3B | 8.6% |

| DeepSeek V4 | 1.6T | 37B | 2.3% |

| Ling-2.6-Flash | 104B | 7.4B | 7.1% |

| Kimi K2.6 | ~1T | ~32B | 3.2% |

Qwen3.6-35B-A3Bの絶対活性化パラメータ数(3B)は他のモデルを大きく下回っており、これは以下を意味します:

- シングルカードで実行可能:INT4量子化後、活性化部分のVRAMは約1.5〜2GBで済む

- 低遅延推論:Qwen3.6-27Bなどの27B denseモデルと比較して数倍高速

- マルチインスタンス並列:A100 1枚で複数のインスタンスを同時実行可能、高スループットシナリオに最適

ネイティブマルチモーダル対応

テキストのみのQwen3.6-27Bとは異なり、Qwen3.6-35B-A3BはVision Encoderを内蔵したImage-Text-to-Textアーキテクチャです。つまり、外部ビジョンモデルなしで画像とテキストの混合入力を直接処理できます。262Kのネイティブコンテキストと組み合わせることで、画像を含む長文ドキュメントの複雑な理解タスクに適しています。

Qwen3.6シリーズの2つの重要なアップグレード

公式ブログで言及されている2つの核心的改善方向:

- Agentic Codingの強化:フロントエンドワークフローとリポジトリレベルの推論能力が大幅に向上。コードAgentシナリオにおけるツール呼び出しチェーンがより長く、より安定

- Thinking Preservation(思考保持):履歴メッセージから推論コンテキストを保持する新オプション。イテレーティブ開発における重複推論オーバーヘッドを削減。多ターン対話型Agentワークフローに特に重要

なぜ重要なのか

1. Qwen3.6ラインナップのMoE空白を埋める

Qwen3.6シリーズはこれまで主にdenseモデル(27Bなど)をリリースしてきました。35B-A3Bは初のMoEバリアントであり、製品ラインの重要なピースを補完します:

- 27B dense:MoEの複雑さが不要で安定性を重視するシナリオ向け

- 35B-A3B MoE:活性化パラメータわずか3B、より大きなdenseモデルに迫る性能、コスト重視の高並行シナリオに最適

- 大規模版:今後さらに大きなMoEバリアントが登場する可能性

2. コンシューマーGPUに優しい

3B活性化パラメータ + 2048隠れ次元 = 極めて低い推論ハードル。コンシューマーGPUでのデプロイシナリオ:

# RTX 4090 (24GB) で簡単に実行可能

# INT4量子化後、活性化部分は約2GBのVRAMで済む

# 残りのVRAMをKVキャッシュに使用可能、長文コンテキストをサポートこれは個人開発者や小規模チームがクラウドAPIに依存せずに、低コストでマルチモーダルMoEモデルをデプロイできることを意味します。

3. ハイブリッドアーキテクチャの探求価値

Gated DeltaNet + MoEの組み合わせはオープンソースコミュニティではまだ一般的ではありません。線形アテンションのバリエーションであるDeltaNetは、長系列モデリングにおいて天然の優位性を持ち、MoEのスパース計算と組み合わせることで、新たな効率-性能トレードオフパラダイムを表している可能性があります。ベンチマーク結果がこの設計の優位性を検証すれば、他のオープンソースチームも類似のアーキテクチャに追随するでしょう。

競合比較

| モデル | 総パラメータ | 活性化パラメータ | コンテキスト | マルチモーダル | ライセンス | デプロイハードル |

|---|---|---|---|---|---|---|

| Qwen3.6-35B-A3B | 35B | 3B | 262K→1M | ✅ | Apache 2.0 | コンシューマーGPU |

| Qwen3.6-27B | 27B | 27B | 128K | ✅ | Apache 2.0 | シングル4090 |

| DeepSeek V4 | 1.6T | 37B | 128K | ❌ | MIT | 複数A100 |

| Ling-2.6-Flash | 104B | 7.4B | 256K | ❌ | MIT | シングル4090 |

| MiMo-V2.5-Pro | 1T | 42B | 1M | ❌ | MIT | 複数A100 |

Qwen3.6-35B-A3Bの独自のポジショニング:絶対的に最低の活性化パラメータ + ネイティブマルチモーダル + Apache 2.0商用ライセンス。

アドバイス

注目すべき人

- Agent開発者:Thinking Preservation機能はマルチターンAgent呼び出しの効率を直接最適化

- コスト重視のデプロイチーム:3B活性化パラメータは極めて低い推論コストとハードルを意味する

- マルチモーダルアプリ開発者:ネイティブImage-Text-to-Textアーキテクチャ、追加のビジョンモデル不要

- 長文コンテキストニーズ:262Kネイティブ、1Mまで拡張可能なコンテキストウィンドウ

始め方

pip install transformers accelerate

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen3.6-35B-A3B",

device_map="auto",

torch_dtype="auto"

)vLLM、SGLang、KTransformersなどの推論フレームワークと互換性あり。

注意点

- Qwen3.6初のオープンソースバリアントとして、コミュニティツールチェーン(Ollama対応など)はまだ開発中の可能性あり

- 3B活性化パラメータの代償は総パラメータ35B — 全量読み込みには一定のVRAMが必要(スパースローディング対応のMoE推論フレームワークが必要)

- ベンチマークの具体的な数値は公式ブログを参照。現在のページは完全に展開されていない

- Apache 2.0ライセンスは商用利用を許可するが、ライセンス条項の遵守が必要

主要ソース: