Ключевые выводы

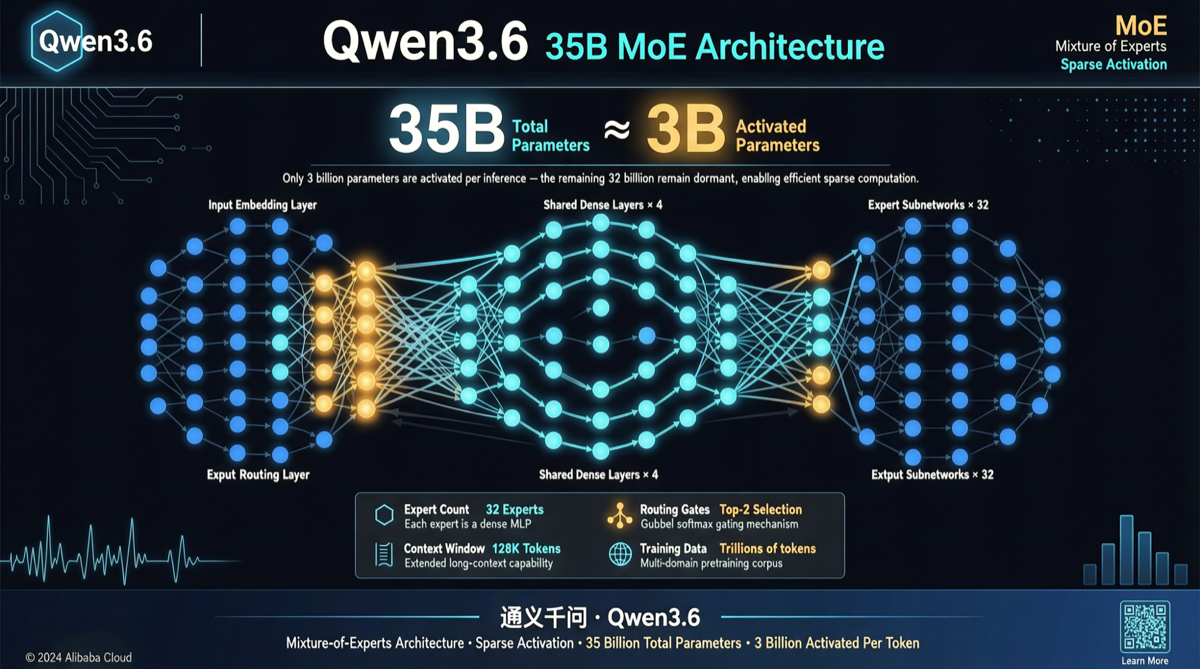

Команда Qwen опубликовала на Hugging Face модель Qwen3.6-35B-A3B — первый вариант с открытым исходным кодом из серии Qwen3.6. 35 млрд общих параметров, из которых при инференсе активируется лишь 3 млрд. Гибридная архитектура: MoE с 256 экспертами в сочетании с Gated DeltaNet. Лицензия Apache 2.0, нативное окно контекста 262K, расширяемое до 1 миллиона токенов.

| Параметр | Qwen3.6-35B-A3B |

|---|---|

| Общие параметры | 35 млрд |

| Активируемые параметры | 3 млрд |

| Количество экспертов | 256 (активируются 8 маршрутизируемых + 1 общий) |

| Контекст | 262K нативно, расширяется до 1M |

| Лицензия | Apache 2.0 |

| Архитектура | Gated DeltaNet → MoE + Gated Attention → MoE |

| Мультимодальность | Встроенный Vision Encoder (Image-Text-to-Text) |

Что произошло

Архитектура: гибридная конструкция Gated DeltaNet и MoE

Ключевая инновация Qwen3.6-35B-A3B заключается в гибридной компоновке внимания:

10 × [

3 × (Gated DeltaNet → MoE)

1 × (Gated Attention → MoE)

]Это не простое наслоение MoE. Здесь линейное внимание (Gated DeltaNet) и глобальное внимание (Gated Attention) чередуются: каждые 3 слоя DeltaNet сопровождаются 1 слоем глобального внимания. DeltaNet отвечает за эффективное моделирование локального контекста, а слои глобального внимания обеспечивают передачу информации на большие расстояния без затухания.

Конкретные параметры:

- 40 слоёв, скрытая размерность 2048

- Gated DeltaNet: 32 головы V + 16 голов QK, размерность головы 128

- Gated Attention: 16 голов Q + 2 головы KV (GQA), размерность головы 256

- MoE: 256 экспертов, при каждом вызове активируются 8 маршрутизируемых экспертов + 1 общий, промежуточная размерность эксперта 512

- Размер словаря: 248 320 (после паддинга)

Эффективность инференса: что означают 3 млрд активируемых параметров

Активация 3 млрд параметров — один из самых низких показателей среди современных open-source MoE-моделей. Сравнение:

| Модель | Общие параметры | Активируемые параметры | Доля активации |

|---|---|---|---|

| Qwen3.6-35B-A3B | 35 млрд | 3 млрд | 8,6% |

| DeepSeek V4 | 1,6 трлн | 37 млрд | 2,3% |

| Ling-2.6-Flash | 104 млрд | 7,4 млрд | 7,1% |

| Kimi K2.6 | ~1 трлн | ~32 млрд | 3,2% |

Абсолютное число активируемых параметров Qwen3.6-35B-A3B (3 млрд) значительно ниже, чем у других моделей, что означает:

- Запуск на одной видеокарте: после квантования INT4 для активированной части требуется лишь ~1,5–2 ГБ видеопамяти

- Низкая задержка инференса: в несколько раз быстрее, чем 27B dense-модели вроде Qwen3.6-27B

- Многопоточность: на одной A100 можно одновременно запускать несколько экземпляров — идеально для сценариев с высокой пропускной способностью

Нативная мультимодальная поддержка

В отличие от текстовой Qwen3.6-27B, модель Qwen3.6-35B-A3B построена на архитектуре Image-Text-to-Text со встроенным Vision Encoder. Это означает, что она может напрямую обрабатывать смешанные текстово-графические входные данные без подключения внешней визуальной модели. В сочетании с нативным контекстом 262K модель подходит для сложных задач понимания длинных документов с иллюстрациями.

Два ключевых улучшения серии Qwen3.6

Официальный блог выделяет два основных направления улучшений:

- Улучшение Agentic Coding: значительно повышена способность к работе с фронтенд-воркфлоу и рассуждению на уровне репозитория — это означает более длинные и стабильные цепочки вызовов инструментов в сценариях кодовых агентов

- Thinking Preservation (сохранение рассуждений): новая опция позволяет сохранять контекст рассуждений из исторических сообщений, снижая избыточные вычислительные затраты при итеративной разработке — особенно критично для многоходовых интерактивных воркфлоу агентов

Почему это важно

1. Заполнение MoE-пробела в линейке Qwen3.6

Серия Qwen3.6 ранее выпускала преимущественно dense-модели (например, 27B). 35B-A3B — первый вариант MoE, завершающий ключевой элемент продуктовой линейки:

- 27B dense: для сценариев, где не нужна сложность MoE и важна стабильность

- 35B-A3B MoE: лишь 3 млрд активируемых параметров, производительность приближается к гораздо более крупным dense-моделям, идеально для сценариев с высокой нагрузкой при ограниченном бюджете

- Более крупные версии: возможно появление более масштабных MoE-вариантов

2. Дружелюбность к потребительским GPU

3 млрд активируемых параметров + скрытая размерность 2048 = чрезвычайно низкий порог для инференса. Сценарий развёртывания на потребительских GPU:

# RTX 4090 (24 ГБ) запускает без проблем

# ~2 ГБ видеопамяти для активированной части после квантования INT4

# Оставшаяся память доступна для KV Cache, поддержка длинного контекстаЭто означает, что индивидуальные разработчики и небольшие команды могут развёртывать мультимодальную MoE-модель с низкими затратами, не полагаясь на облачные API.

3. Исследовательская ценность гибридной архитектуры

Комбинация Gated DeltaNet + MoE пока не распространена в open-source-сообществе. DeltaNet как вариант линейного внимания имеет естественные преимущества в моделировании длинных последовательностей. В сочетании со稀疏 вычислениями MoE это может представлять новую парадигму баланса эффективности и производительности. Если бенчмарки подтвердят преимущества этого дизайна, другие open-source-команды, вероятно, последуют примеру.

Сравнение с конкурентами

| Модель | Общие параметры | Активируемые параметры | Контекст | Мультимодальность | Лицензия | Порог развёртывания |

|---|---|---|---|---|---|---|

| Qwen3.6-35B-A3B | 35 млрд | 3 млрд | 262K→1M | ✅ | Apache 2.0 | Потребительский GPU |

| Qwen3.6-27B | 27 млрд | 27 млрд | 128K | ✅ | Apache 2.0 | Одна 4090 |

| DeepSeek V4 | 1,6 трлн | 37 млрд | 128K | ❌ | MIT | Несколько A100 |

| Ling-2.6-Flash | 104 млрд | 7,4 млрд | 256K | ❌ | MIT | Одна 4090 |

| MiMo-V2.5-Pro | 1 трлн | 42 млрд | 1M | ❌ | MIT | Несколько A100 |

Уникальное позиционирование Qwen3.6-35B-A3B: наименьшие абсолютные активируемые параметры + нативная мультимодальность + коммерческая лицензия Apache 2.0.

Рекомендации

Кому стоит обратить внимание

- Разработчикам агентов: функция Thinking Preservation напрямую оптимизирует эффективность многоходовых вызовов агентов

- Командам с ограниченным бюджетом: 3 млрд активируемых параметров означают крайне низкие затраты на инференс и аппаратные требования

- Разработчикам мультимодальных приложений: нативная архитектура Image-Text-to-Text, дополнительная визуальная модель не нужна

- Пользователям с потребностью в длинном контексте: 262K нативно, расширяется до 1M токенов

Как начать

pip install transformers accelerate

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen3.6-35B-A3B",

device_map="auto",

torch_dtype="auto"

)Совместима с фреймворками vLLM, SGLang, KTransformers и другими.

На что обратить внимание

- Как первый open-source-вариант Qwen3.6, инструментарий сообщества (поддержка Ollama и т.д.) может быть ещё в разработке

- Плата за 3 млрд активируемых параметров — 35 млрд общих параметров: полная загрузка всё ещё требует определённого объёма видеопамяти (нужен MoE-фреймворк с поддержкой稀疏 загрузки)

- Конкретные значения бенчмарков следует смотреть в официальном блоге — текущая страница раскрыта не полностью

- Лицензия Apache 2.0 разрешает коммерческое использование, но требует соблюдения условий лицензии

Основные источники: