人間の脳が最もエネルギー効率の良い方法:何かを考えるとき、必要なニューロンだけを点灯させる。

LLMも実際は同じことをやっています — フィードフォワード層の95%以上の活性化は、どのトークンに対してもほぼゼロです。しかしGPUハードウェアはこれに付き合ってくれません。密行列向けに設計されているので、疎ベクトルを計算しても、全体をそのまま実行します。モデルは「手を抜きたい」のに、ハードウェアが許さないのです。

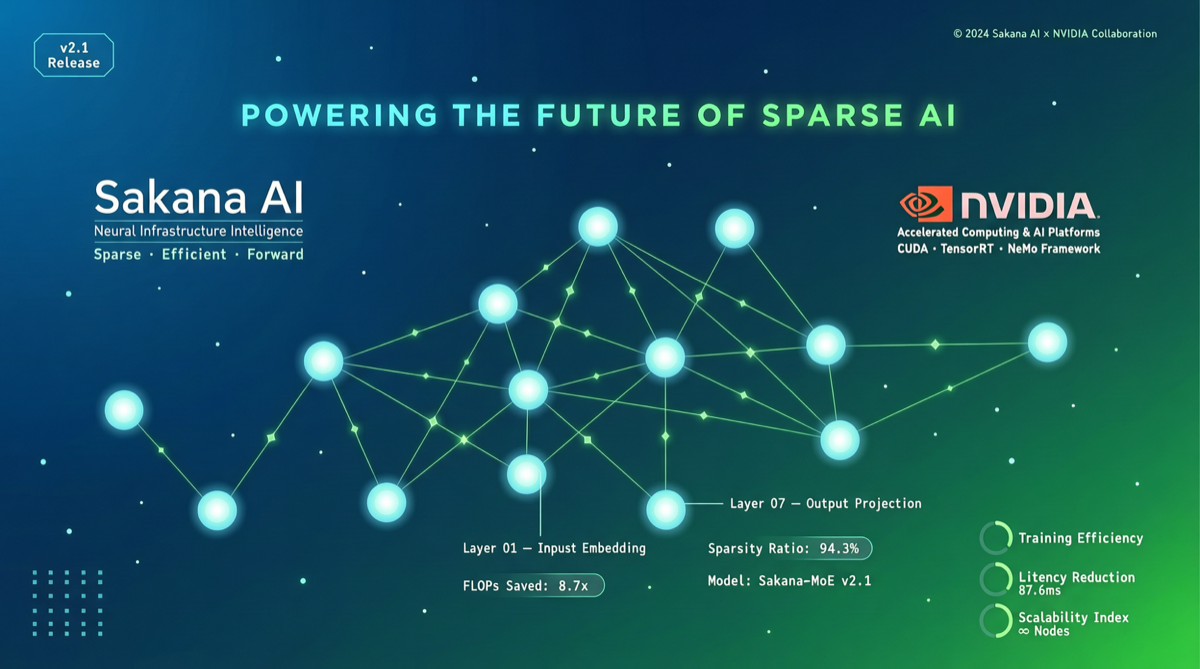

Sakana AIとNVIDIAの解決策は、モデルもGPUも変えない — データ形式とカーネルを変えて、疎性をハードウェアに合わせるのです。

TwELLの仕組み

5月8日、Sakana AIはNVIDIAとの共同によるICML2026論文を発表しました。2つの核心的な貢献があります:

TwELL(Tile-wise Efficient Layout for LLMs):新しい疎データパッキング形式。従来の疎形式(CSR、BSRなど)はGPUに優しくありません — メモリアクセスパターンが飛び飛びになり、キャッシュヒット率が下がります。TwELLは活性化をタイル単位で再配置し、連続したメモリエリアに連続した非ゼロ値を格納します。GPUは読み込む時に「飛び回る」必要がなくなります。

融合CUDAカーネル:疎行列乗算の複数のステップを1つのGPUカーネル実行に統合し、中間結果の読み書きオーバーヘッドを削減します。

結果は直接的です:大規模推論・学習で20%以上の高速化を、モデル精度を損なうことなく実現。

最初の疎最適化ではないが、最も現実的な一つかもしれない

疎高速化は新しい概念ではありません。MoE(Mixture of Experts)はすでに動的疎化を行っています — レイヤーごとに一部のエキスパートのみを活性化。しかしMoEはモデルアーキテクチャの変更とゼロからの再学習が必要です。

TwELLの利点は、純粋に推論側の最適化であること — モデル重みに触れる必要も、再学習も不要です。既存の密トランスフォーマーを取り、TwELL形式でパッキングし、カーネルを交換すれば動きます。

デプロイメントチームにとって朗報 — モデルを再チューニングせずにメリットを得られます。

Qwen3-Omniとの関係

同時期に、vLLM-Omni v0.20.0も同様の最適化を行っています。H20上のQwen3-Omniスループットが72%向上(32並列で0.241→0.414 req/s)。ルートは違えど、方向性は同じ:LLM推論のあらゆるパフォーマンスを絞り出す。

モデルパラメータが大きくなり、呼び出し量が増える中で、推論コストは死活問題です。20%の高速化は、同じハードウェアで20%多くのリクエストを処理できるということ — トークン課金の商用モデルにとって、これは純利益です。

主要ソース: