Самый энергоэффективный трюк человеческого мозга: когда думаешь о чём-то, зажигай только нужные нейроны.

LLM на самом деле делают то же самое — более 95% активаций в feedforward-слоях близки к нулю для любого токена. Но GPU-железо не подыгрывает: оно спроектировано для плотных матриц, поэтому даже при вычислении разреженного вектора прогоняет всё целиком. Модель «хочет лениться», но железо не позволяет.

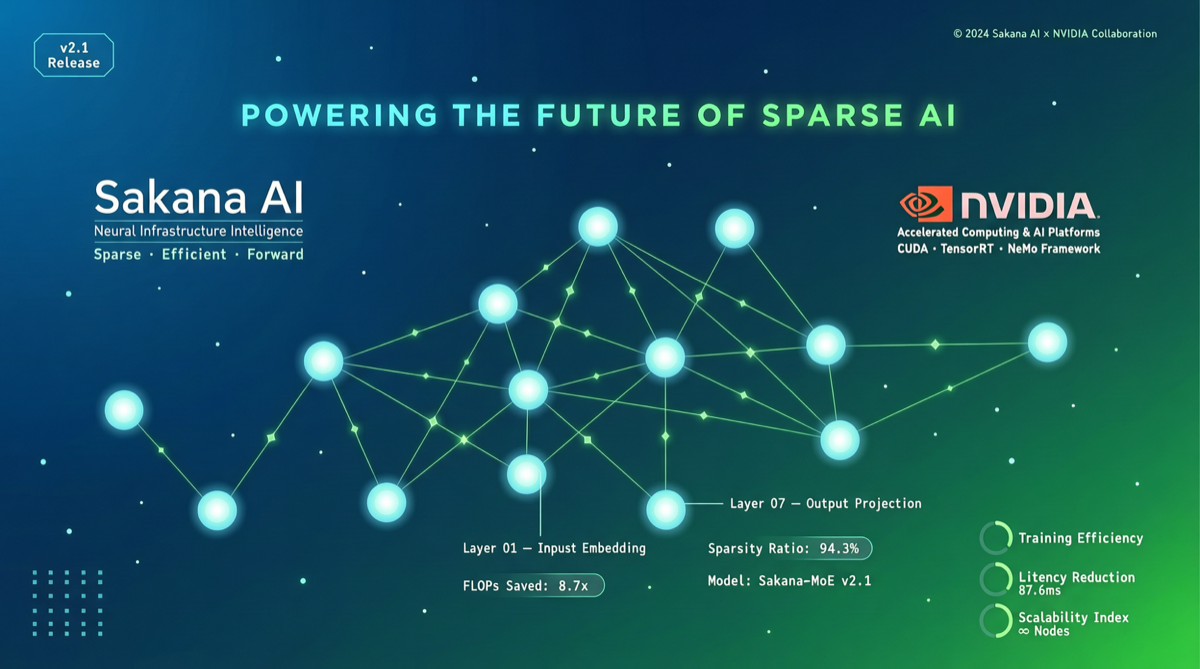

Решение Sakana AI и NVIDIA — не менять модель и не менять GPU, а изменить формат данных и ядро, чтобы разреженность подходила железу.

Как работает TwELL

8 мая Sakana AI опубликовала статью для ICML2026 в сотрудничестве с NVIDIA. Два ключевых贡献:

TwELL (Tile-wise Efficient Layout for LLMs): новый формат упаковки разреженных данных. Традиционные разреженные форматы (CSR, BSR) не дружат с GPU — паттерны доступа к памяти скачут, hit rate кэша падает. TwELL перестраивает активации по тайлам так, чтобы непрерывные области памяти хранили непрерывные ненулевые значения. GPU больше не нужно «прыгать» при чтении.

Fused CUDA-ядра: несколько шагов разреженного матричного умножения объединены в одно GPU-ядро, что снижает накладные расходы на чтение/запись промежуточных результатов.

Результат прямой: ускорение на 20%+ при крупномасштабном инференсе и обучении без потери точности модели.

Не первая оптимизация разреженности, но, возможно, самая прагматичная

Ускорение разреженности — не новая идея. MoE (Mixture of Experts) уже делает динамическую разреженность — активирует только часть экспертов на слой. Но MoE требует изменения архитектуры модели и переобучения с нуля.

Преимущество TwELL в том, что это чисто оптимизация на стороне инференса — не нужно трогать веса модели, не нужно переобучать. Берёте существующий dense-трансформер, упаковываете в формат TwELL, меняете ядро — и работает.

Хорошая новость для команд деплоя — получаете выгоду без повторной настройки модели.

Основные источники: