人脑最省能量的做法:想一件事的时候,只点亮需要的神经元。

LLM 其实也在干同样的事——前馈层里超过 95% 的激活值对任何一个 token 来说几乎都是零。但 GPU 硬件偏偏不吃这套:它按密集矩阵设计,你算一个稀疏向量,它也要把整个矩阵过一遍。结果就是,模型"想偷懒",硬件不让。

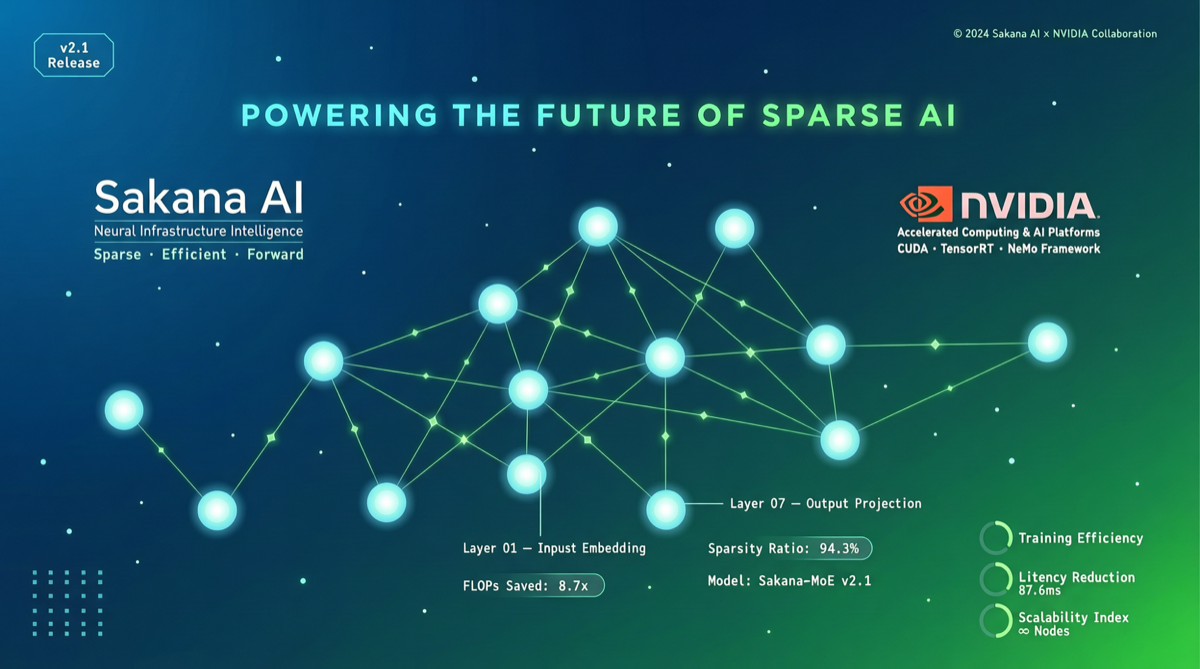

Sakana AI 和 NVIDIA 的解法不是改模型,也不是改 GPU——而是改数据格式和内核,让稀疏性贴合硬件。

TwELL 怎么做到的

5 月 8 日,Sakana AI 在博客发布了与 NVIDIA 合作的 ICML2026 论文,核心贡献两个:

TwELL(Tile-wise Efficient Layout for LLMs):一种新的稀疏数据打包格式。传统的稀疏格式(比如 CSR、BSR)对 GPU 并不友好——内存访问模式跳跃,缓存命中率差。TwELL 把激活值按 tile 重新排列,让连续的内存区域存连续的非零值,GPU 读取的时候不用再"跳格子"。

Fused CUDA 内核:把稀疏矩阵乘法中的多个步骤合并到一个 GPU kernel 里执行,减少中间结果的读写开销。

效果很直接:在大规模推理和训练场景下获得 20% 以上的速度提升,同时保持模型精度不损失。

这不是第一个稀疏优化,但可能是最务实的一个

稀疏加速不是新概念。MoE(Mixture of Experts)已经在做动态稀疏了——每层只激活部分专家。但 MoE 需要改模型架构,训练也得重来。

TwELL 的优势在于它是纯推理侧的优化,不需要动模型权重,不需要重新训练。你有一个现成的 dense transformer,用 TwELL 格式打包一下,换一下 kernel,就能跑。

这对部署团队来说是好消息——不用重新调模型,直接拿收益。

和 Qwen3-Omni 的关系

同一时期,vLLM-Omni v0.20.0 也在做类似的优化:Qwen3-Omni 在 H20 上的吞吐提升了 72%(32 并发下 0.241 → 0.414 req/s)。虽然 vLLM 走的路线不同,但方向一致:把 LLM 推理的每一滴性能榨出来。

当模型参数越来越大、调用量越来越高的时候,推理成本就是生死线。20% 的加速意味着同样硬件能多服务 20% 的请求——这对按 token 计费的商业模型来说,是纯利润。

能不能直接用

论文已经公开,代码应该也会开源(博客提到了 "Paper + code below")。但 TwELL 目前还是研究型方案,要集成到 vLLM 或 TensorRT-LLM 这样的推理引擎里,还需要工程适配。

如果你在做大规模 LLM 部署,这篇论文值得精读。如果你只是调 API 的用户——不用关心这个,但你可以预期,下一波推理降价的弹药里,有这一份。

主要来源: